EXPO の AWS Builders' Fair で「対話型セキュリティ監視ロボット」を体験してきた #AWSreInvent

こんにちは、製造ビジネステクノロジー部の若槻です。

AWS re:Invent 2025 の EXPO では AWS オフィシャルやパートナーなどが自社サービスや注力領域をアピールすべく各々ブースを設けていますが、その中で AWS Builders' Fair という他とは毛色の違った一角がありました。

AWS Builders' Fair と言えば AWS Summit Japan 2025 でも「遊び心溢れるテックの祭典」という触れ込みでコーナーが設けられていたのが記憶に新しい方もいると思いますが、re:Invent で設けられていたのはその本家版 (?) となります。

今回は、その AWS Builders' Fair で「対話型セキュリティ監視ロボット」を体験してきたのでレポートします。

レポート

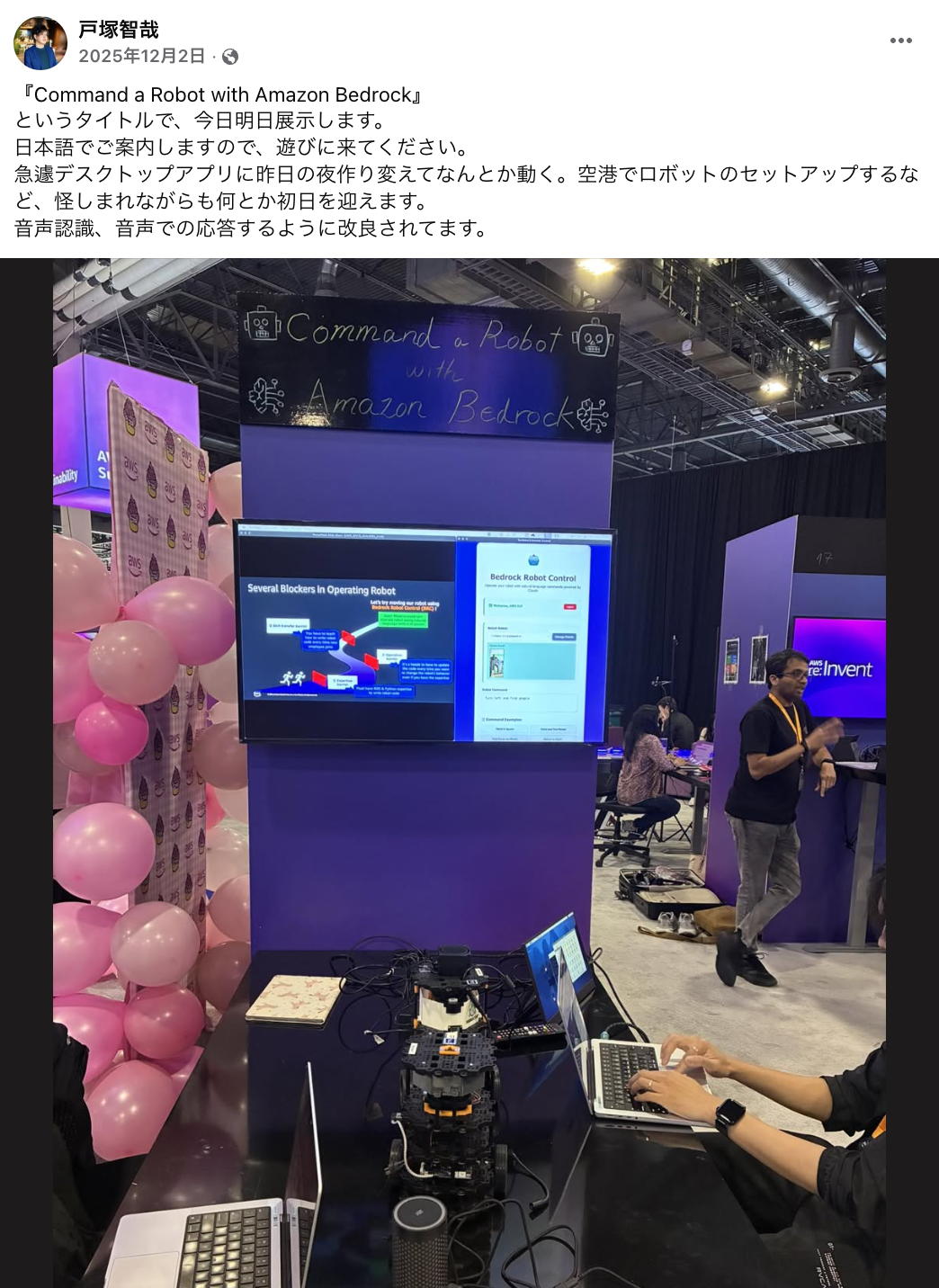

見に行ったきっかけは、下記のポストで AWS 戸塚さんが周知をされていたのを見つけたからでした。

Faceebook は Web 埋め込みできないのでキャプチャを貼っています。

Faceebook ポスト

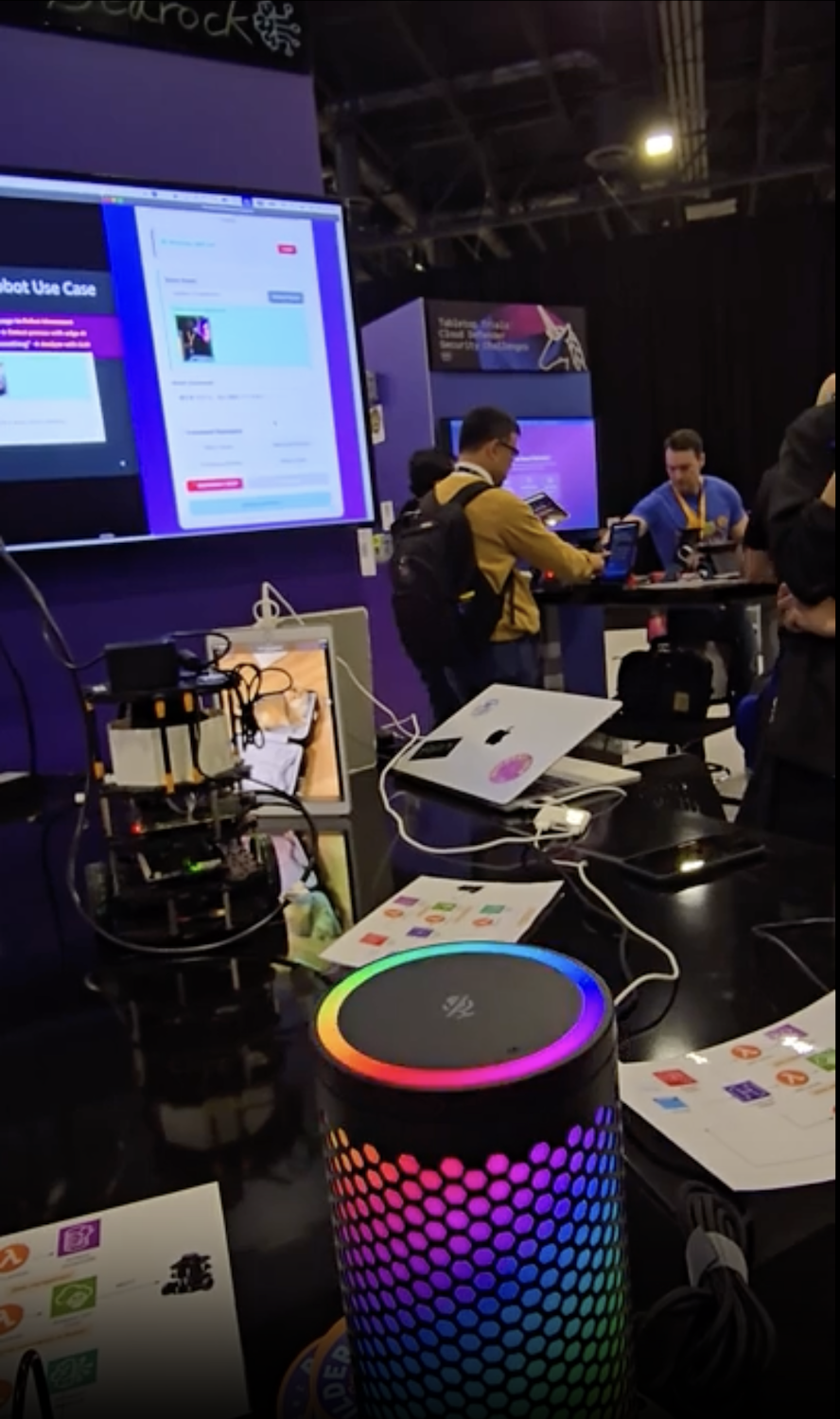

使われているロボットデバイスは TurtleBot3 と言う、ROS ベースのプログラムが可能な移動ロボットです。

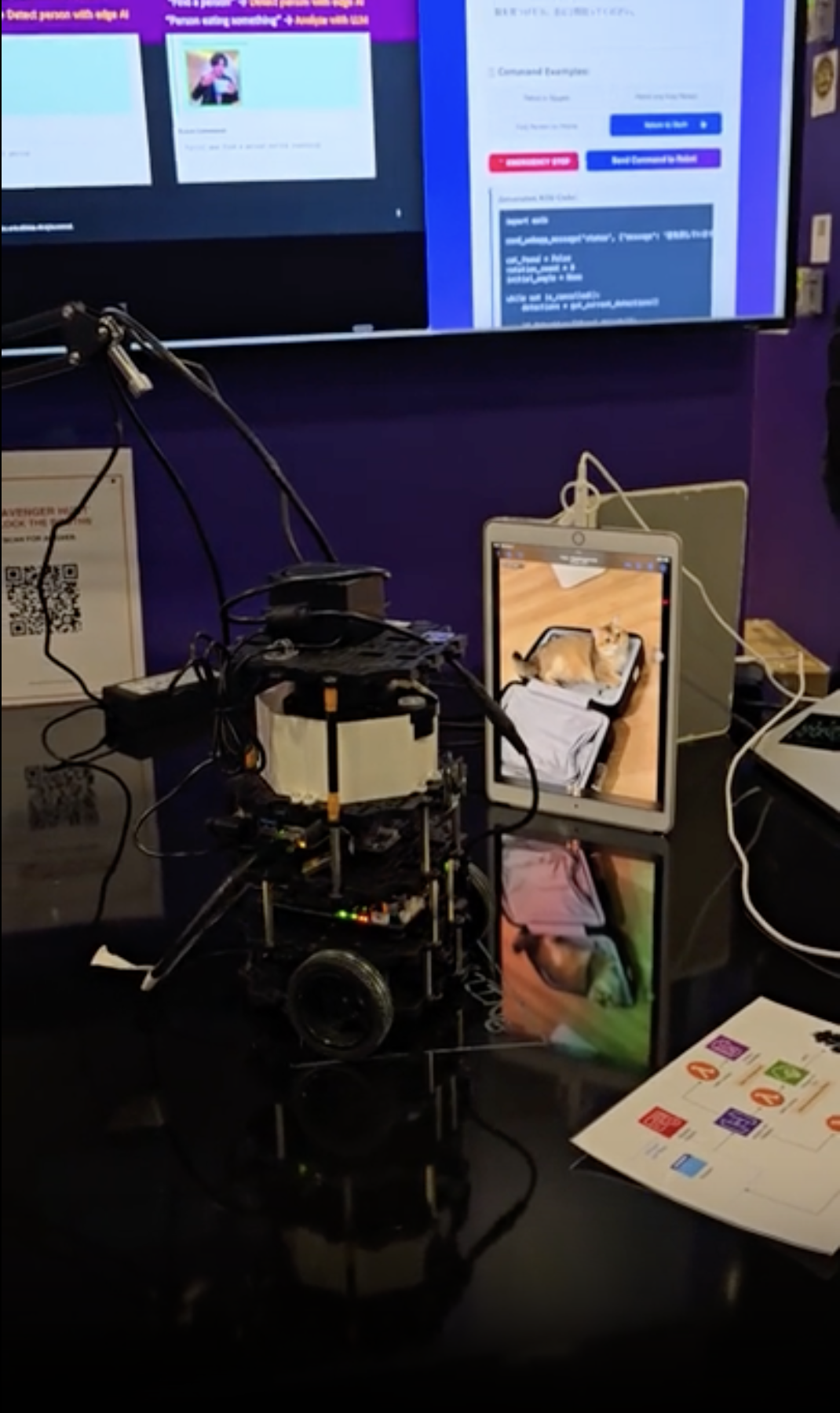

ロボットに付いたカメラ映像からの基本的な画像認識(猫の検出)はロボットのエッジで動く TensorFlow Lite で検出したらクラウドに送信し、さらに詳細な状況判断(猫がスーツケース内にいるかどうか等)は Amazon Bedrock で処理しています。Bedrock での判定が OK であれば、さらに人間から受けた自然言語の処理を ROS (Robot Operating System) コードに変換し、ロボットに指示を送信するという流れです。

ロボット開発におけるデファクトの OS となりつつある ROS は需要がある一方で習得難易度が高いので、プロンプトベースで ROS コードを自動生成することで、ロボット開発の敷居を下げることができるというのがポイントです。

実際に「猫を見つけたら右に2周回って」と言う若干無茶振りな指示をしてみました。iPad に表示されている猫の写真をロボットが認識したら、指示通りにグルグル回り始めました。(途中で通信用ケーブルがロボット自身に巻き付いて人間が解いてあげる必要がありました)

マイクから音声で指示を与える

猫を見つけたロボットが回り始めた

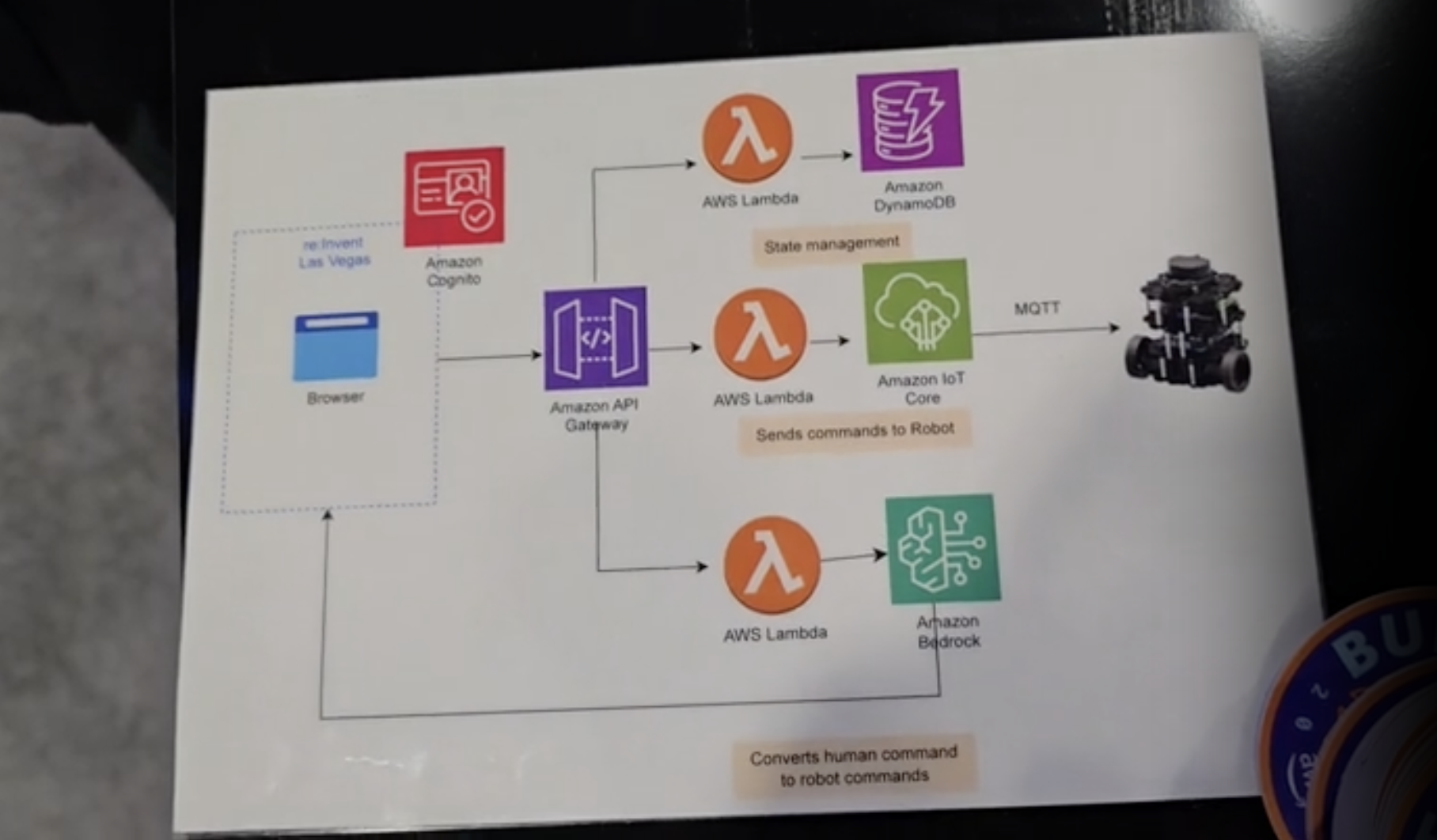

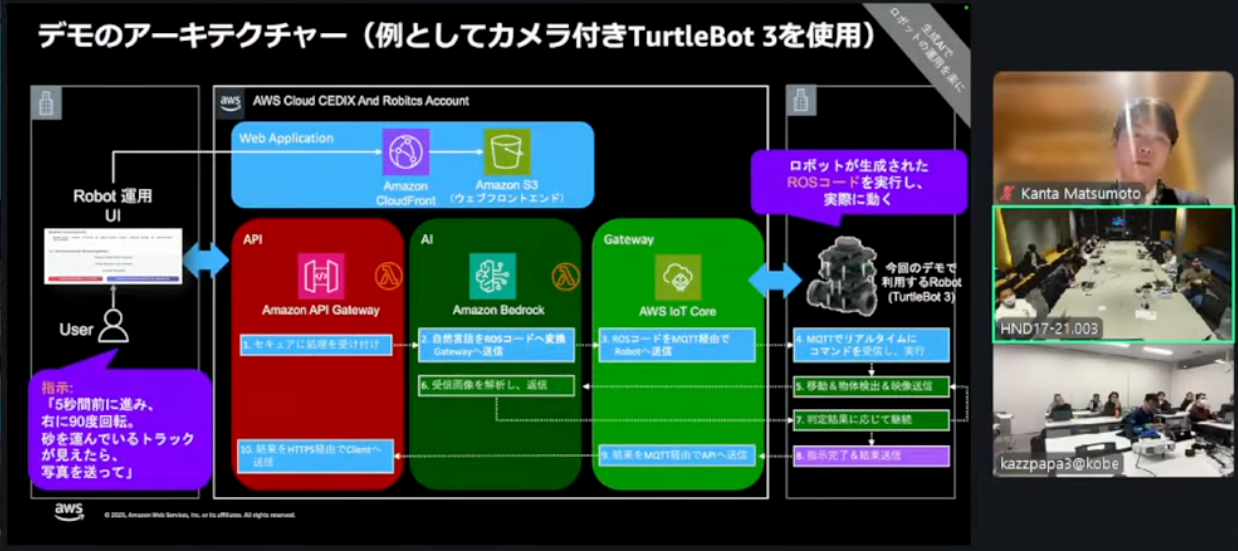

クラウド側のアーキテクチャはこのようになります。基本的にサーバーレスで構成されています。

アーキテクチャ

このデモのユースケースとしては、今回のようなペットの監視と行動記録をするペットカメラや、家庭内や施設内を巡回監視して特定の人物や物体の検出・報告を行うパトロールロボットなどがあるそうです。

実はこの展示は最近の JAWS-UG IoT 専門支部イベントでも取り上げられていました。アーキテクチャがより詳しく説明されているので合わせてご覧ください。

ユーザーが UI からテキストもしくは音声で指示を与えると、その指示を Amazon Bedrock が ROS コードに変換し、AWS IoT Core が MQTT 経由でロボットに送信、ロボットが動作するという仕組みになっているそうです。

おわりに

EXPO の AWS Builders' Fair で「対話型セキュリティ監視ロボット」を体験してきたのでそのレポートでした。

re:Invent の EXPO などの展示では基本的に英語ネイティブな方が対応しているため、我々のような日本語ネイティブにはハードルが高いこともありますが、今回紹介したように日本人の方が対応しているブースもあります。事前に情報をキャッチアップして、次回以降の re:Invent で足を運んでみてはいかがでしょうか。

以上