Amazon EC2 GPU インスタンスの RI 対応状況を調査してみた

はじめに

機械学習や AI ワークロードの増加に伴い、GPU インスタンスの利用が拡大しています。最近発表される GPU インスタンスは軒並み Reserved Instances(以降 RI)は非提供な印象がありました。その代わりに Capacity Block for ML や Savings Plans(以降 SP)に対応しています。私の疑問はいつ頃から RI は提供されなくなり、昔の GPU インスタンスは今も RI 購入できるのか気になったの調べました。

調査結果サマリ

2023 年後半を境に RI の提供方針が変化し、最新の高性能な GPU インスタンスは Capacity Blocks for ML がカバーしている。

- 2023 年 7 月の P5 までは RI 対応

- 2023 年 11 月の DL2q 以降、新しい高性能 GPU インスタンスは RI 非対応

- Capacity Blocks for ML が 2023 年 11 月にリリース

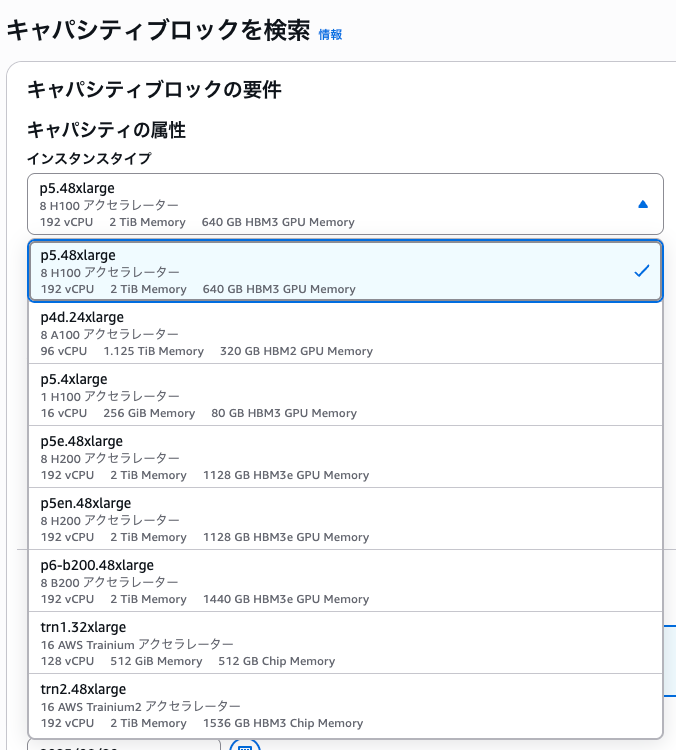

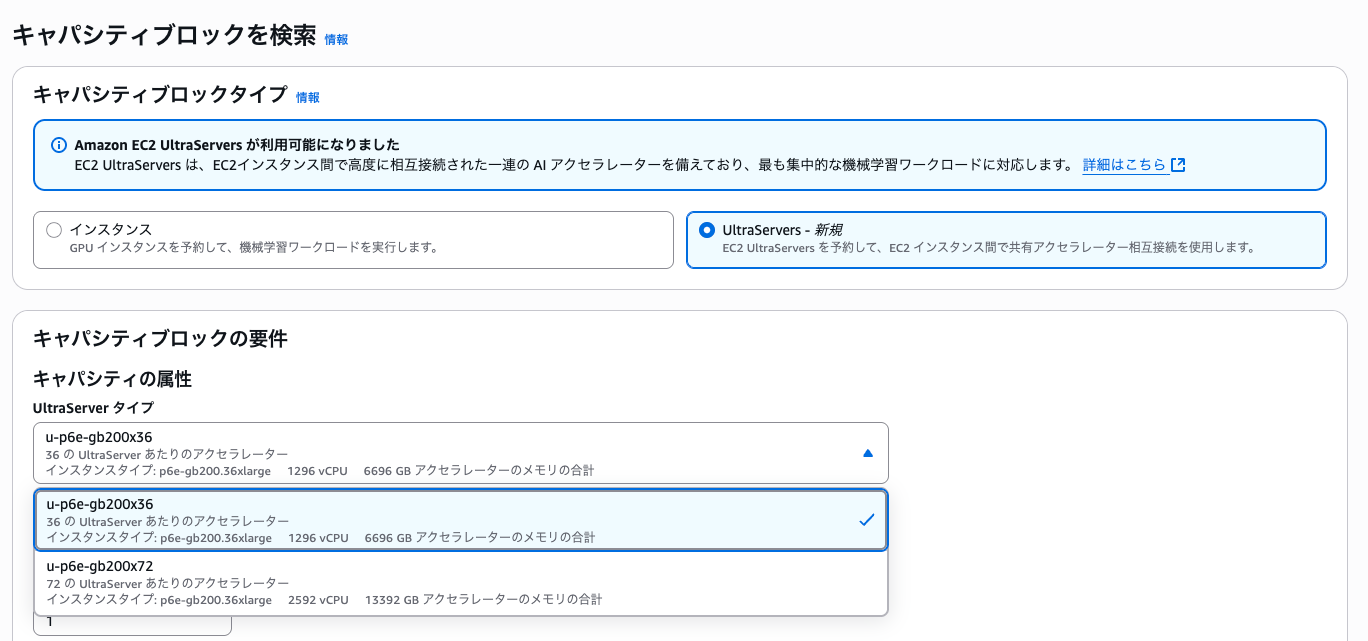

- P 系、Trn 系をサポートしており、キャパシティ予約と割引を提供

- G 系は現時点で最新の G6 も RI 提供を継続中

調査方法

以下の方法で調査を実施しました。

- AWS CLI で

aws ec2 describe-reserved-instances-offeringsを実行 - 対象リージョンは

us-east-1を指定 - 各インスタンスファミリーから代表して以下のインスタンスタイプで確認

- g3.4xlarge

- g3s.xlarge

- g4dn.xlarge

- g4ad.xlarge

- g5.xlarge

- g5g.xlarge

- g6.xlarge

- g6e.xlarge

- p2.xlarge

- p3.2xlarge

- p3dn.24xlarge

- p4d.24xlarge

- p4de.24xlarge

- p5.48xlarge

- p5e.48xlarge

- p5en.48xlarge

- p6.48xlarge

- p6e.48xlarge

- inf1.xlarge

- inf2.xlarge

- dl1.24xlarge

- dl2q.24xlarge

- trn1.2xlarge

- trn1n.32xlarge

- trn2.48xlarge

調査コマンド

# 特定のインスタンスタイプの RI 提供状況を確認

aws ec2 describe-reserved-instances-offerings \

--instance-type p5.48xlarge \

--product-description "Linux/UNIX" \

--region us-east-1

調査結果

RI 対応状況をまとめました。GPU 情報と、リリース時期も欲しかったのでついでに調べました。リリース時期は Web から GA の日付を追えないものもあったり、日本語訳のリリース記事しか見つからなかったりもしたので一部ズレている可能性があります。ご了承ください。

| インスタンスファミリー | GPU/アクセラレータ | RI対応 | リリース時期 |

|---|---|---|---|

| G3 | NVIDIA Tesla M60 | ❌ | 2017年7月 |

| G3s | NVIDIA Tesla M60 | ✅ | 2018年11月 |

| G4dn | NVIDIA T4 | ✅ | 2019年9月 |

| G4ad | AMD Radeon Pro V520 | ✅ | 2020年12月 |

| G5 | NVIDIA A10G | ✅ | 2021年11月 |

| G5g | NVIDIA T4G | ✅ | 2021年11月 |

| G6 | NVIDIA L4 | ✅ | 2024年6月 |

| G6e | NVIDIA L40S | ✅ | 2024年8月 |

| P2 | NVIDIA Tesla K80 | ❌ | 2016年9月 |

| P3 | NVIDIA Tesla V100 | ✅ | 2017年10月 |

| P3dn | NVIDIA Tesla V100 | ✅ | 2018年12月 |

| P4d | NVIDIA A100 | ✅ | 2020年11月 |

| P4de | NVIDIA A100 | ✅ | 2022年5月(preview) |

| P5 | NVIDIA H100 | ✅ | 2023年7月 |

| P5e | NVIDIA H200 | ❌ | 2024年9月 |

| P5en | NVIDIA H200 | ❌ | 2024年12月 |

| P6 | NVIDIA Blackwell B200 | ❌ | 2025年5月 |

| P6e | NVIDIA Blackwell GB200 | ❌ | 2025年7月 |

| Inf1 | AWS Inferentia | ✅ | 2019年12月 |

| Inf2 | AWS Inferentia2 | ✅ | 2023年4月 |

| Trn1 | AWS Trainium | ✅ | 2022年10月 |

| Trn1n | AWS Trainium | ✅ | 2023年4月 |

| Trn2 | AWS Trainium2 | ❌ | 2024年12月 |

| DL1 | Habana Labs Gaudi | ✅ | 2021年10月 |

| DL2q | Qualcomm AI 100 | ❌ | 2023年11月 |

RI 提供方針の転換時期

こうやって見ると2023年後半を境に RI の提供方針が変化していることがわかります。

インスタンスタイプ別の傾向

- P シリーズ(ハイパフォーマンス):P5(2023 年 7 月)までは RI 対応、P5e 以降は RI 非対応

- G シリーズ(汎用 GPU):最新世代の G6 でも RI 提供を継続中

- その他:DL2q、Trn2 など 2023 年後半以降にリリースのものは RI 非対応

考察

前提として AWS は公式ドキュメントでは RI より SP を推奨しています。

"We recommend Savings Plans over Reserved Instances. Saving Plans are the easiest and most flexible way to save money on your AWS compute costs"

出典: AWS Documentation - Standard vs. Convertible offering classes

転換期となった 2023 年後半にあたる 2023 年 11 月に Capacity Blocks for ML がリリースされました。GPU インスタンスを任意の期間でキャパシティを予約できてかつ、基本的には割引を受けられるサービスです。

対象インスタンスファミリーが限定的ですが、RI 非提供の P 系、Trn 系をサポートしています。

P6e は現時点ではオハイオリージョンしか提供されていないため、オハイオリージョンから確認した画面です。

RI 未提供のインスタンスファイミリーは、DL 系を除けば Capacity Blocks for ML がカバーしていることになります。

GPU インスタンスの指定した台数を年単位で抑えておきたい需要も少なからずあります。エンドユーザー向けに推論や、GPU での計算処理(HPC as a Service)を提供している場合はリソース確保したいですよね。しかし P 系であればハイスペックで高額なため、必要なときに必要な台数を確保する方が合理的です。

まとめ

2023 年後半を境に AWS の GPU インスタンスの RI 提供方針が変化しました。最新の高性能 GPU インスタンスでは RI の代わりに Capacity Blocks for ML や Savings Plans が提供されています。G 系は現在も RI 対応を継続しており、用途に応じた選択が可能です。

おわりに

リリース時期の調査が大変でした。最後まで P4de のリリース日がわからなく、いろいろ見ていたら非公式のリリース日のタイムラインを見つけました。それでも P4de のリリース日はわかりませんでした。なにかの機会に使いそうなのでここで共有しておきます。