NVIDIA が最新オープンモデル Nemotron 3 Super を発表したので Cloudflare Workers AI で試してみた

ウィスキー、シガー、パイプをこよなく愛する大栗です。

2026年3月11日に NVIDIA が最新のオープンモデル Nemotron 3 Super を発表し、Cloudflare Workers AI でも利用可能になりましたので早速試してみました。

- Introducing Nemotron 3 Super: An Open Hybrid Mamba-Transformer MoE for Agentic Reasoning

- Nemotron 3 Super — NVIDIA Research

- NVIDIA Nemotron 3 Super Technical Report (PDF)

- Cloudflare Changelog: Nemotron 3 Super on Workers AI

- Workers AI Model: nemotron-3-120b-a12b

Nemotron 3 Super とは

Nemotron 3 Super は NVIDIA が発表した、マルチエージェント AI システムを念頭に設計されたオープンハイブリッドモデルです。総パラメータ数は 120B ですが、推論時にアクティブになるのは 12B のみという Mixture-of-Experts(MoE)アーキテクチャを採用しています。

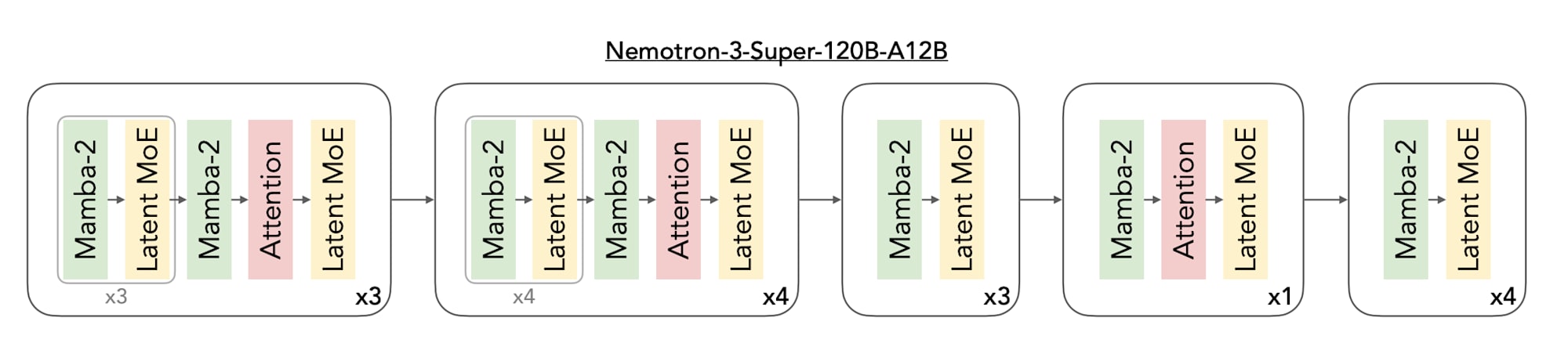

ハイブリッド Mamba-Transformer MoE アーキテクチャ

Nemotron 3 Super の最大の特徴は、3つの要素を組み合わせたハイブリッドアーキテクチャです。

NVIDIA Corporation. "Nemotron 3 Super: Open, Efficient Mixture-of-Experts Hybrid Mamba-Transformer Model for Agentic Reasoning". Research at NVIDIA. 2026-03. https://research.nvidia.com/labs/nemotron/files/NVIDIA-Nemotron-3-Super-Technical-Report.pdf, (2026-03-12)

| レイヤー | 役割 |

|---|---|

| Mamba-2 層 | 線形計算量でのシーケンス処理。長いコンテキストを効率的に扱う |

| Transformer Attention 層 | 精密な記憶の想起 |

| MoE(Mixture-of-Experts)層 | 密な計算なしにパラメータ数をスケールアップ |

従来の Transformer モデルは長いシーケンスになるほど計算コストが二乗で増加しますが、Mamba-2 は線形計算量でシーケンスを処理できます。一方で Mamba 単独では精密な記憶の想起が苦手なため、Transformer Attention を組み合わせることで双方の長所を活かしています。

主な特徴

- Latent MoE

- 従来の MoE と比較して、同じ計算コストで4倍のエキスパートを持てる Latent MoE を採用しています。エキスパート数を増やすことで、より多様なタスクに対応できるようになっています。

- Multi-token prediction(MTP)

- ネイティブな Multi-token prediction により、投機的デコーディング(speculative decoding)を組み込みでサポートしています。コード生成やツール呼び出し等の構造化タスクでは、別途ドラフトモデルを用意することなく最大3倍の実時間高速化を実現します。

- 1M トークンのコンテキストウィンドウ

- ネイティブで 1M トークンのコンテキストウィンドウをサポートしています。マルチエージェント環境では「コンテキスト爆発」と呼ばれる問題(通常のチャットの最大15倍のトークンを消費する)が発生しやすいのですが、長大なコンテキストに対応することでエージェントの長期記憶として活用できます。

- NVFP4 ネイティブ事前学習

- NVIDIA Blackwell GPU に最適化された NVIDIA の 4 ビット浮動小数点形式 NVFP4 でネイティブ事前学習されています。チェックポイントは NVFP4、FP8、BF16 の各量子化形式で公開されています。

- マルチ環境強化学習

- 21 種類の設定(環境)でマルチ環境強化学習を行っています。これにより、様々なエージェントタスクに対応できる汎用的な推論能力を獲得しています。

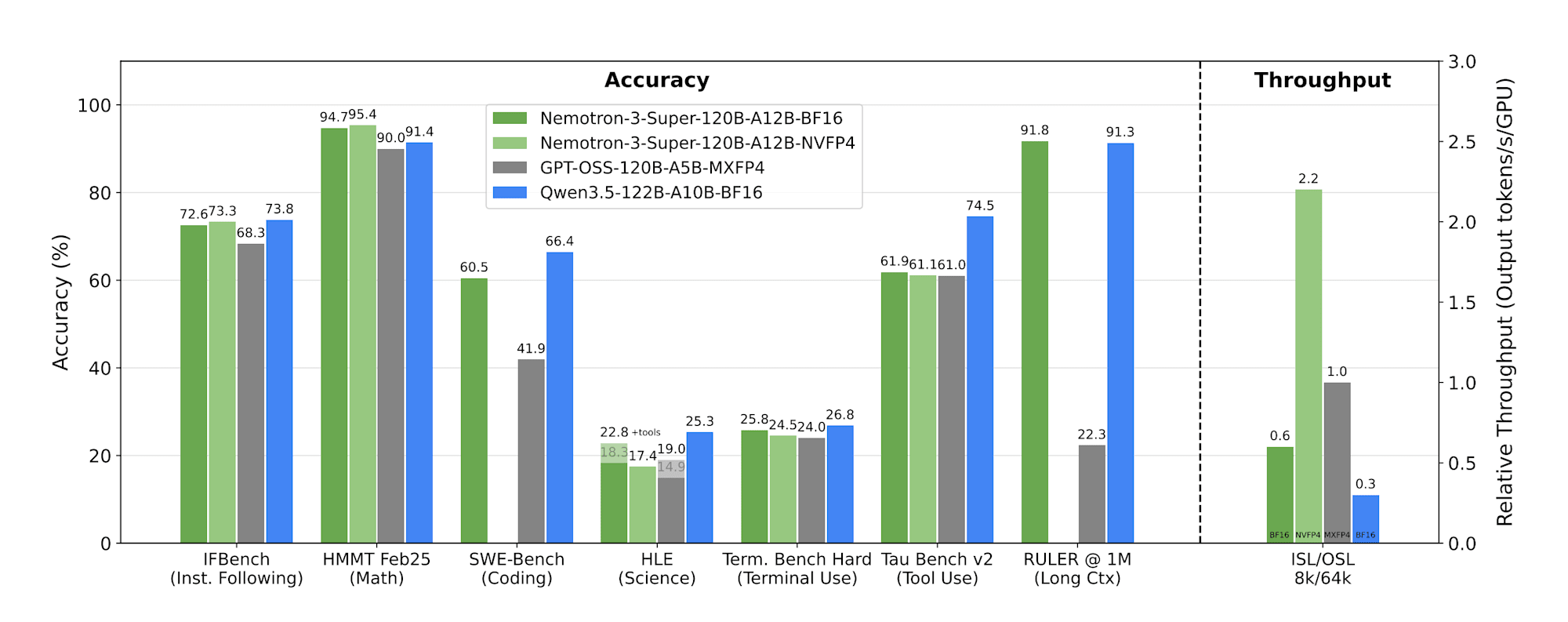

ベンチマーク

同規模モデルとのスループット・精度比較は以下の通りです(スループットは B200 GPU、vLLM/TRT-LLM で計測、8k 入力 / 64k 出力、Nemotron 3 Super NVFP4 を 1.0 として正規化)。

| モデル | 量子化 | Nemotron 3 Super 比スループット | PinchBench 成功率 |

|---|---|---|---|

| Nemotron 3 Super | NVFP4 | —(基準) | 85.6% |

| GPT-OSS-120B | MXFP4 | 2.2倍 | 54.0% |

| Qwen3.5-122B | BF16 | 7.5倍 | 84.5% |

1M トークンのコンテキストを使った RULER テストでも、上記両モデルを上回る正解率を出しています。

NVIDIA Corporation. "Nemotron 3 Super: Open, Efficient Mixture-of-Experts Hybrid Mamba-Transformer Model for Agentic Reasoning". Research at NVIDIA. 2026-03. https://research.nvidia.com/labs/nemotron/files/NVIDIA-Nemotron-3-Super-Technical-Report.pdf, (2026-03-12)

NVIDIA Nemotron 3 Super の入手

build.nvidia.com、Perplexity、OpenRouter、Hugging Faceからアクセスできます。企業や開発者は複数のパートナーを通じてモデルをデプロイできます。

- クラウドサービスプロバイダー

- Google Cloud

- Oracle Cloud Infrastructure

- Amazon Web Services と Microsoft Azure は近日中に対応します。

- NVIDIA クラウドパートナー

- Coreweave

- Crusoe

- Nebius

- Together AI

- インファレンスサービスプロバイダー

- Baseten

- Cloudflare ← 本エントリで利用します。

- DeepInfra

- Fireworks AI

- Inference.net

- Lightning AI

- Modal

- FriendliAI

- データ プラットフォームとサービス

- Distyl

- Dataiku

- DataRobot

- Deloitte

- EY

- Tata Consultancy Services.

Cloudflare Workers AI での利用

Cloudflare Workers AI では 2026年3月11日より Nemotron 3 Super が利用可能になりました。

| 項目 | 値 |

|---|---|

| モデルID | @cf/nvidia/nemotron-3-120b-a12b |

| コンテキストウィンドウ | 32,000 トークン |

| Function calling | 対応 |

| 入力料金 | $0.50 / 1Mトークン |

| 出力料金 | $1.50 / 1Mトークン |

| ライセンス | NVIDIA Nemotron Open Model License |

なお、Workers AI では Nemotron 3 Super のネイティブの 1M トークンコンテキストではなく、32,000 トークン での利用となります。Function calling に対応していますので、エージェントのツール呼び出しにも活用できます。

やってみる

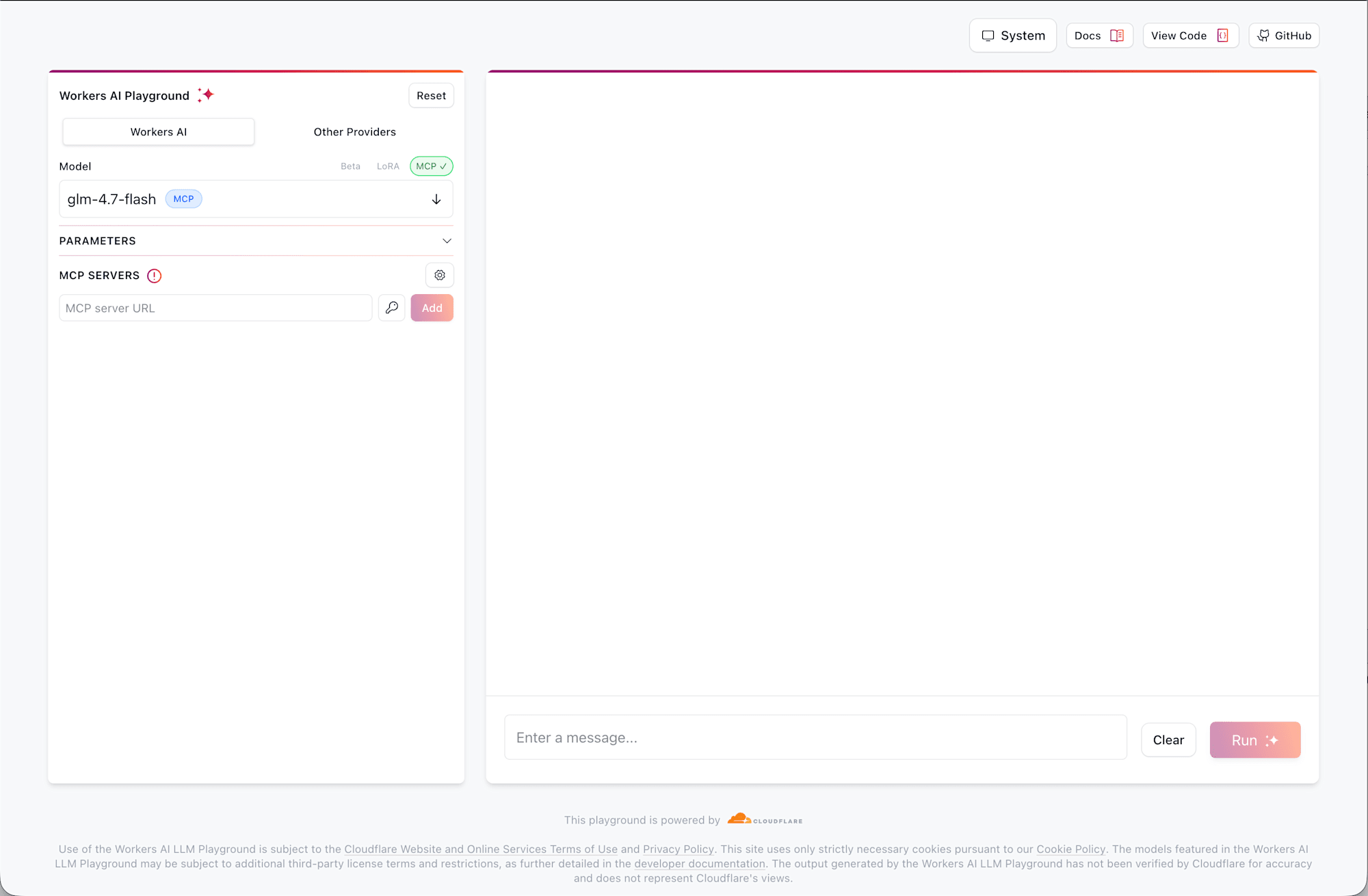

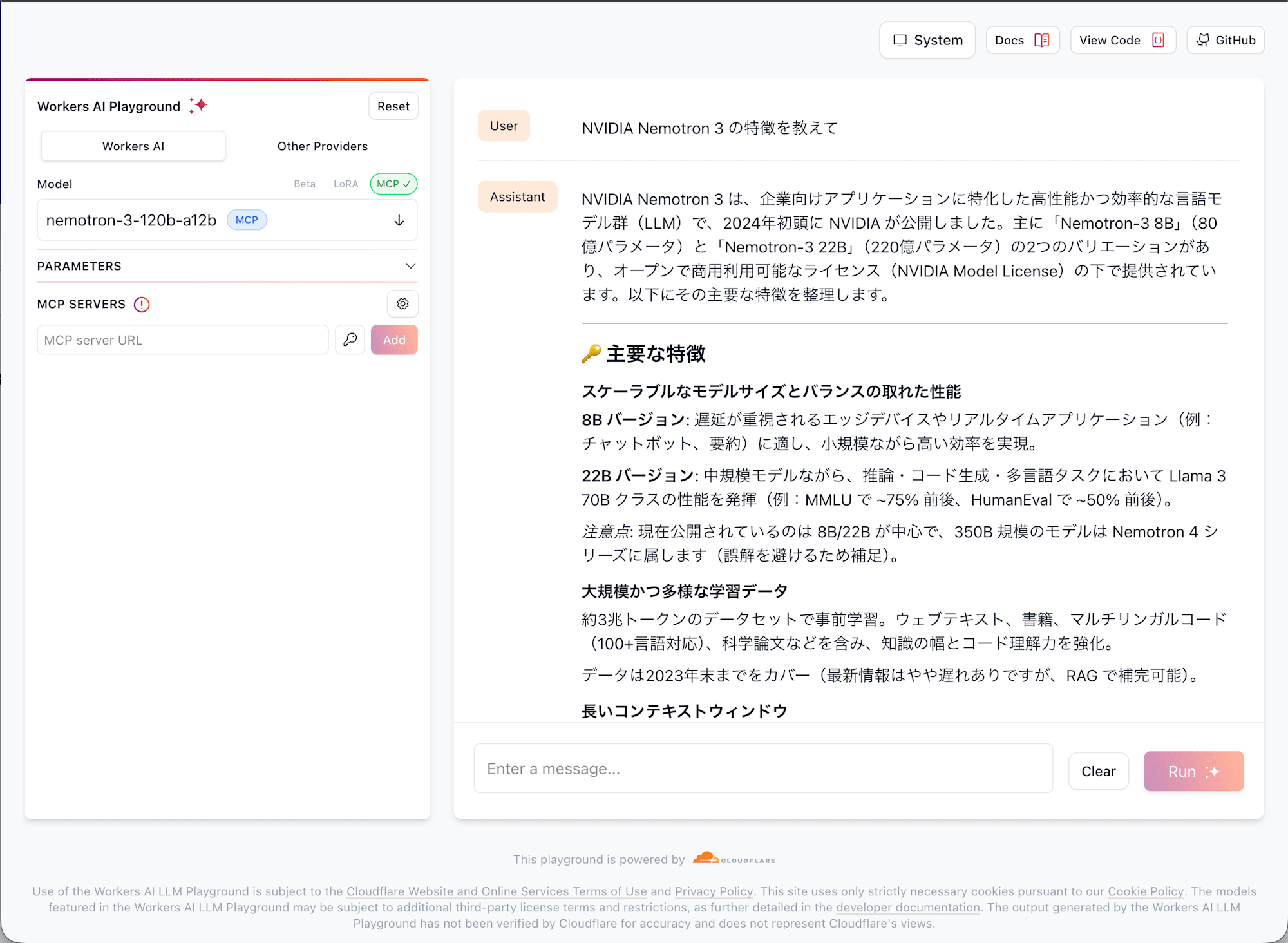

LLM Playground で試す

Cloudflare Workers AI には、ブラウザから手軽にモデルを試せる LLM Playground が用意されています。Cloudflare の Workers AI Playground を開きます。ログイン不要です。

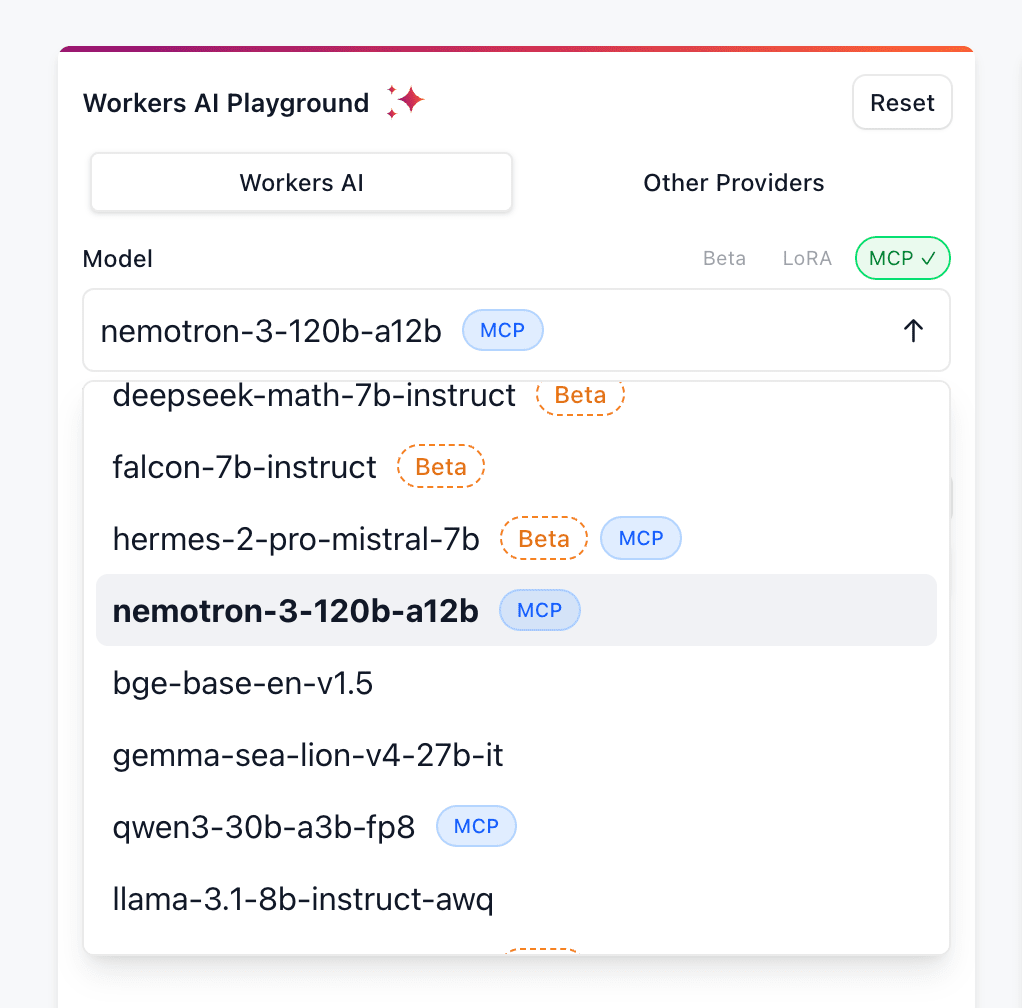

モデル一覧から @cf/nvidia/nemotron-3-120b-a12b を選択します。

『NVIDIA Nemotron 3 の特徴を教えて』と聞くと、以下のように回答が返ってきます。

Nemotron 3 Super の回答の全文

NVIDIA Nemotron 3 は、企業向けアプリケーションに特化した高性能かつ効率的な言語モデル群(LLM)で、2024年初頭に NVIDIA が公開しました。主に「Nemotron-3 8B」(80億パラメータ)と「Nemotron-3 22B」(220億パラメータ)の2つのバリエーションがあり、オープンで商用利用可能なライセンス(NVIDIA Model License)の下で提供されています。以下にその主要な特徴を整理します。

🔑 主要な特徴

スケーラブルなモデルサイズとバランスの取れた性能

8B バージョン: 遅延が重視されるエッジデバイスやリアルタイムアプリケーション(例:チャットボット、要約)に適し、小規模ながら高い効率を実現。

22B バージョン: 中規模モデルながら、推論・コード生成・多言語タスクにおいて Llama 3 70B クラスの性能を発揮(例:MMLU で ~75% 前後、HumanEval で ~50% 前後)。

注意点: 現在公開されているのは 8B/22B が中心で、350B 規模のモデルは Nemotron 4 シリーズに属します(誤解を避けるため補足)。

大規模かつ多様な学習データ

約3兆トークンのデータセットで事前学習。ウェブテキスト、書籍、マルチリンガルコード(100+言語対応)、科学論文などを含み、知識の幅とコード理解力を強化。

データは2023年末までをカバー(最新情報はやや遅れありですが、RAG で補完可能)。

長いコンテキストウィンドウ

標準で 32,768 トークン のコンテキスト長をサポート(例:約50ページの日本語ドキュメントを一度に処理可能)。

スライディングウィンドウ注意機構や効率的なメモリ管理により、長文要約や複数ドキュメント分析にも適応。

NVIDIA エコシステムへの最適化

TensorRT-LLM との統合で、FP8 精度量産やTensor Core最適化により、H100/A100 GPU でのスループットを大幅向上(例:22B モデルで Llama 2 70B 比 2~3倍高速化)。

量子化対応(INT4/FP8)により、メモリ使用量を削減し、単一 GPU でも実行可能(例:22B モデルを INT4 で ~13GB VRAM で動作)。

Triton Inference Server や NeMo Framework とシームレスに連携し、本番環境でのデプロイを簡素化。

安全性と信頼性への配慮

人間のフィードバックから学ぶ強化学習(RLHF)と拒否サンプリングを組み合わせたアライメント手法で、有害出力やバイアスを低減。

NeMo Guardrails との親和性が高く、企業向けにトピック制御やポリシー違反検出を組み込みやすい設計。

NVIDIA AI Enterprise サブスクリプション対応で、サポート・セキュリティパッチ・ライセンス保証が付帯。

マルチタスク対応力

ゼロショット/フェワショットで以下のタスクに強み:

自然言語理解(Q&A、要約、感情分析)

コード生成・デバッグ(Python、Java、SQL など対応)

多言語翻訳・クロスリンガル検索

RAG(Retrieval-Augmented Generation)パイプラインでの文脈 grounding

💡 典型的なユースケース

エンタープライズチャットボット: 社内ドキュメントやFAQを参照した正確な応答(例:HR・ITサポート)。

コンテンツ自動化: 市場レポート作成、多言語マーケティング文言生成。

開発者支援: コード補完、バグ修正提案、技術ドキュメント検索(例:GitHub Copilot 風ツールの基盤)。

データ分析補助: SQL生成、データ可視化の指示解釈、レポート作成の下書き。

⚠️ 留意点

マルチモーダル非対応: 画像や音声入力には対応していません(マルチモーダルが必要な場合は Nemotron 4 Vision などを検討)。

カスタマイズコスト: フルファインチューンにはリソースが必要ですが、LoRA や PEFT メソッドで効率的に適応可能(NVIDIA NeMo でサポート)。

知識の鮮度: 学習データのカットオフがあるため、最新事実が必要な場合は RAG やウェブ検索連携が必須。

📌 選ぶ際のポイント

遅延・コスト重視 → 8B バージョン(例:エッジデバイスや低遅延API)。

バランス重視(精度 vs. コスト) → 22B バージョン(ほとんどのエンタープライズタスクでコストパフォーマンスに優れる)。

既に NVIDIA エコシステムを利用中 → TensorRT-LLM や Triton での導入が特にスムーズ。

NVIDIA は「企業が安心してプロダクトに組み込める」ことを重視しており、安全性・効率性・サポート体制という観点で、汎用LLM(Llama 3、Mistral など)と差別化を図っています。詳細については、NVIDIAの公式ページまたは Hugging Face 上の Nemotron-3 8B / Nemotron-3 22B をご確認ください。

他に気になる点があれば、遠慮なくどうぞ! 😊

コーディングが不要で、すぐに動作を確認できるのが LLM Playground の便利なところです。

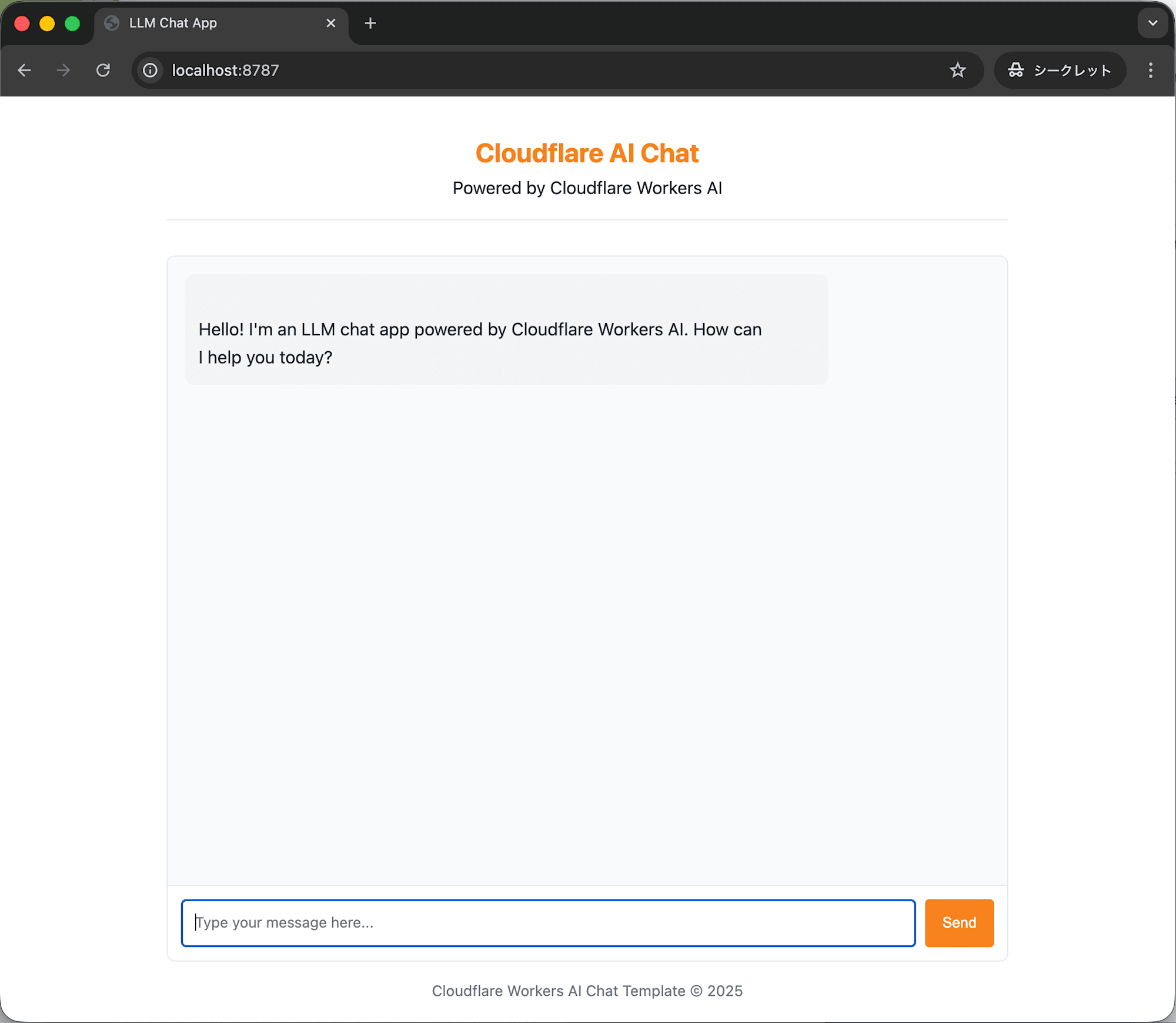

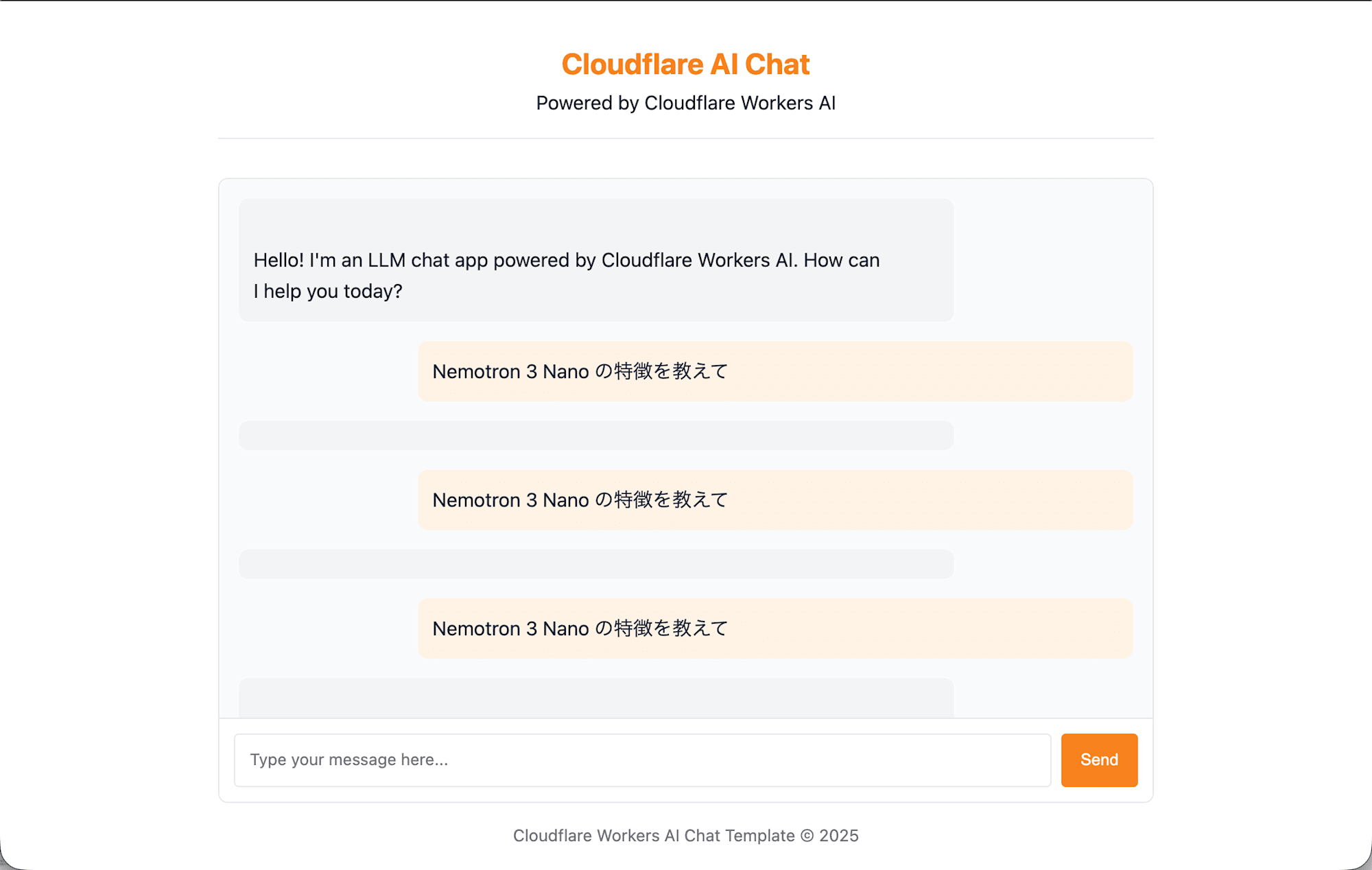

LLM Chat App Template で試す

Cloudflare 公式の llm-chat-app-template を使うと、SSE ストリーミング対応のチャット UI をすぐに動かせます。なお

1. リポジトリのクローンと依存インストール

$ git clone https://github.com/cloudflare/llm-chat-app-template

$ cd llm-chat-app-template

$ npm install

$ npm run cf-typegen

2. モデルを Nemotron 3 Super に変更

src/index.ts の冒頭にある MODEL_ID 定数を書き換えるだけです。

変更前:

// Model ID for Workers AI model

// https://developers.cloudflare.com/workers-ai/models/

const MODEL_ID = "@cf/meta/llama-3.1-8b-instruct-fp8";

変更後:

// Model ID for Workers AI model

// https://developers.cloudflare.com/workers-ai/models/

const MODEL_ID = "@cf/nvidia/nemotron-3-120b-a12b";

変更箇所はここだけです。wrangler.jsonc の AI バインディング設定はそのまま使えます。

3. ローカルで動作確認

$ npm run dev

http://localhost:8787 でチャット UI が起動します。なお、ローカル開発時も Cloudflare アカウントにアクセスするため、Workers AI の利用料金が発生します。

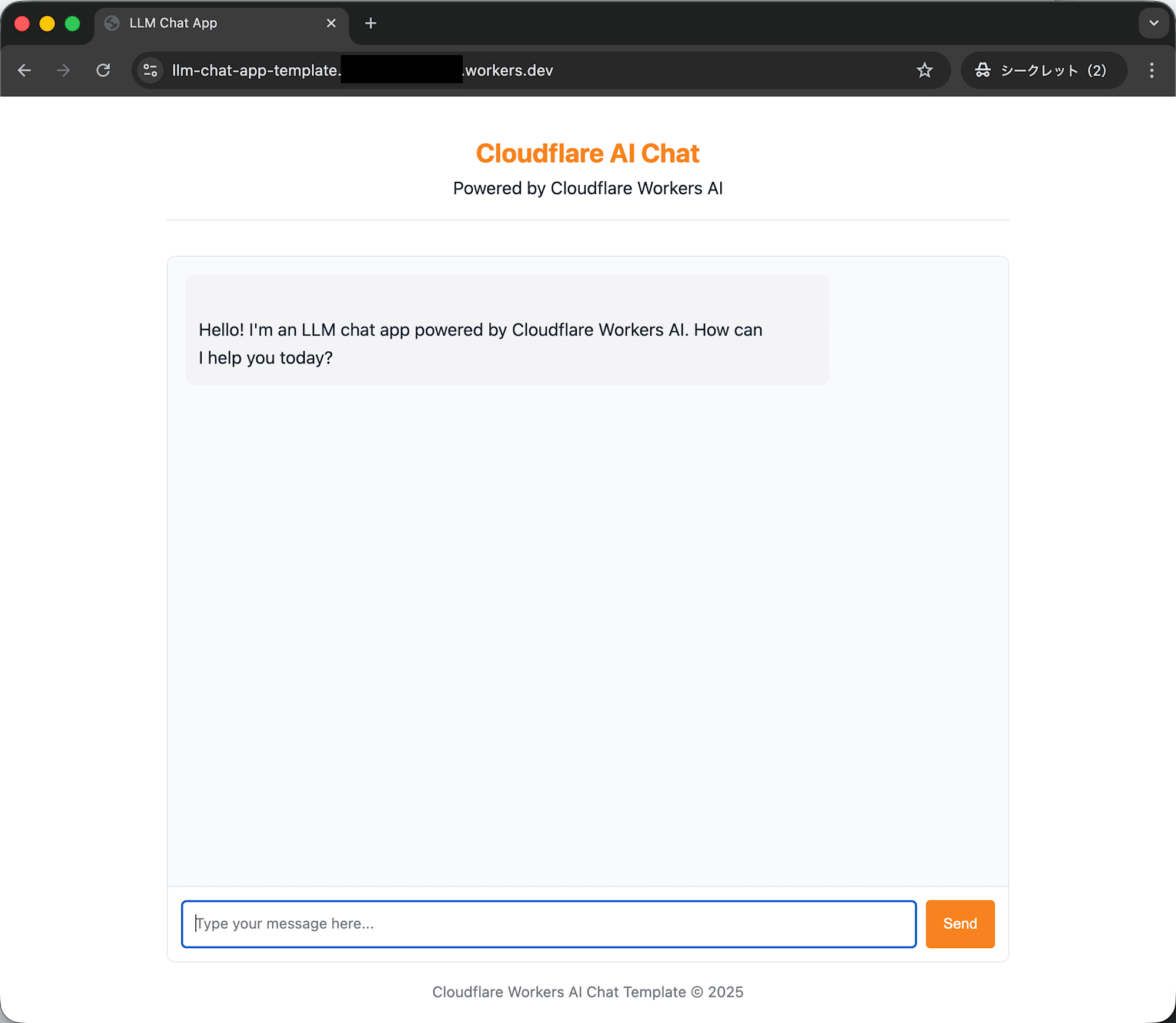

4. デプロイ

Cloudflare Workers にデプロイします。

$ npm run deploy

デプロイコマンドの結果の最後に出てくる URL にアクセスすると以下のようなページが表示されます。

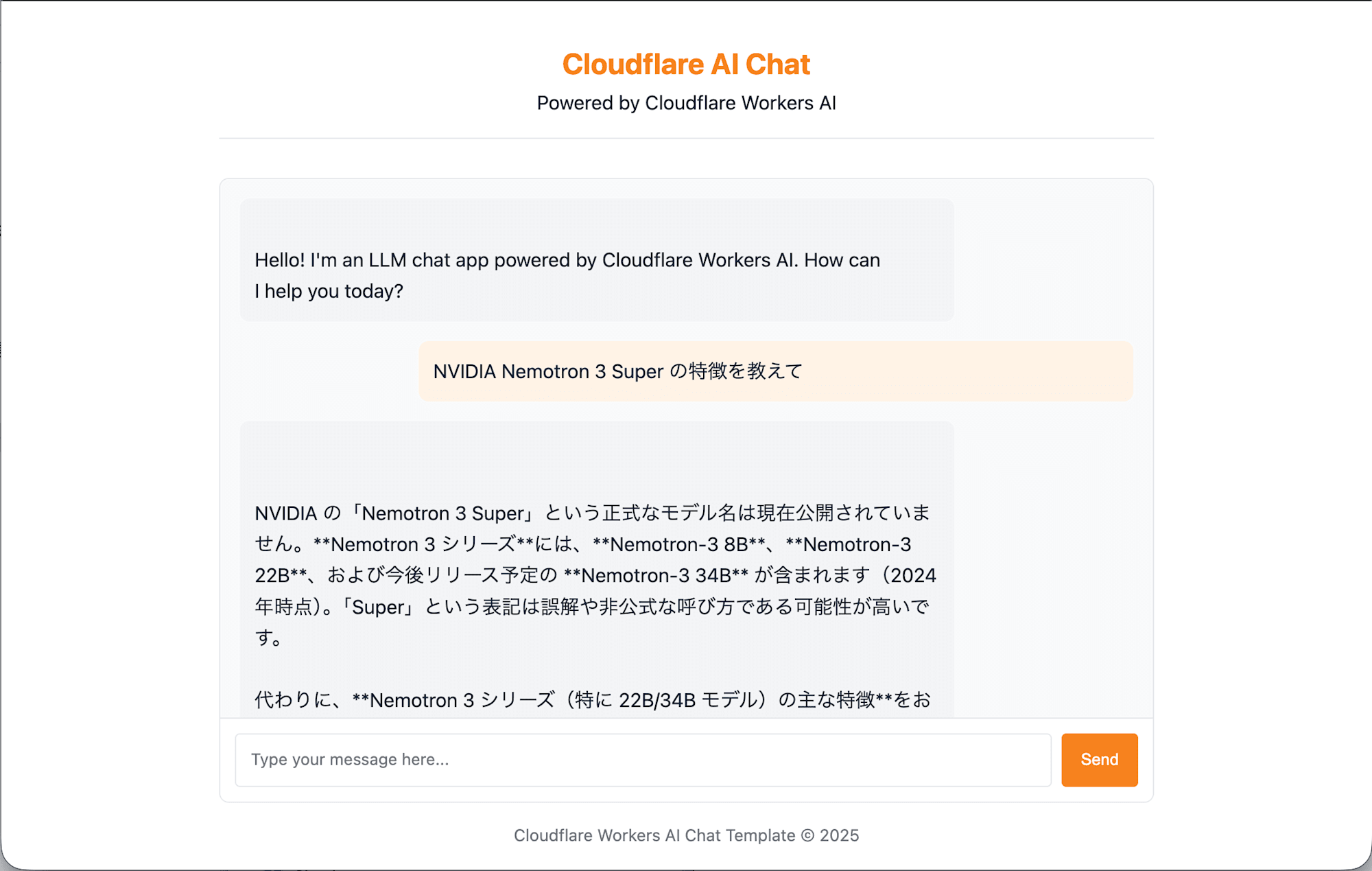

5. 動かしてみる

以下のように Nemotron 3 Super ベースの回答がされます。

ただし、たまに回答が帰って来ない事がありました。

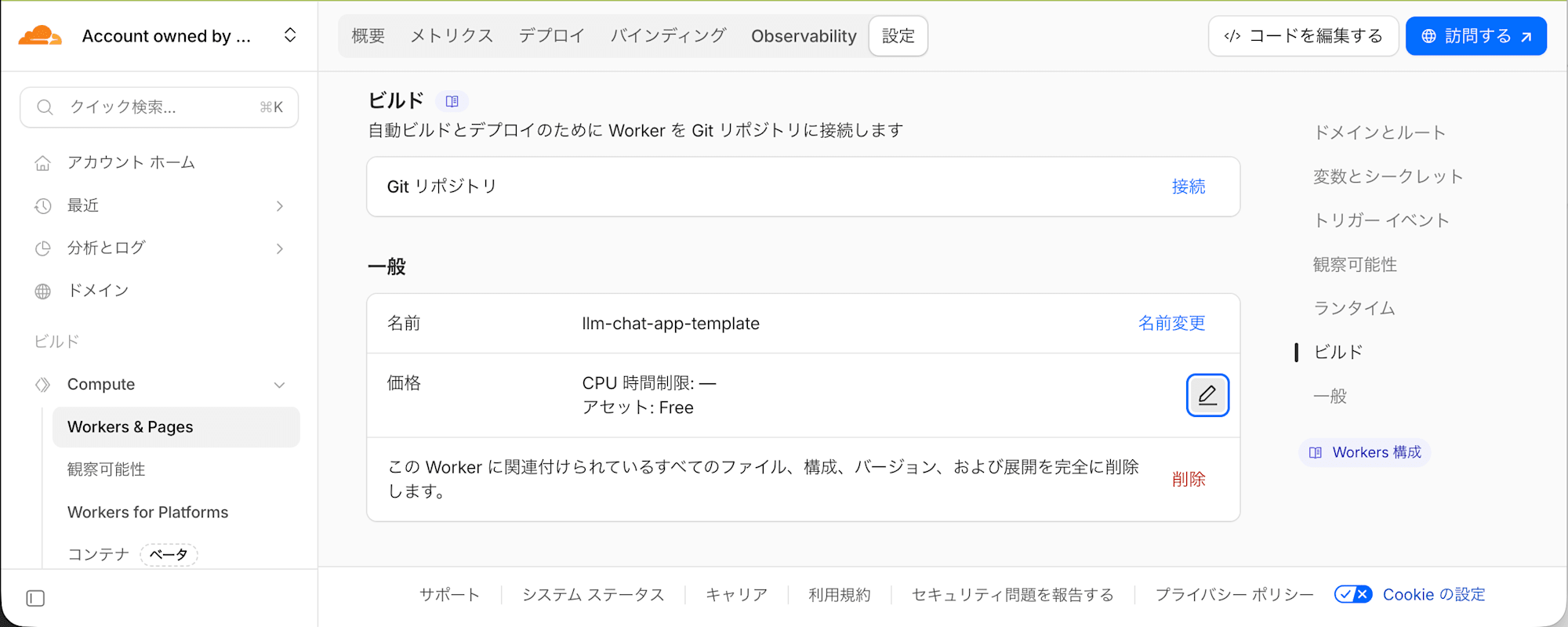

これはデフォルトだと CPU 時間の制限が設定されておらず、実行時間の制限で落ちているようでした。

wrangler.jsonc で Limits の設定を入れて再デプロイするか、ダッシュボードで設定します。ただしダッシュボードの変更では再デプロイ時に消えてしまうので、基本的に wrangler.jsonc を修正してください。

さいごに

Nemotron 3 Super は、Mamba と Transformer、そして MoE を組み合わせたアーキテクチャで、スループットと精度を高いレベルで両立しているのが印象的です。特に、エージェント AI の課題である「コンテキスト爆発」に対して、1M トークンの長大なコンテキストウィンドウとネイティブの投機的デコーディングで対応している点は、実用的なマルチエージェントシステムを構築する上で非常に心強いです。

Cloudflare Workers AI で手軽に利用できるようになったことで、エッジでのエージェント AI 活用の可能性がさらに広がります。まずは LLM Playground で気軽に動作を確認してみて、ユースケースに合うかどうか試してみることをお勧めします。