Amazon Connect AIエージェントで日本国内に閉じたClaude Sonnet 4.5 が利用できるようになってました

はじめに

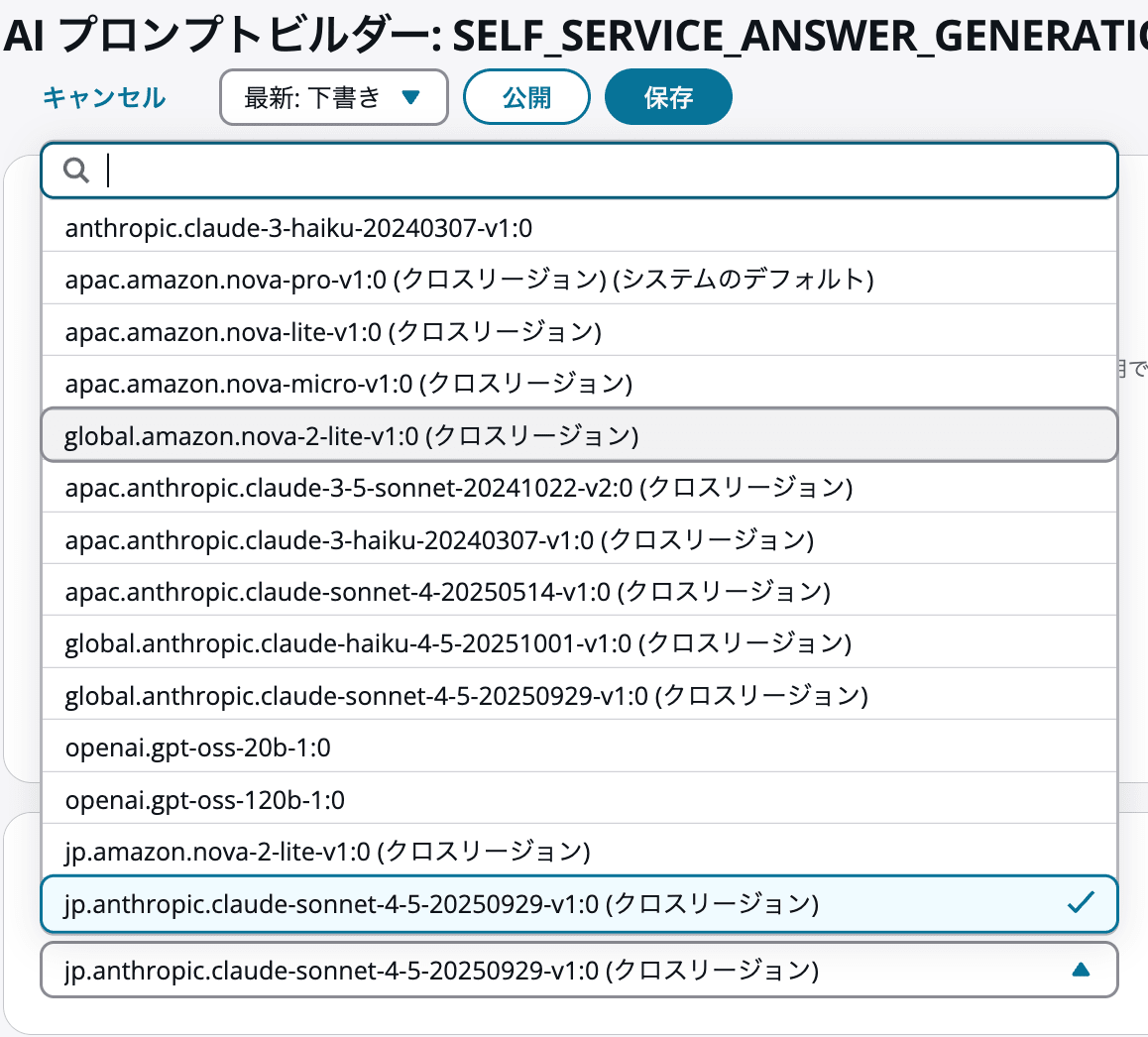

What's Newでアナウンスは確認できませんでしたが、東京リージョンのAmazon ConnectのAIエージェントで、以下のモデルが選択できるようになっていました。

jp.amazon.nova-2-lite-v1:0jp.anthropic.claude-sonnet-4-5-20250929-v1:0

特に注目したいのは、Amazon Connect AIエージェントで日本国内に閉じた Claude Sonnet 4.5 が利用できるようになった点です。

従来、東京リージョンのAmazon Connectで選択できるモデルは以下の11つでした。

anthropic.claude-3-haiku-20240307-v1:0apac.amazon.nova-lite-v1:0apac.amazon.nova-pro-v1:0apac.amazon.nova-micro-v1:0apac.anthropic.claude-3-5-sonnet-20241022-v2:0apac.anthropic.claude-3-haiku-20240307-v1:0apac.anthropic.claude-sonnet-4-20250514-v1:0global.anthropic.claude-haiku-4-5-20251001-v1:0global.anthropic.claude-sonnet-4-5-20250929-v1:0openai.gpt-oss-20b-1:0openai.gpt-oss-120b-1:0

今回新たに確認できたモデルは以下です。

jp.amazon.nova-2-lite-v1:0jp.anthropic.claude-sonnet-4-5-20250929-v1:0

本記事では、以下の記事を参考に、東京リージョンのAmazon Connectセルフサービスにて、AIプロンプトを利用したAIエージェントでモデル別のレスポンス速度を検証します。

利用可能なモデルの確認

AIプロンプトの設定画面で、各モデルを選択できることを確認しました。

jp.amazon.nova-2-lite-v1:0jp.anthropic.claude-sonnet-4-5-20250929-v1:0

レスポンス速度の検証

参考記事で紹介されている FOLLOW_UP_QUESTION ツールを利用して検証を行いました。このツールは、デフォルトツールやカスタムツールと連動し、適切なアクションを実行する前に必要な情報を段階的に収集できます。

今回は、1つずつヒアリングすると速度計測の差が出にくかったため、「複数情報の一括入力」で検証しました。使用チャネルはチャットです。自動回答は行わず、必要情報がすべてそろった際に COMPLETE_REPORT ツールを返すケースで、モデル処理時間を計測しました。

以下の記事を参考に、Amazon Connectのログを有効化し、ログからレスポンス時間を算出しました。

今回の記事では、モデル処理時間のみを比較対象としています。

具体的には、ログ内の metrics.latencyMs を使用しています。

検証結果

今回の検証で取得できたモデル処理時間は以下のとおりです。

約2.3秒〜2.5秒

global.anthropic.claude-haiku-4-5-20251001-v1:0

約2.6秒〜2.9秒

jp.anthropic.claude-sonnet-4-5-20250929-v1:0

約3.6秒〜3.9秒

global.anthropic.claude-sonnet-4-5-20250929-v1:0

約3.1秒〜4.8秒 ばらつきあり

apac.anthropic.claude-sonnet-4-20250514-v1:0

検証の結果、jp Claude Sonnet 4.5 は約2.6秒〜2.9秒 という結果でした。今回比較した Sonnet 系モデルの中では高速で、しかも安定している印象です。Amazon Connect AIエージェントで日本国内に閉じた Claude Sonnet 4.5 を使いたい場合、有力な選択肢になりそうです。

一方で、global Claude Sonnet 4.5 は約3.6秒〜3.9秒 と、今回の検証では jp Claude Sonnet 4.5 より遅い結果になりました。

今回の結果は、あくまで特定のプロンプトと入力パターンを用いた一例に過ぎません。本検証は一括入力によるヒアリング時の計測結果であり、問い合わせ内容やプロンプト構成によって応答速度は異なる可能性があります。記載した秒数はあくまで参考値として捉えてください。

モデル選定の考え方について

今回追加された jp.anthropic.claude-sonnet-4-5-20250929-v1:0 を見ると、jp と global のどちらを選ぶべきかも気になるところです。

Amazon Bedrock のドキュメントでは、データレジデンシー要件がある場合は地理的クロスリージョン推論を、地理的制限なしでスループットを最大化したい場合はグローバルクロスリージョン推論を選ぶ、という整理になっています。また、比較表でもスループットの観点では Global が推奨されています。

このため、ドキュメントの記載ベースで考えると、選定の方向性は次のように整理できます。

- データレジデンシー要件を重視するなら

jp - スループットを重視するなら

global

また、グローバルクロスリージョン推論は、より広い推論先を使える前提で説明されているため、可用性や混雑耐性の観点でも global のほうが有利な可能性があります。

一方で、今回の検証では、実際のモデル処理時間は jp のほうが global より短い結果になりました。

つまり、ドキュメント上は「スループットを最大化するなら Global」という整理ですが、今回の Amazon Connect AIエージェントでの検証では jp のほうが速い結果でした。そのため、ドキュメント上の推奨と、実際の利用シナリオでの処理時間は必ずしも一致しない可能性があります。

最終的には、データレジデンシー要件を優先するか、スループットや可用性を優先するかを整理したうえで、実際のシナリオでテストして選定するのがよさそうです。

最後に

Amazon ConnectのAIエージェントで、以下のモデルが新たに利用可能になっていました。

jp.amazon.nova-2-lite-v1:0jp.anthropic.claude-sonnet-4-5-20250929-v1:0

中でも、Amazon Connect AIエージェントで日本国内に閉じた Claude Sonnet 4.5 を利用できるようになったのは、大きなアップデートだと感じます。

データ所在を重視しつつ、Sonnet系モデルの応答速度も確保したい場合、jp.anthropic.claude-sonnet-4-5-20250929-v1:0 は有力な選択肢になりそうです。