iPhoneでGemma 4をLocally AIで動かしてみた

どうも!オペ部の西村祐二です!

X(旧Twitter)でGoogle Gemma公式アカウントの投稿が流れてきて、2026年4月にリリースされたGemma 4がiPhoneでも動かせることを知りました。気になったので、iPhone向けアプリの「Locally AI」を使ってiPhone 17 Pro Maxで実際に試してみました。

触ってみた体感と、今のところできないこと、これからに期待したいことをまとめます。

Gemma 4 / Locally AIとは

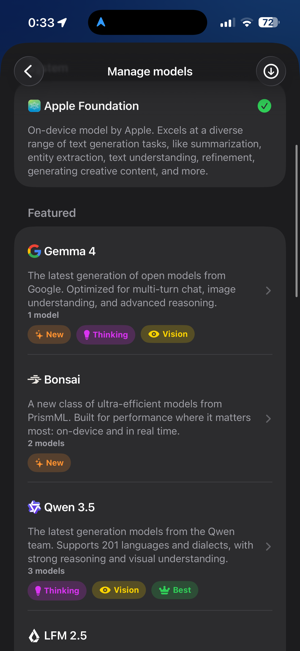

Gemma 4はGoogle DeepMindが2026年4月にリリースしたオープンウェイトのモデルファミリーです。パラメータサイズ違いで4種類用意されていて、このうちエッジ・モバイル向けに作られたE2B(実効2.3B相当)とE4B(実効4.5B相当)はオンデバイス実行が前提になっています。マルチモーダル対応とApache 2.0ライセンスで公開されている点が特徴的です。

Locally AIはiPhone / iPad / Macで完全オフラインでLLMを動かせる無料アプリです。開発者のAdrien Grondin氏が個人で開発していて、2026年4月にLM Studioが買収したことが発表されました。今後はLM Studioチームと一緒にモバイルAIの開発が進んでいくようです。

推論エンジンにはApple MLXが使われていて、Apple Siliconのunified memoryを活かした動作になっています。

試してみる

環境

- iPhone 17 Pro Max(A19 Pro)

- iOS 26

- Locally AI 1.54.0

- Gemma 4 E2B

1. Locally AIをインストールする

App StoreからLocally AIをインストールします。アプリを利用するためのアカウント登録は不要でした。

2. Gemma 4 E2Bをダウンロードする

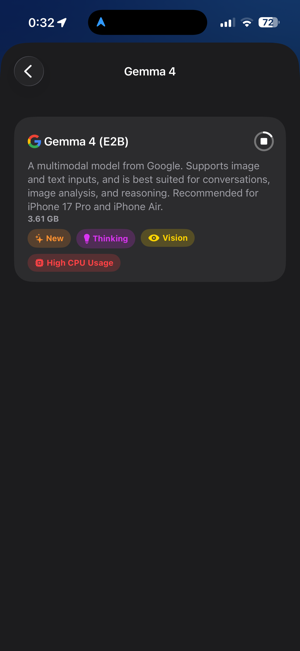

アプリを起動するとモデル選択画面が出てきます。一覧からGemma 4を選び、ダウンロードします。モデルごとに推奨性能やVision対応の有無が表示されるので、どれを選べばよいかが分かりやすかったです。

モデルのダウンロードが完了すれば準備完了です。ダウンロード以降は通信なしで動作します。

3. 会話してみる

チャット画面からメッセージを送ると、iPhone単体で応答が返ってきます。iPhone 17 Pro Maxでは応答がかなり軽快で、想像していたよりもずっとスムーズに動きました。機内モードに切り替えても動作することを確認できました。

4. 今のところできないこと

触っていくなかで、現状のLocally AI + Gemma 4 E2Bでは次のような機能は見当たりませんでした。

- Web検索(モデルが学習済みの知識の範囲で応答する)

- MCP(Model Context Protocol)経由での外部ツール連携

- iPhoneの操作(カレンダー追加・リマインダー作成などのショートカット連携は別途設定が必要)

Locally AIにはSiri Shortcuts連携やVoice Mode、画像入力などの機能も用意されているので、使い方次第で広がりそうな余地はありますが、「外の情報を引っ張ってきて要約する」「アプリを跨いで操作する」といった使い方は、今回試した構成ではそのままではできませんでした。

試してみた感想

iPhone 17上でGemma 4 E2Bがここまで軽快に動くことに驚きました。数年前までは、端末でLLMを動かすこと自体が現実的ではないと感じていたので、インターネットを介さず普通に会話できること自体が新鮮に感じました。通信なしで完結する安心感もあります。使った分だけ課金されるクラウドAIと違って、ランニングコストがかからないのも嬉しいポイントでした。

一方で、現在、Web検索やMCP、iPhone操作などは機能としてないので、実用シーンで何をしてもらうかは考えどころでした。調べ物や日常のちょっとした操作はクラウドのAIアシスタントに頼ってしまう場面が多いのが現状です。

なので、いまの自分の使い方は、Voice Modeで英会話の練習相手になってもらう使い方を試しています。クラウドAIと違ってオフラインで完結するので、料金気にせずに気軽に話したいときに取り出しやすく、練習用途には相性が良さそうだと感じています。

これから、オンデバイスモデルの性能向上とアプリ側の機能追加が同時に進んでいる流れだと思うので、このあたりがつながってきたときに使い方が一気に変わりそうな予感はあります。とてもワクワクする領域だと感じました。

まとめ

iPhone 17 Pro MaxでLocally AIを使ってGemma 4 E2Bを動かしてみた体験をまとめました。

- セットアップはアプリを入れてモデルを選ぶだけで完結する

- iPhone 17 Pro MaxではE2Bが軽快に動く

- 現時点ではWeb検索やMCP連携、OS横断の操作はできない

- オフラインで手元のLLMと会話できる体験自体に新しさを感じる

オンデバイスLLMに興味がある方は、まず触ってみるとこの数年の進化を体感できる気がします。

なお、調べているなかでGoogle公式のGoogle AI Edge GalleryというアプリもiPhoneに対応していることを知りました。こちらはGemma 4を公式に最適化していて、Agent SkillsでWikipediaなど外部情報と連携できる機能もあるようなので、次回はそちらも試してみたいと思っています。

誰かの参考になれば幸いです。

参考リンク: