Amazon Bedrock で利用している推論プロファイル名を確認する方法を教えてください

困っていた内容

Amazon Bedrock に関してサポートに確認したところ「ご利用の推論プロファイル名もしくは推論プロファイル ID をご提供ください」と言われました。確認方法を教えてください。

どう対応すればいいの?

AWS マネジメントコンソール(プレイグラウンド)の場合は、設定から確認します。

AWS CLI の場合は--model-idオプションに指定した値を確認します。

なお、Bedrock モデルに関連する ID 等のサンプルは次のとおりです。

- 推論プロファイル名:

JP Anthropic Claude Sonnet 4.6 - 推論プロファイル ID:

jp.anthropic.claude-sonnet-4-6 - 推論プロファイル ARN:

arn:aws:bedrock:ap-northeast-1:123456789012:inference-profile/jp.anthropic.claude-sonnet-4-6 - モデル名:

Claude Sonnet 4.6 - モデル ID:

anthropic.claude-sonnet-4-6 - モデル ARN:

arn:aws:bedrock:ap-northeast-1::foundation-model/anthropic.claude-sonnet-4-6

AWS マネジメントコンソール(プレイグラウンド)で確認する場合

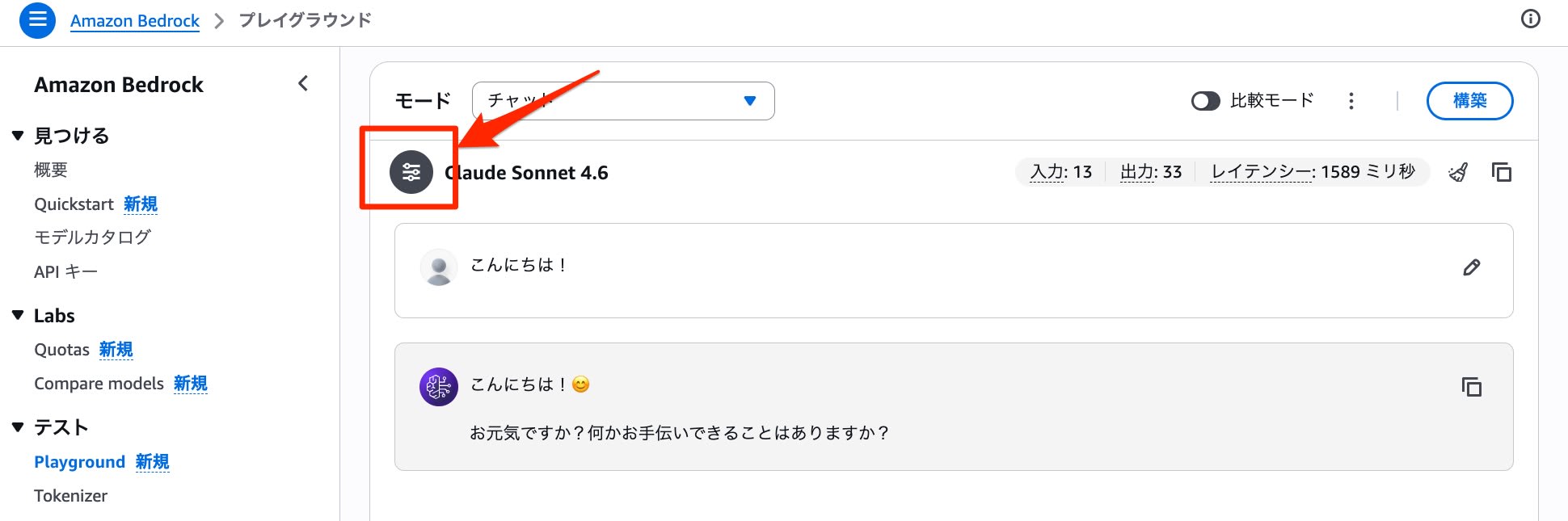

AWS マネジメントコンソール(プレイグラウンド)の設定アイコンをクリックします。

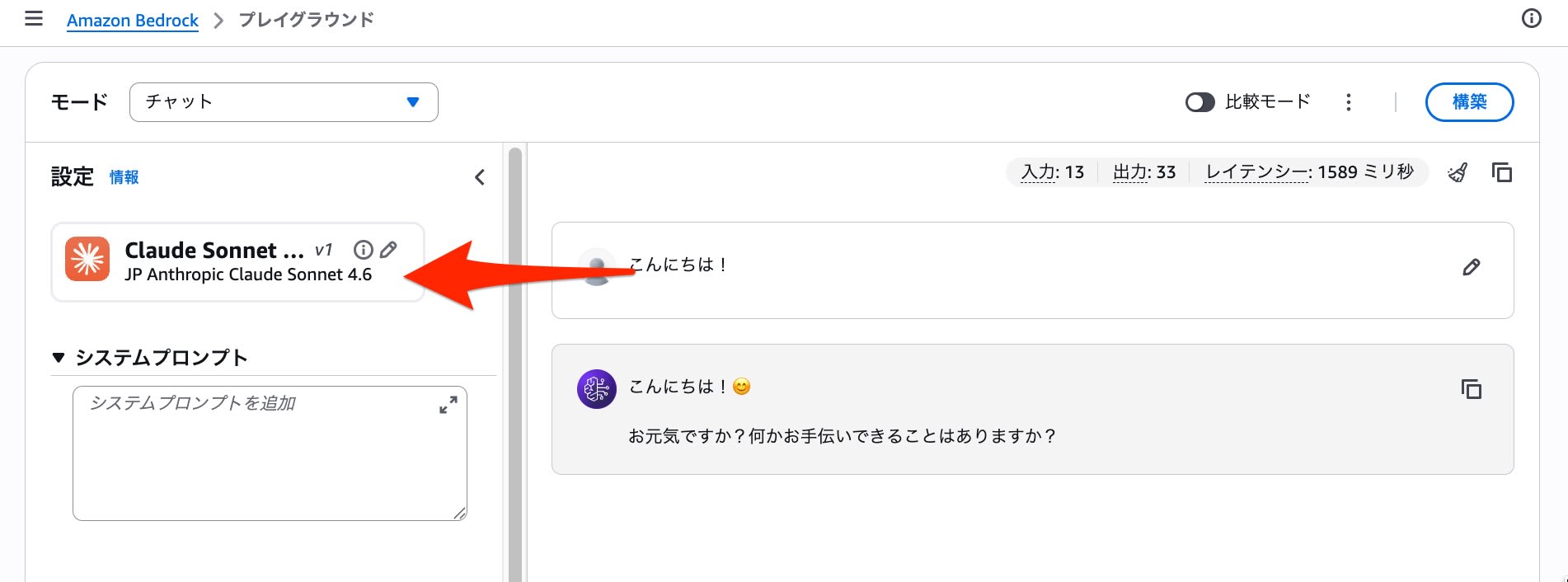

上部に推論プロファイル名が表示されます。

今回の場合は「JP Anthropic Claude Sonnet 4.6」となります。

AWS CLIで確認する場合

AWS CLI(invoke-modelやconverseコマンド)の場合は、--model-idオプションに指定した値を確認します。

例えば、次の場合の推論プロファイル ID は「jp.anthropic.claude-sonnet-4-6」です。

aws bedrock-runtime invoke-model \

--model-id jp.anthropic.claude-sonnet-4-6 \

--body '{

"anthropic_version": "bedrock-2023-05-31",

"messages": [

{

"role": "user",

"content": "こんにちは"

}

],

"max_tokens": 1024

}' \

--cli-binary-format raw-in-base64-out \

invoke-model-output-text.txt

aws bedrock-runtime converse \

--model-id jp.anthropic.claude-sonnet-4-6 \

--messages '{

"role": "user",

"content": [{

"text": "こんにちは"

}]

}'

参考資料

--model-id (string) [required]

The unique identifier of the model to invoke to run inference.

The modelId to provide depends on the type of model or throughput that you use:

- If you use a base model, specify the model ID or its ARN. For a list of model IDs for base models, see Amazon Bedrock base model IDs (on-demand throughput) in the Amazon Bedrock User Guide.

- If you use an inference profile, specify the inference profile ID or its ARN. For a list of inference profile IDs, see Supported Regions and models for cross-region inference in the Amazon Bedrock User Guide.

--model-id (string) [required]

Specifies the model or throughput with which to run inference, or the prompt resource to use in inference. The value depends on the resource that you use:

- If you use a base model, specify the model ID or its ARN. For a list of model IDs for base models, see Amazon Bedrock base model IDs (on-demand throughput) in the Amazon Bedrock User Guide.

- If you use an inference profile, specify the inference profile ID or its ARN. For a list of inference profile IDs, see Supported Regions and models for cross-region inference in the Amazon Bedrock User Guide.

フィールド ユースケース modelId 使用するプロンプト管理からモデル、推論プロファイル、またはプロンプトを指定します。