AIが"分析中心"から"実世界で実行"へ――製造業が知っておくべき「フィジカルAI」という変化

こんにちは。製造ビジネステクノロジー部のnaoです。

この記事は、クラスメソッドエンジニアが検証・執筆した技術記事をもとに、製造業のDX推進担当者向けに書き直したものです。元の技術検証記事は末尾にリンクを掲載しています。

2023年以降、急速に普及した「生成AI」。

テキストを書いたり、画像を作ったり、データを要約したりと、デジタルの世界での活躍はすでに多くの方が実感されていると思います。

今、その知能が実世界の機器制御へと適用範囲を広げています。それが「フィジカルAI」です。

フィジカルAIとは何か――生成AIとの違いから理解する

本稿では、知覚・判断・制御を通じて実世界へ直接作用するAI群を「フィジカルAI」と呼びます。

一番わかりやすいのは、生成AIとの比較です。

| 生成AI | フィジカルAI | |

|---|---|---|

| 主な出力 | テキスト・画像・要約・プログラム | ロボットなどのデバイスの動作・把持・搬送 |

| 活動する場所 | デジタル空間(PC・サーバー) | 現実空間(工場・倉庫・製造ライン) |

| 主な役割 | 情報処理・コンテンツ生成 | 物体の操作・組立・環境への適応 |

| 主なリスク | 誤情報(ハルシネーション) | 物理的な衝突・安全性 |

フィジカルAIは分析AIや生成AIを「置き換える」概念ではなく、 知覚・判断・行動までを連続的に拡張するアプローチ です。生成AIの言語理解能力を指令の解釈に活用しながら、現実世界での安全で正確な動作を実現するために高度な制御技術を組み合わせています。

フィジカルAIの5つの構成要素――人体に例えると

フィジカルAIは、5つの要素が相互依存して連動することで機能します。人体に例えると理解しやすくなります。

1.AI(頭脳)

「次はどう動くべきか」を瞬時に判断する部分です。従来のロボットは「AならB」というルールをエンジニアがプログラムしていましたが、フィジカルAIでは深層学習を活用し、AI自身が状況に応じた最適な行動を導き出します。

2.ロボティクス(身体)

AIの判断を実際の動作に変換する部分です。重いものを持ち上げたり、繊細に部品を組み立てたりする物理的なアクションを担います。

3.センサー・カメラ(五感)

周囲の環境や対象物の位置・形状・重さをリアルタイムに感知する部分です。照明の変化・振動・粉塵などノイズが多い工場環境でも正確な情報を取得できるかどうかが、フィジカルAIの実用性を左右します。

4.通信(神経)

センサーの情報をAIに届け、AIの判断をロボットに伝える部分です。ここに遅延が生じると、AIが現実の動きに「追いつけなく」なります。実際には、ネットワーク遅延だけでなく、推論処理時間や制御ループ周期を含むエンドツーエンド遅延が性能を左右します。後述する実証データが示すように、このリアルタイム性は現場での成否に直結します。

5.シミュレーション(学習・練習)

実際の現場に設備を入れる前に、仮想空間で何千回・何万回もの試行錯誤を行う場です。現実でロボットを動かして試行錯誤するのはコストも時間もリスクもかかります。仮想空間で大量に「経験」を積ませてから実機に転用する(Sim-to-Real)のが、フィジカルAI開発の標準的なアプローチです。

クラスメソッドが検証した3つの技術

上記の5要素のうち、クラスメソッドのエンジニアが実際に製造業の文脈で検証した技術を3つ紹介します。

① 物理シミュレーション:仮想空間で「練習」させる

NVIDIA Isaac Simを使うと、工場の設備やロボットを仮想空間に再現し、物理法則に従ったシミュレーションを実行できます。現場に設備を入れる前に、ロボットが特定の作業をこなせるかどうかを検証できます。

複数のロボットを並列で動かして学習させることも可能で(並列数はモデルの複雑さとGPU資源に依存します)、実機での試験前に大量の「経験」を積ませることができます。(技術検証記事:Isaac Simの基本操作)

② スマホ動画で工場の3Dモデルを作る:「練習環境」を手軽に用意する

シミュレーションで練習させるには、「現実の工場に近い仮想空間」が必要です。そのデジタルツイン(現実の双子)を手軽に作れるようになってきました。

クラスメソッドの検証では、 iPhoneで撮影した動画 から、約45分の処理で設備の3Dモデルを生成することを確認しています(処理時間はDGX Spark環境での実測値であり、使用するサーバー環境によって変わります)。生成した3Dモデルはシミュレーション環境に取り込めるため、「今日の現場を撮影して、翌日にはロボット動作の検証環境が整う」という流れが現実的になっています。

ただし、再現精度は 対象物の材質・照明環境・撮影の導線に依存 します。実運用に必要な精度の閾値は、PoC(概念実証)の段階で先に確認することが重要です。(技術検証記事:スマホ動画からDGX Sparkの3Dデジタルツインを作ってみた)

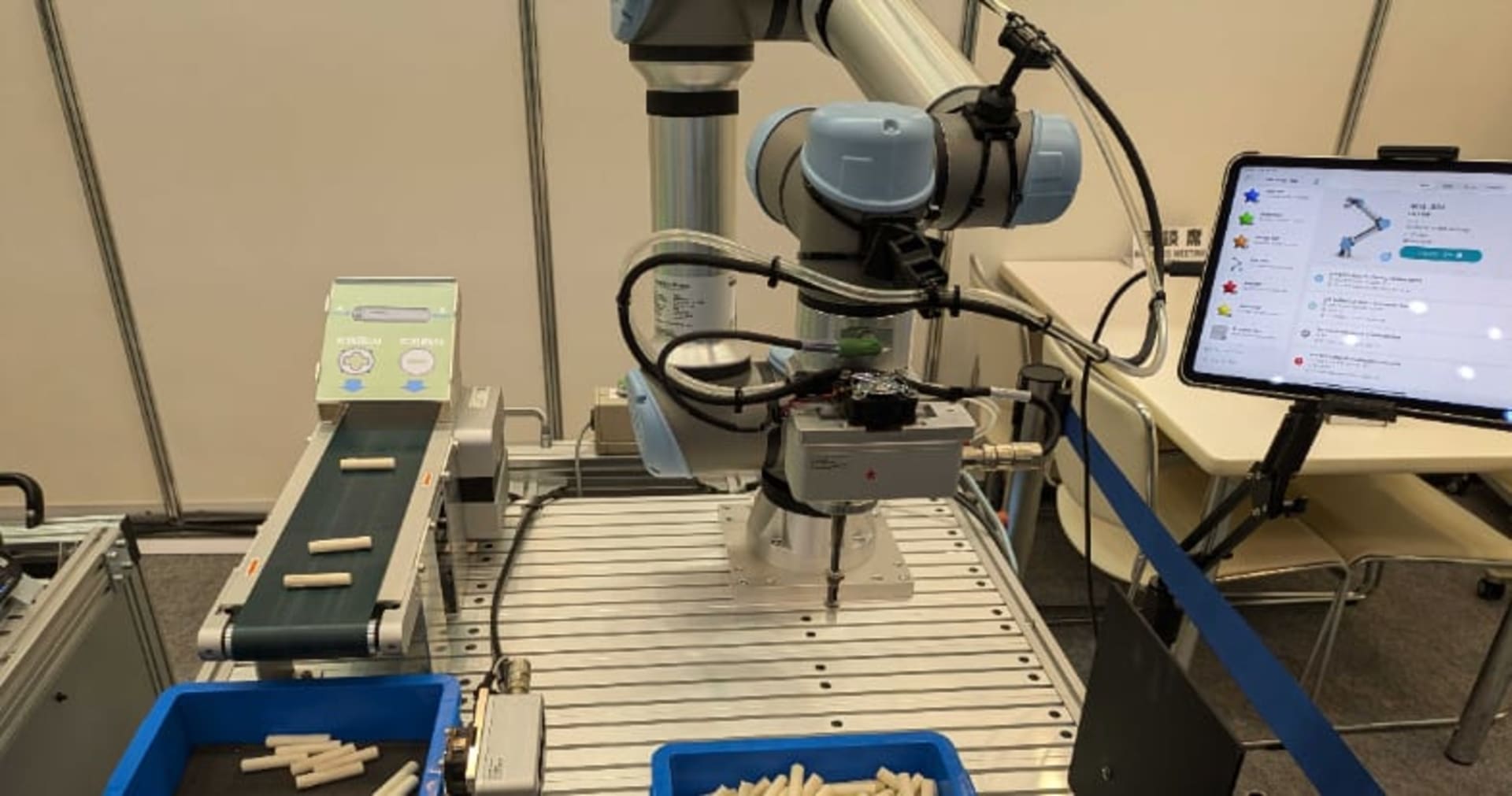

③ 模倣学習:お手本を見せるだけでロボットが覚える

ロボットに作業を覚えさせる方法として、「模倣学習」という手法があります。熟練作業者がリーダーアームを手で動かして作業のお手本を見せると、ロボット(フォロワーアーム)がその動きを記録・学習し、自律的に同じ作業を再現できるようになります。

クラスメソッドの検証では、「カラーキューブをつかんで指定の場所に置く」という特定タスクを50回分デモで教えた後、ロボットが自律動作できることを確認しています。

そしてここで「神経(通信)」の重要性が浮き彫りになりました。 同じ学習済みモデルでも、推論速度の違いが成否を分けた のです。

| 推論速度 | 成功率(本検証タスクの場合) |

|---|---|

| 15Hz(処理能力が低い環境) | 約40% |

| 30Hz(高性能GPU環境) | 本検証条件では高い成功率(ほぼ100%) |

AIの判断が物理的な動作に「追いつくスピード」が、実用上の要件になります。この結果は特定タスクでの検証値であり、他の工程に適用する際は再評価が必要ですが、 リアルタイム性がフィジカルAIの実用を左右する という原則はどの現場でも共通しています。(技術検証記事:SO-ARM101にLeRobotのACTで模倣学習させてみた)

「クラウドに出せない」問題の現実的な解き方

フィジカルAIを現場で動かすためには、ロボット制御だけでなく、現場の情報処理も工場の中で扱えるようにする必要があります。

製造業でAI導入が進まない理由の一つが、機密データをクラウドに送れないという制約です。ただし実務では「絶対に出せない」というよりも、 「匿名化が必要」「閉域ネットワーク内に限定」「国内リージョンのみ可」といった条件付きで利用できる ケースも多いのが実態です。

オンプレ(工場内サーバー)かクラウドかの二者択一ではなく、 データの機微度に応じてオンプレとクラウドを組み合わせるハイブリッド設計 が現実的な選択肢です。機密性の高いデータは工場内のローカルAIで処理し、非機微なデータはクラウドを活用するという分離が、意思決定の起点になります。

工場内に置いたサーバー上で動くローカル実行AI(主にLLM)を活用することで、日本語の作業指示書・日報・検査記録の要約や検索を、データを社外に出さずに処理できる水準に近づいてきています。

フィジカルAIが「ロボットの身体」を制御し、ローカルAIが「工場の頭脳」として情報処理を担う——この組み合わせが、製造業のAI活用の現実的な姿として見えてきています。(参考:製造業DX担当者向けのローカルAI解説記事)

今、動き始めるべき理由

技術はすでに「実証実験を始められる段階」に入っています。大規模な設備投資がなくても、小さなPoCから着手できます。

一方で、こうした技術に早く触れた現場ほど、「AIに教えるデータ」と「検証の経験」が蓄積されていきます。ロボットの模倣学習にはデモデータが必要であり、デジタルツインには現場の3D情報が必要です。どちらも「動きながら整える」性質であり、後から一気に追いつくのが難しい部分を含んでいます。

まず試せること の例として:

- 工場内の設備をスマートフォンで撮影し、3Dモデル化の精度を確認してみる

- ロボットアームの模倣学習を、1つのシンプルな作業から試してみる

- 工場内のサーバーでローカルAIを動かし、日報の要約処理を試してみる

いずれも「全ラインへの展開」を前提にする必要はありません。小さな一手が、フィジカルAI活用の土台になります。

おわりに

フィジカルAIは、製造現場が長年積み上げてきた「現場力」をデジタルで拡張する技術です。熟練作業者の動きをAIが学び、安全制約のもとで安定して再現する。工場の設備をスマートフォンで撮影し、シミュレーション上でロボットの動作を事前に検証する。そうした世界が、今まさに試せる段階に来ています。

「うちの現場には関係ない」と思っていた方にこそ、まずこの変化を知っていただきたいと思います。

技術的な詳細を知りたい方へ

この記事は、クラスメソッドエンジニアが実施した以下の技術検証をもとに作成しています。

- 👉 Isaac Simの基本的な操作方法を解説する(物理シミュレーション)

- 👉 スマホ動画からDGX Sparkの3Dデジタルツインを作ってみた(デジタルツイン生成)

- 👉 SO-ARM101にLeRobotのACTで模倣学習させてみた(模倣学習)

また、製造業のAI活用における「クラウドに出せない」問題については、下記の関連記事もあわせてご覧ください。