AISIが 「AIセーフティに関する評価観点ガイド」の1.10版を公開したので読んでみた

こんにちは!営業統括本部公共ソリューションチームの深田です。

AISI(エイシー)が3月28日に「AIセーフティに関する評価観点ガイド」の第1.1.0版を公開したので読んでみました。

※本記事の内容はAISIが公開している資料に基づいています。正しい言い回し等はそちらをご確認ください。

AISIについて

AISI(エイシー)はAIセーフティ・インスティテュートの略で、日本におけるAIの安全性の中心機関と定義と定義されており、AIの安全安心な活用が促進されるよう官民の取組を支援することが役割となります。

AIセーフティ実現に向けた業務として、安全性評価とその実施手法に関する検討や、国際連携に関する業務などを遂行します。

推進体制としては、13府省庁、5関係機関で構成される政府横断の組織となります。

こちらの資料から抜粋しています。

AIセーフティに関する評価観点ガイド

本ガイドの目的としては以下のように記載されています。

AIセーフティを実装していくにあたっては、AI システムの挙動がブラックボックスである点など、AI 固有の新たな問題や複雑さが課題となる。また、生成AIの入出力のバリエーションが多岐にわたる点も挙げられる。特定の用途に向けて設計された AIシステムが、広範な目的への応用のために使用されることもある。さらに、適切な AI システムの実装や利用がなされない場合には人間の心理面にも悪影響を及ぼす可能性がある。そのため、AIセーフティを確保し続けることは、急速な普及が進んでいる AI が社会の持続的な発展に寄与するための前提となる。

上記を踏まえ、「AIセーフティに関する評価観点ガイド」(以下、「本書」という。)は、AIシステムの開発や提供に携わる者が AI セーフティ評価を実施する際に参照できる基本的な考え方を提示する。

改定のポイント

令和7年3月28に改訂した意図として以下のように記載しています。昨今、ビッグテックにより画像などのマルチモーダル基盤モデルのサポートが始まっている。これにより、LLM を構成要素に持つ AI システムにとどまらない、多様なAIシステムを対象としたAIセーフティ評価の要請が高まっている。これに対応するため、マルチモーダル基盤モデルを評価対象とする場合のAIセーフティの評価観点に関する調査を行い、各評価観点の評価項目例を中心として本書を改訂した。

用語の整理

「AIセーフティ」という考え方に関連する用語を以下のように説明しています。

※ガイド本文においてはAIに関する他の用語についても説明があります。

AIセーフティ

人間中心の考え方をもとに、AI 活用に伴う社会的リスク※を低減させるための安全性・公平性、個人情報の不適正な利用等を防止するためのプライバシー保護、AI システムの脆弱性等や外部からの攻撃等のリスクに対応するためのセキュリティ確保、システムの検証可能性を確保し適切な情報提供を行うための透明性が保たれた状態。

(出典:総務省・経済産業省「AI 事業者ガイドライン(第 1.0 版)」)

※社会的リスクには、物理的、心理的、経済的リスクも含む(出典:Department for Science, Innovation and Technology, UK AISI “Introducing the AI Safety Institute”)

AIセーフティ評価

AIシステムが AI セーフティの観点で適切であるかどうか見定めること。※AI セーフティの観点とは、「人間中心」、「安全性」、「公平性」、「プライバシー保護」、「セキュリティ確保」及び「透明性」を重要要素とした見方である。

人間中心

AIシステム・サービスの開発・提供・利用において、全ての取り組むべき事項が導出される土台として、少なくとも憲法が保障する又は国際的に認められた人権を侵すことがないようにすること。また、AI が人々の能力を拡張し、多様な人々の多様な幸せ(well-being)の追求が可能となるように行動すること。

(出典:総務省・経済産業省「AI 事業者ガイドライン(第 1.0 版)」, P.12)

人間中心の AI 社会原則とは、AI の利用は、憲法及び国際的な規範の保障する基本的人権を侵すものであってはならないという原則のこと。

(出典:統合イノベーション戦略推進会議決定「人間中心の AI 社会原則」, P.8)

想定読者

想定読者について以下となっています。ガイド本文では書く役割で重要視する事についても記載されています。

本書は、AI システムの開発及び提供の過程に関与する事業者(AI 事業者ガイドラインに記載されている「AI 開発者」及び「AI 提供者」)を主な読者とする。これらの事業者内でも特に、開発・提供管理者(実際に AI システムの構築や提供に関する業務を管理する者)と、事業執行責任者(事業戦略と一体で AI セーフティの維持または向上の施策を推進する責任をもつ者)が主な読者である。

AIセーフティの目的及び重要要素

評価の目的

AIセーフティ評価の目的は、AIモデルやAIシステムのAIセーフティが維持または向上されていることを確認することです。

実装に不備があった場合にはAIシステムのエンドユーザーがシステムの不適切な挙動による被害等の各種のリスクの影響を受けることにつながります。

これを防止するために、AIシステムの開発や提供を行う事業者は AI セーフティの維持または向上のための対策を予防的に実施し、対策の実効性の確認のための評価を実施する必要があります。

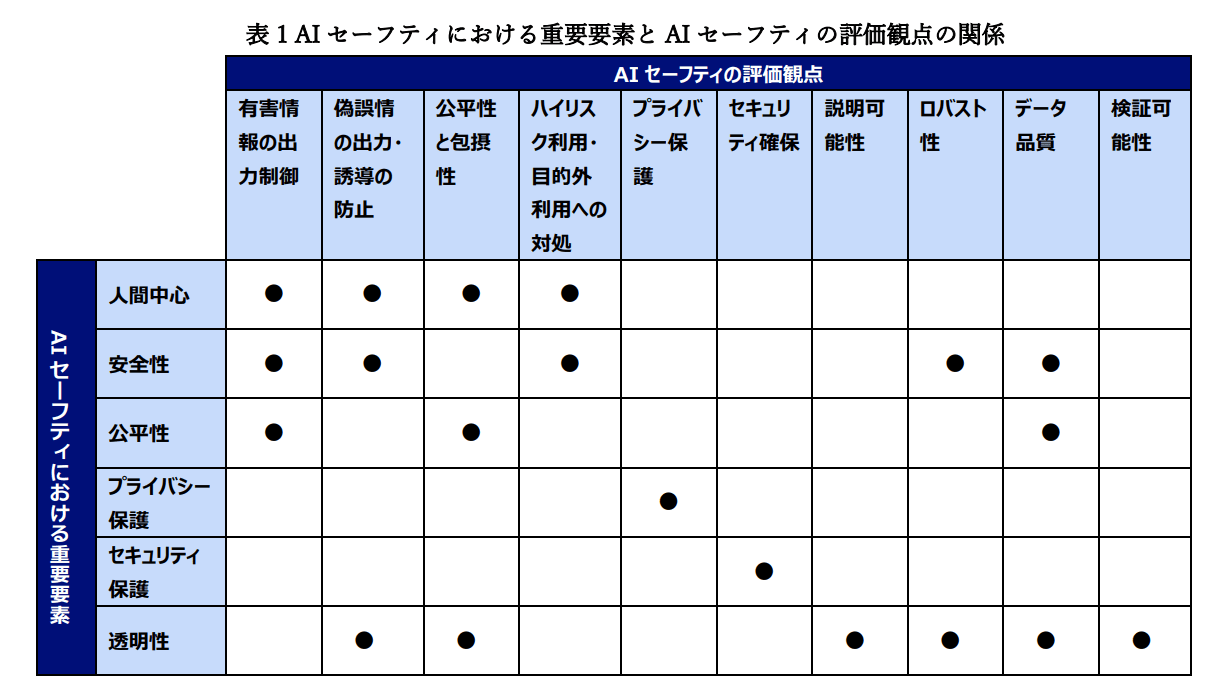

重要要素と評価観点

AI セーフティにおける重要要素は、「人間中心」「安全性」「公平性」「プライバシー保護」「セキュリティ確保」及び「透明性」です。

評価観点とは各観点についての評価を行う場合に想定される例であり、「有害情報の出力制御」「偽誤情の出力・誘導の防止」「公平性と包摂性」「ハイリスク利用・目的外利用への対処」「プライバシー保護」「セキュリティ確保」「説明可能性」「ロバスト性」「データ品質」及び「検証可能性」を挙げています。

ただし、具体的な対策を検討する際は「AI セーフティに関するレッドチーミング手法ガイド」も参照することが望ましい。と注意書きされています。

それぞれの評価観点と関係するAIセーフティにおける重要要素を以下の表に示しています。

対応関係がある箇所に●が記載されています。

資料後半では各評価項目について、重要性、AIセーフティとの関係性、想定されえるリスクの例、評価項目例について詳しく記載されています。

評価実施時期

AIセーフティ評価は繰り返し実施するものとし、開発・提供・利用の各フェーズにおいて、適切かつ合理的なタイミングで実施する。評価範囲はデータ、LLM、LLMシステム全体です。

評価実施方法

技術的評価

技術的評価では、主に AI システムで用いられるデータや入出力、システム構成、各種設定などの技術的観点についての評価を行う。

- ツールによる評価

- レッドチームによる評価

マネジメント評価

マネジメント的評価では、主に AI セーフティに関する事業者全体での取組方針や、事業者内で整備された規定等に関する評価を行う。AI セーフティが維持または向上されているかを組織内のトレーニングや演習等を通して評価します。

所感

非常に読み応えのあるドキュメントでした。AIセーフティにおける重要要素、評価観点についてさらに理解を深めたいです。

クラウドや生成AIに関する情報収集の際は、クラスメソッドの公共機関向けクラウド活用・デジタル化支援や生成AI総合支援サービス

ページもぜひご確認ください!