Datadog MCP を利用したインシデント調査の思考プロセスを可視化する skills を作ってみた

こんにちは。オペレーション部のしいなです。

はじめに

先日 Datadog MCP サーバが一般提供され、インシデント調査などに活用されている方も多いと思います。

MCP サーバを使えば AI が直接テレメトリデータを取得・分析できますが、なぜその結論に至ったのかが見えにくくなる課題があります。

調査で得た知見をチームで共有し、AI の判断を人間が検証できるようにするためには、調査の過程そのものを記録・可視化する仕組みがほしいと感じました。

そこで今回は、Claude Code の Skills を活用して「観察 → 仮説立案 → 検証」のループを回しながら調査プロセスをレポートとして残せるスキルを作ってみました。

実際にスキルを利用した調査を試してみましたのでご紹介します。

作成したスキル

概要

Datadog MCP サーバーを利用したインシデント調査支援スキルです。

「観察 → 仮説立案 → 検証」のループを繰り返しながら原因を絞り込み、調査プロセス全体をインタラクティブな HTML レポートとして可視化します。

主な機能

- インシデント調査における「観察 → 仮説立案 → 検証」による根本原因の絞り込みを支援

- Datadog MCP ツールを活用したエビデンス収集(メトリクス、ログ、APM、イベントなど)

- 仮説ステータスの管理と可視化(Validated / Inconclusive / Invalidated)

- インタラクティブな HTML 調査レポートの自動生成

SKILL.md

下記リポジトリをご参照ください。

セットアップ

前提

- Claude Code CLI 導入済み

- Datadog MCP サーバ設定済み

設定手順については下記記事もご参考ください。

https://dev.classmethod.jp/articles/datadog-mcp-server-apm-cloudformation-monitor/

スキルのインストール

- 任意のディレクトリでリポジトリをクローンします。

git clone https://github.com/shiina-yuichi/dd-mcp-investigator.git

以下のファイル構成になります。

dd-mcp-investigator/

├── .claude/

│ └── skills/

│ └── incident-investigation/

│ ├── SKILL.md # Skill definition (auto-detected by Claude Code)

│ └── templates/

│ └── investigation-report.html # HTML report template

├── CLAUDE.md # Project config

└── README.md

- ディレクトリを移動の上、Claude Code を起動します。

.claude/skills/ 配下に置いた SKILL.md は Claude Code が自動検出します。

cd dd-mcp-investigator

claude

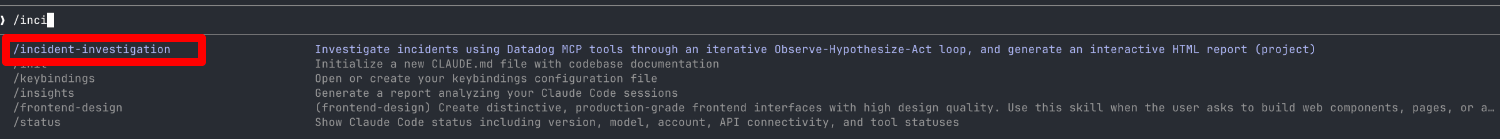

- スキルの登録を確認します。

/skillsコマンドでスキル一覧を表示し、incident-investigation が表示されることを確認します。

Skills

1 skills

Project skills (.claude/skills)

incident-investigation · ~40 description tokens

使い方

/incident-investigation コマンドでスキルを呼び出し、自然言語で調査を依頼します。

⏺ 調査対象のインシデントについて教えてください。以下のいずれかの情報を提供していただけると、調査を開始できます:

1. モニターアラート — モニター名やID

2. インシデント — インシデントID や概要

3. ユーザーレポート — 問題の症状、影響を受けているサービス名、発生時間帯など

どのような問題を調査しますか?

試してみた

Claude Code(Opus 4.6 モデル)を利用し、次のインシデント調査を試してみました。

- ユーザーレポート(APM レイテンシーの調査)

- モニターアラート

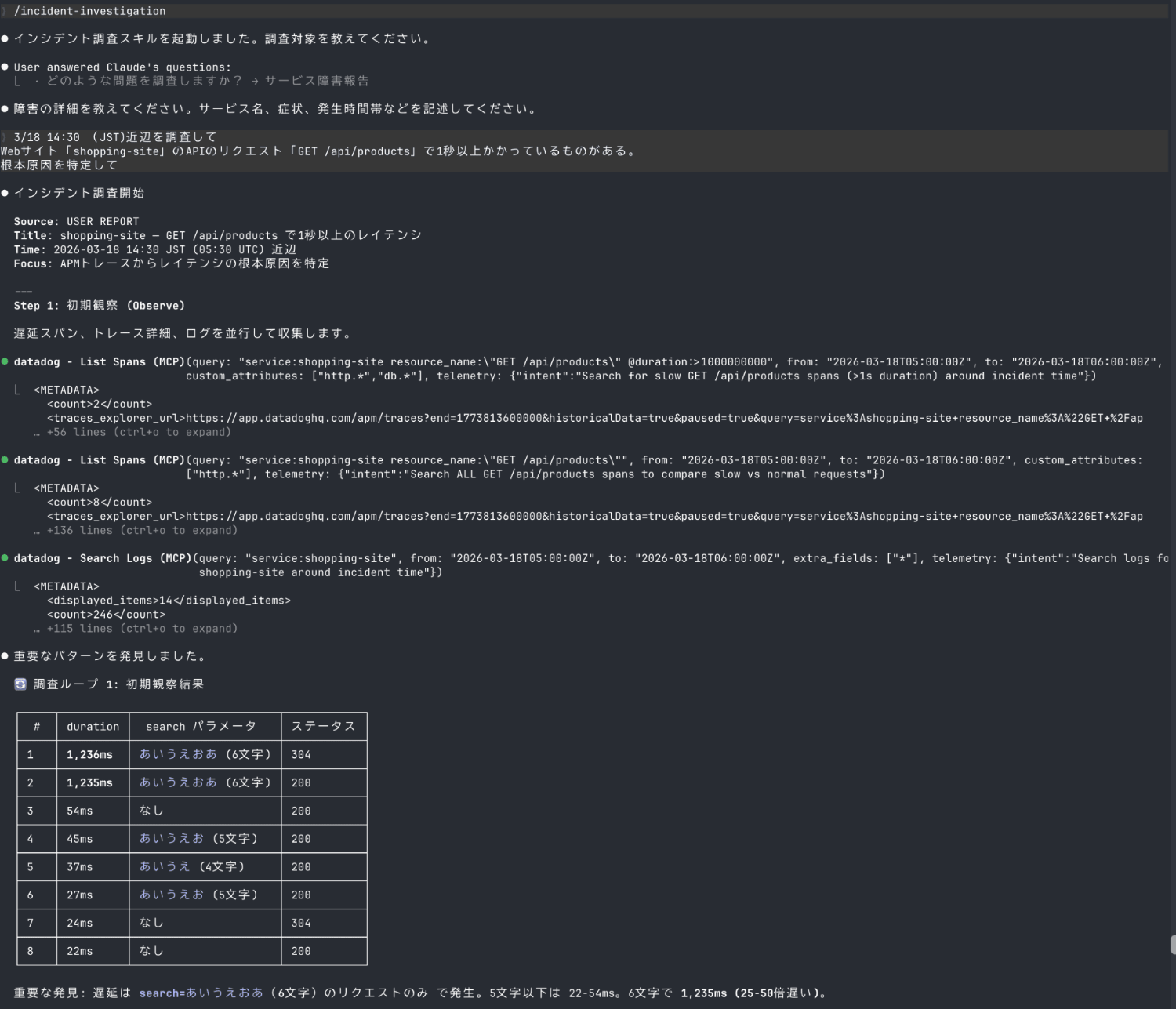

APM レイテンシーの調査

指示

3/18 14:30 (JST)近辺を調査して

Webサイト「shopping-site」のAPIのリクエスト「GET /api/products」で1秒以上かかっているものがある。

根本原因を特定して

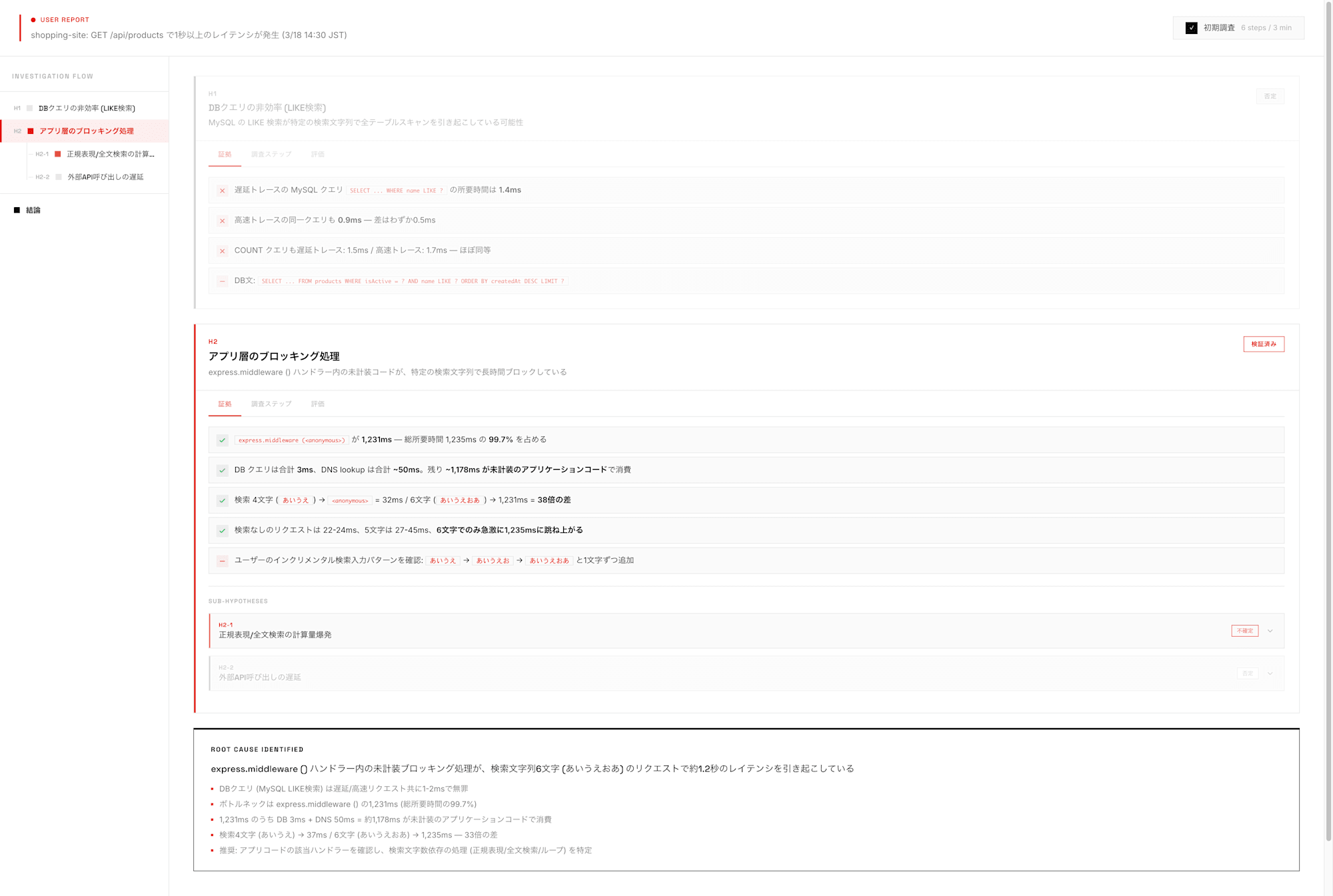

出力結果

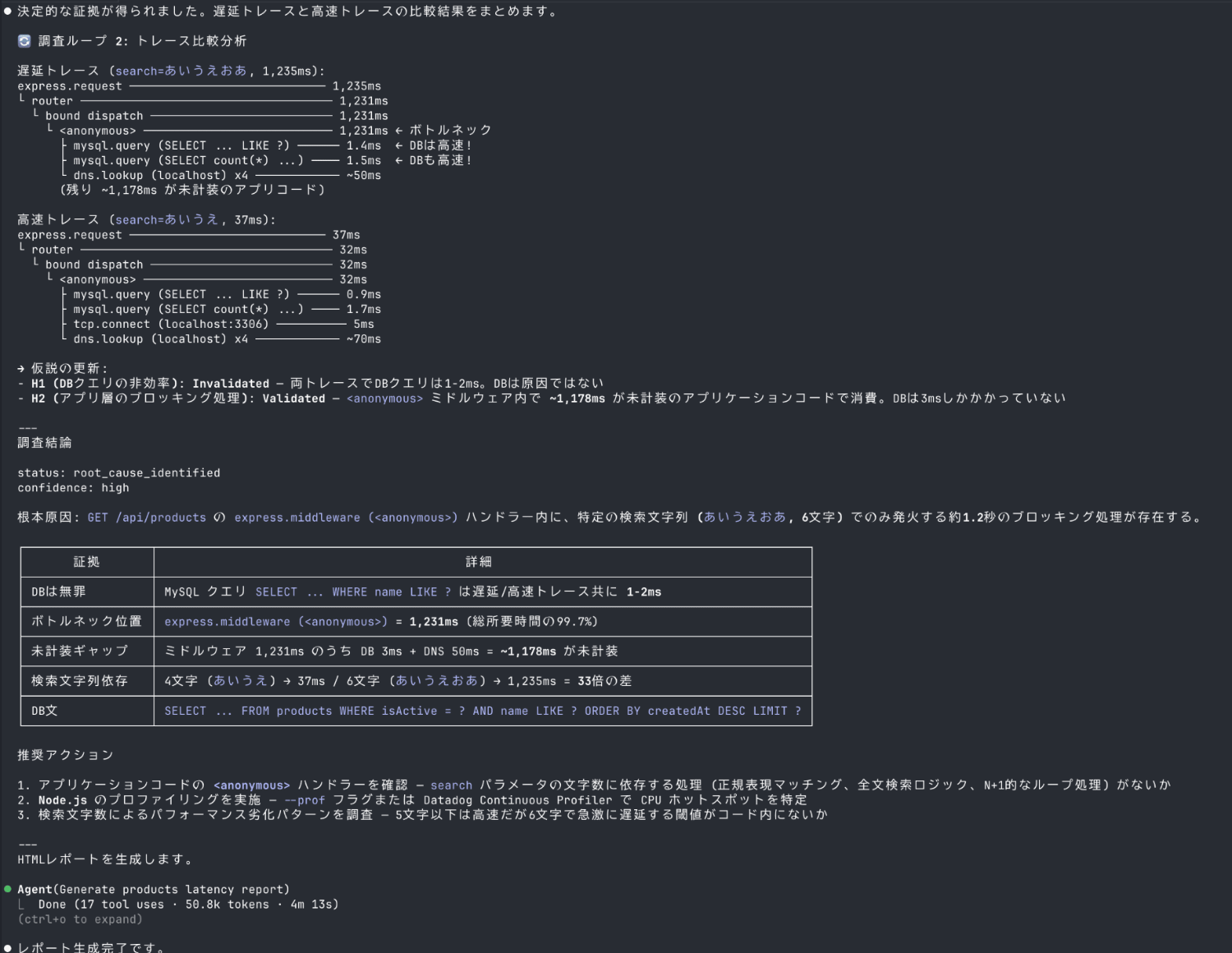

Datadog MCP サーバを利用しながら、一通りのインシデント調査が完了しました。

HTML 形式で出力されたファイルを確認してみます。

レポート

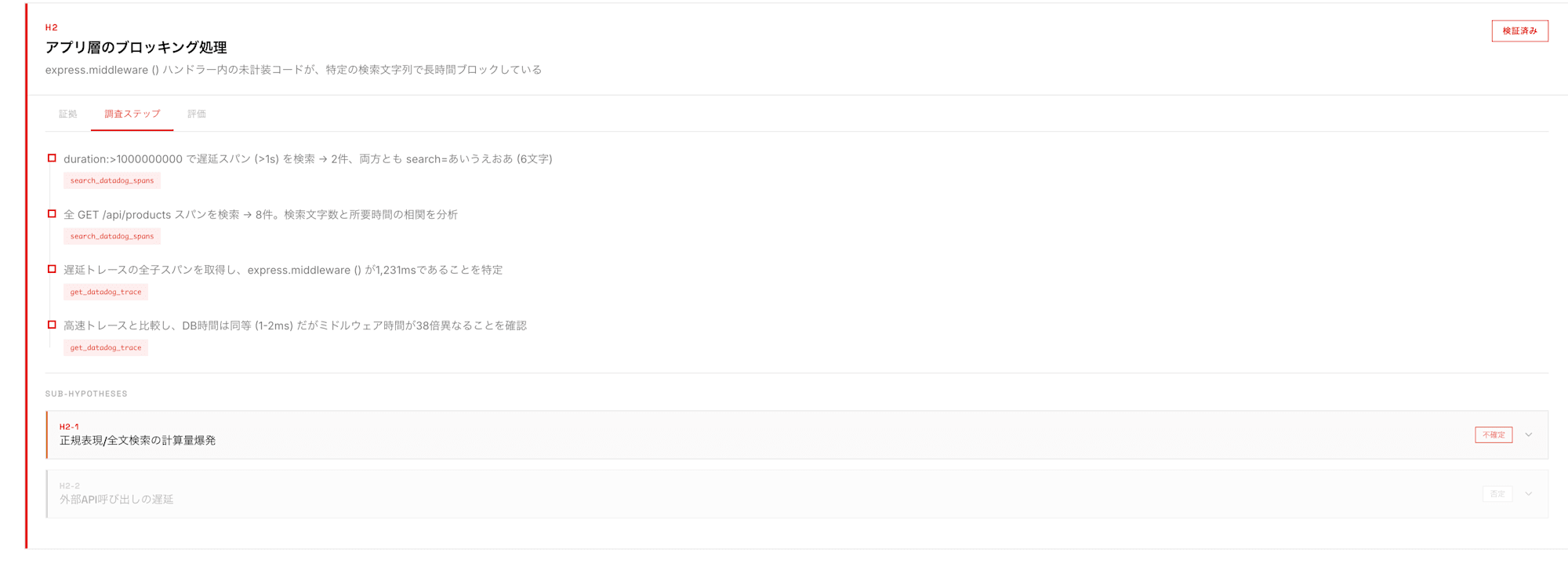

証拠

ステップ

評価

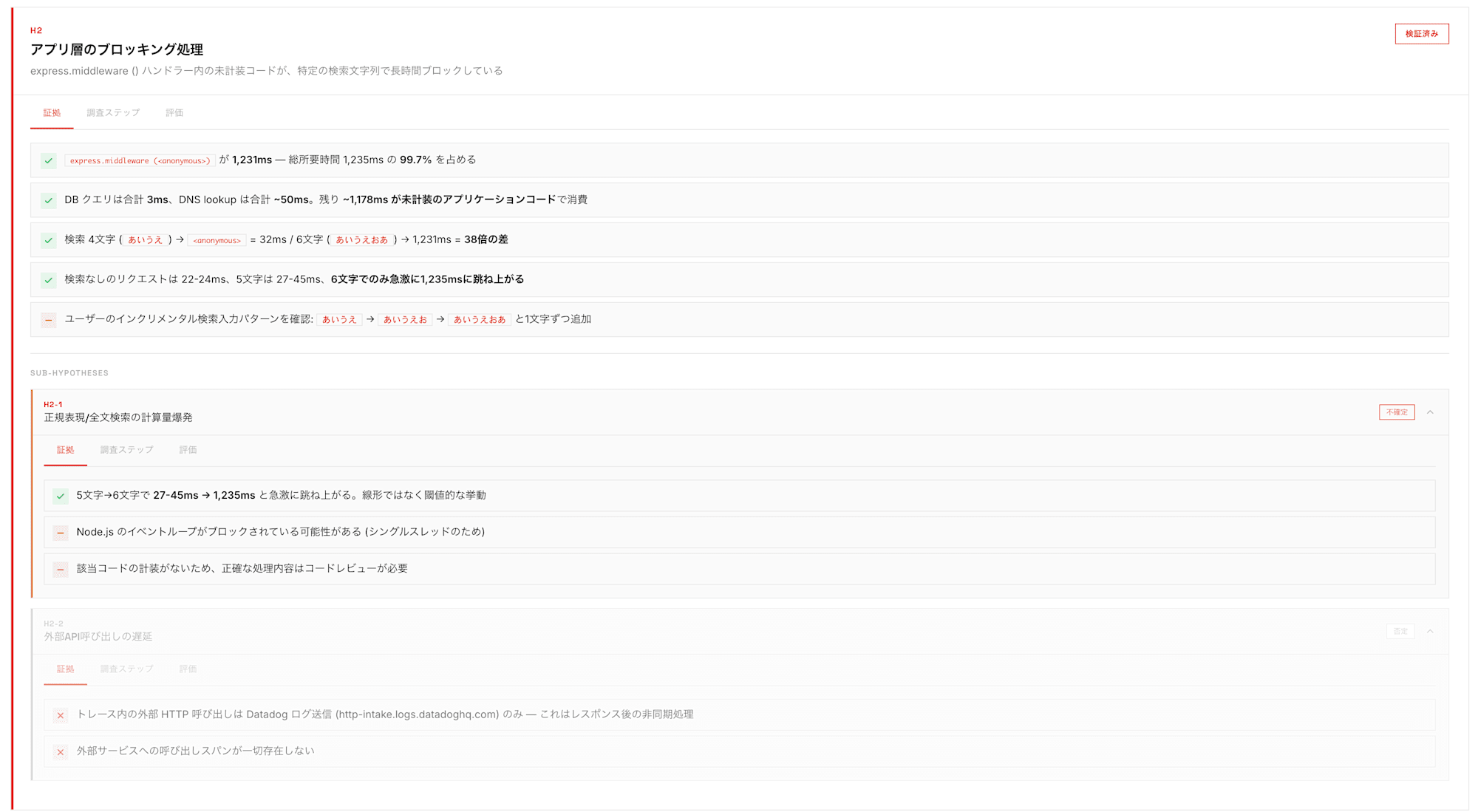

いくつかの仮説を元に、検証のループを繰り返しながら原因を絞り込んでくれています。

どのような観測データを見て、どう判断したかといった調査の過程が可視化されました。

今回の調査では正規表現/全文検索の計算量爆発といった仮説もありましたが、アプリ層のブロッキング処理のほうが十分な証拠が見つかり、結論として導かれたことがわかります。

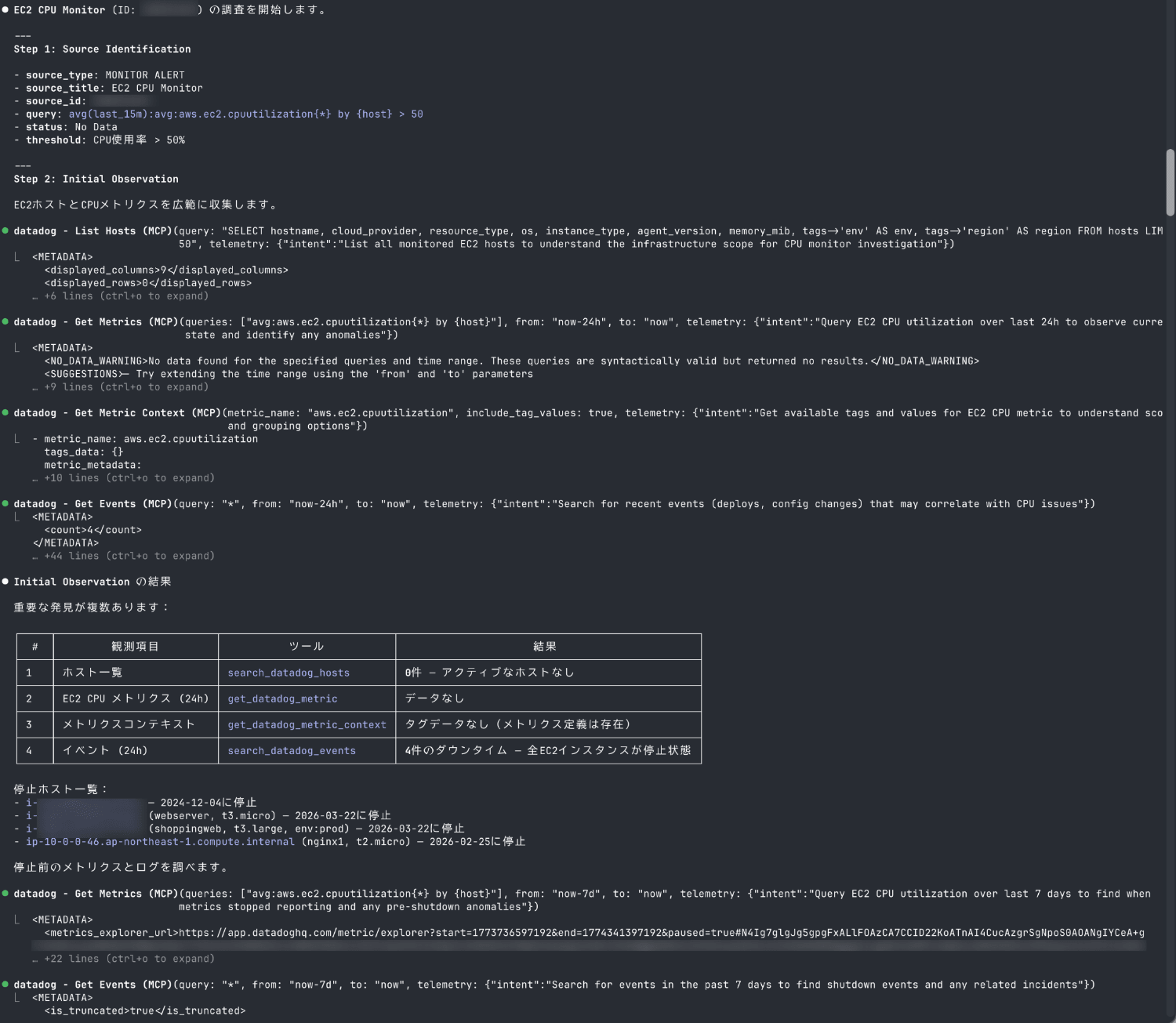

モニターアラートの調査

指示

⏺ 調査対象のインシデントやアラートを教えてください。以下のいずれかの情報があると調査を開始できます:

- モニターアラート: モニター名、ID、またはアラートの内容

- インシデント: インシデントID、タイトル、または説明

- ユーザーレポート: 問題の症状、影響を受けているサービスやホスト名

どのような問題を調査しますか?

モニターアラートの調査とし、モニターIDを指定して調査を行ってみます。

モニターID XXXXXを調査

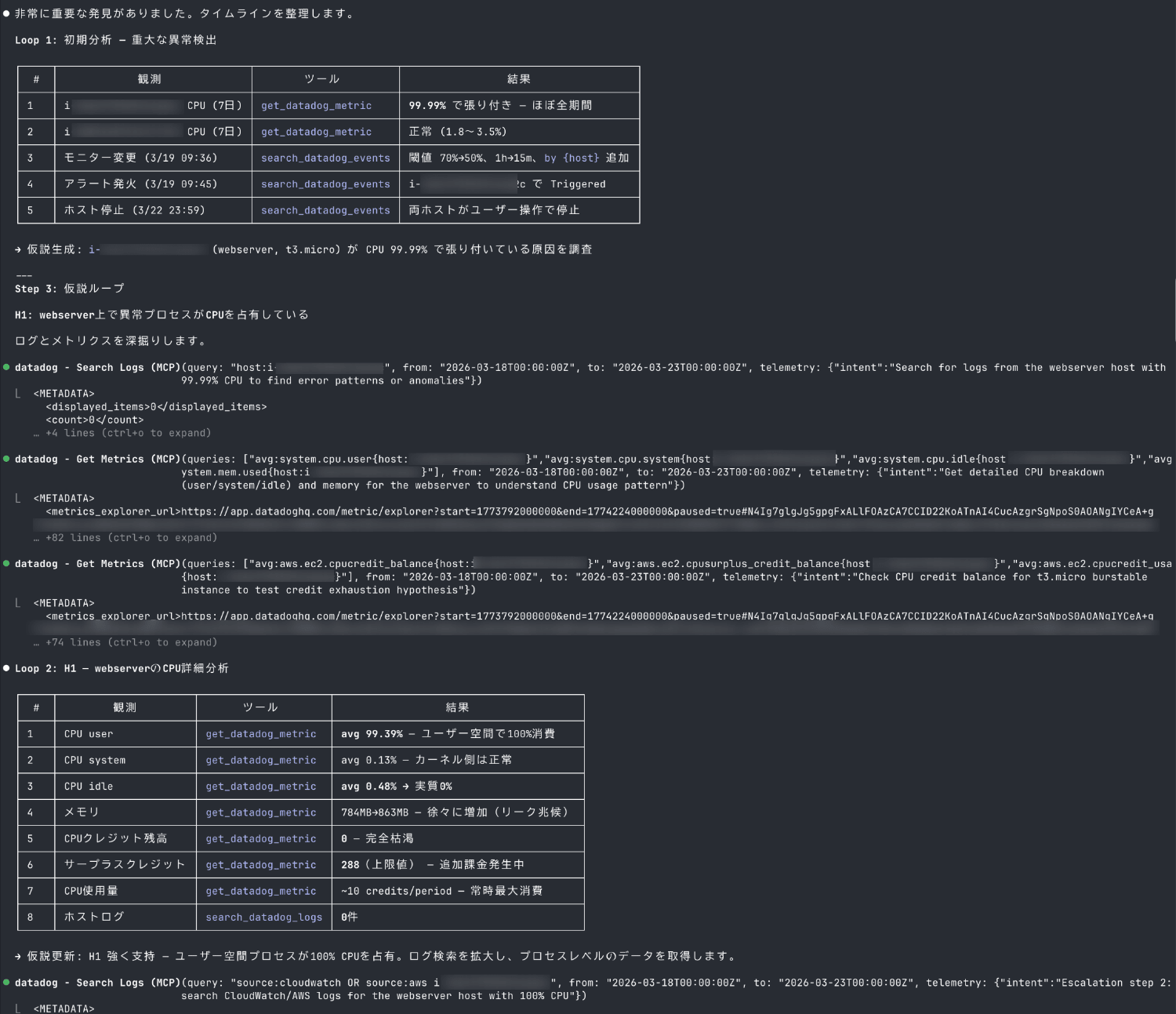

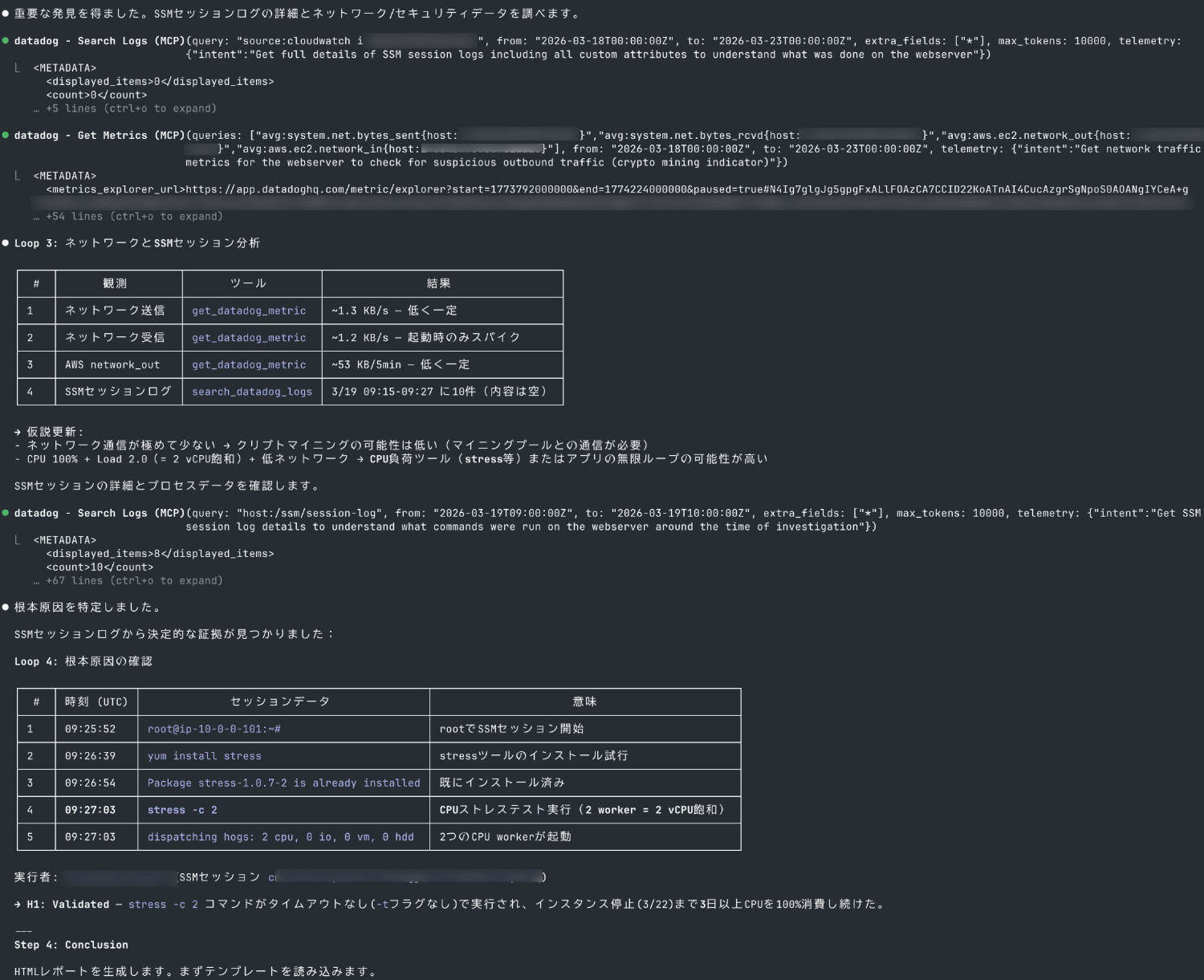

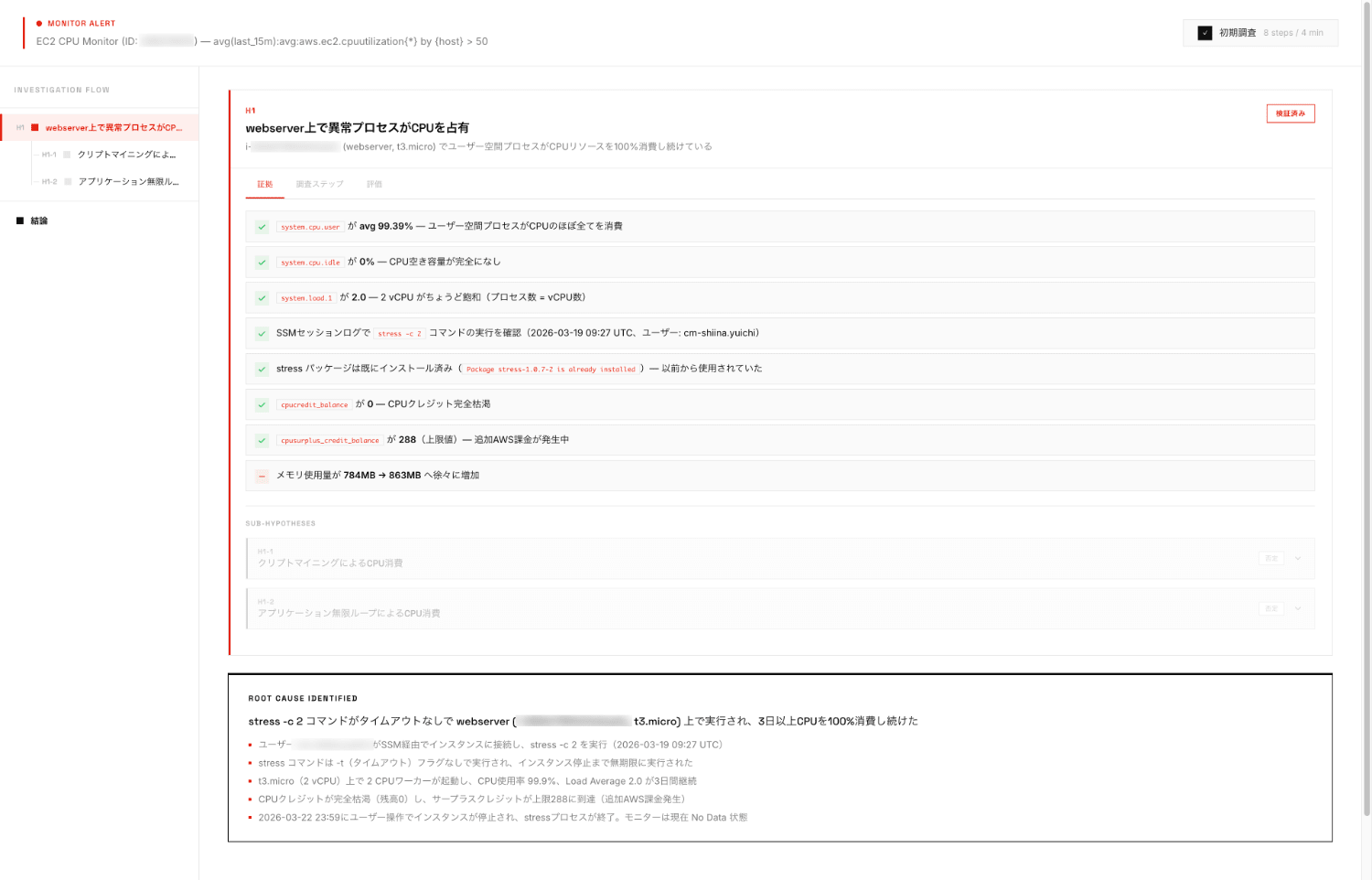

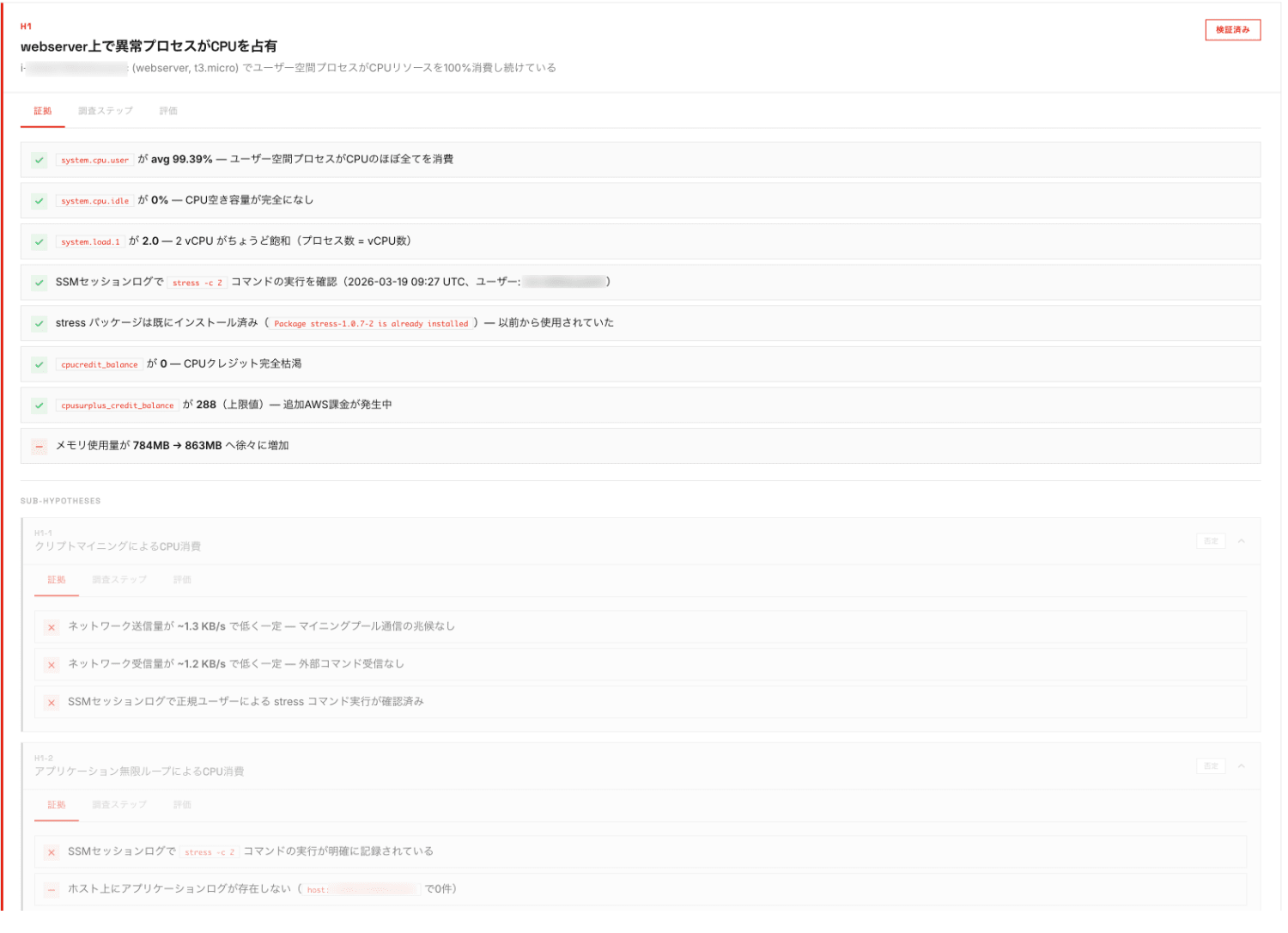

出力結果

こちらも Datadog MCP サーバを利用しながら、一通りのインシデント調査が完了しました。

HTML 形式で出力されたファイルを確認してみます。

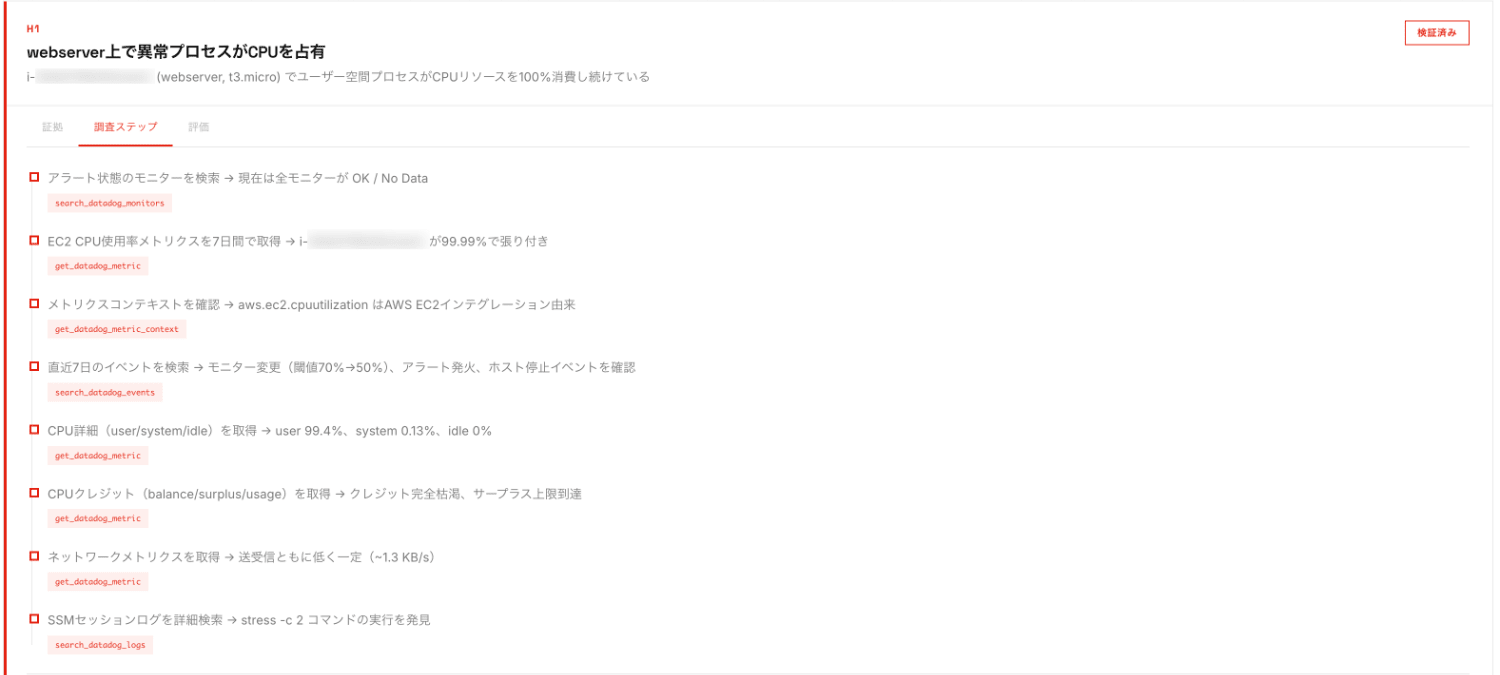

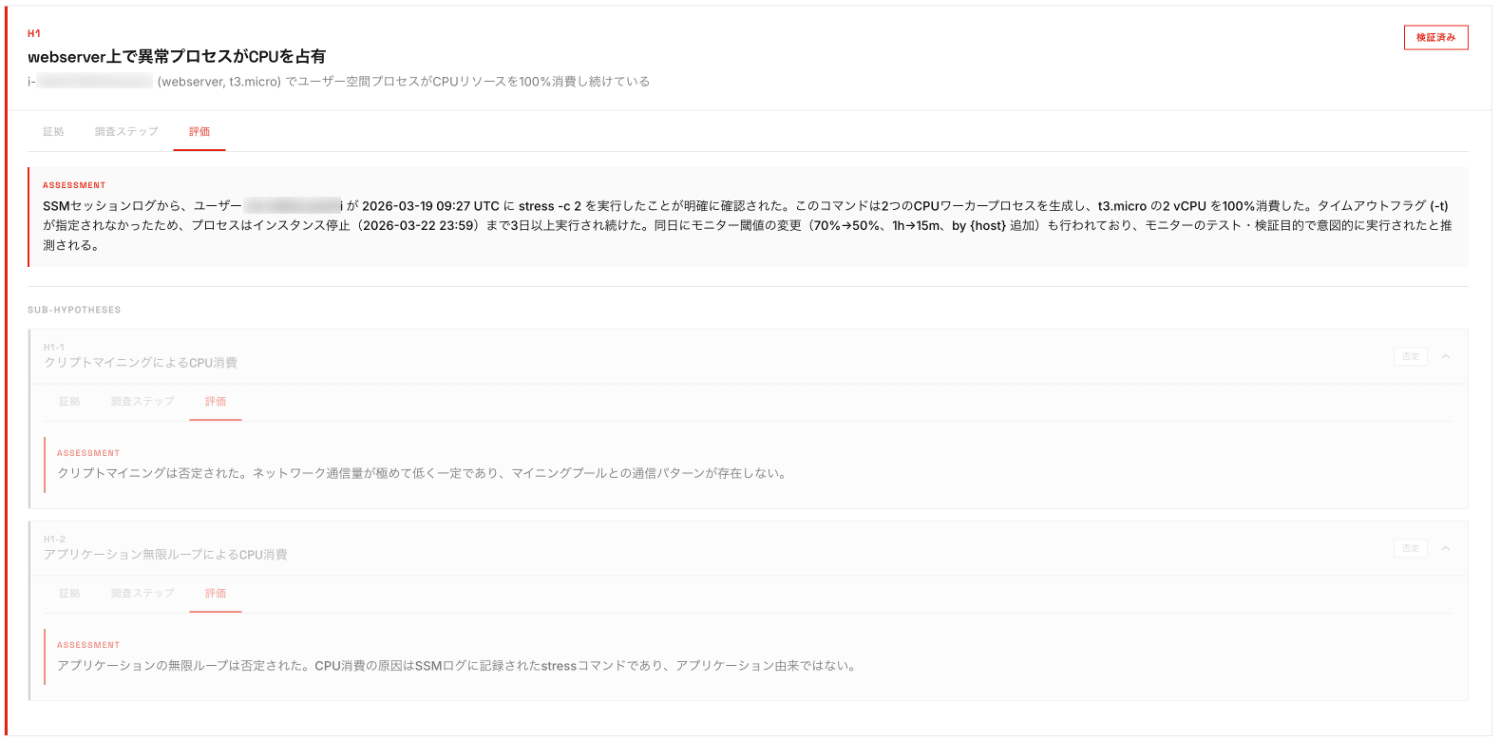

レポート

証拠

ステップ

評価

メトリクスを一通り調べたあと、ログから証拠の発見に至りました。

評価より、仮説が否定された理由もわかります。

まとめ

Claude Code の Skills と Datadog MCP サーバを組み合わせて、インシデント調査の思考プロセスを可視化するスキルを作成してみました。

「観察 → 仮説立案 → 検証」のループを回すことで、AI がどのデータを見て、どう判断したかを追跡でき、人間がその妥当性を検証できます。

また、レポートとして残すことで、チーム内での知見共有や事後の振り返りにも活用できると思います。

MCP サーバの登場により AI にインシデント調査を任せる場面が増えてきているので、今後は調査過程の可視化と記録も重要になると感じています。

本記事が参考になれば幸いです。