Amazon Connect のチャット機能で、AI エージェントの応答がメッセージストリーミングに対応しました

はじめに

Amazon Connect のチャット機能において、AI エージェントからの応答をストリーミング形式で表示できるようになりました。

これまで、Amazon Connect のチャットで、Amazon Connect AIエージェントやAmazon Lex ボット、裏側で生成AI(Amazon Bedrockなど)を動かしたりする場合、回答がすべて生成し終わるまで画面には何も表示されず、数秒待たされた後に文章が一気に表示されていました。

今回のアップデートにより、Amazon Connect AI エージェントを利用している場合に限り、応答が生成され次第、段階的にチャット画面に表示されるようになります。これにより、ユーザーが待たされる無応答の時間が減り、会話中のカスタマーエクスペリエンス(CX)が向上します。

また、この機能を有効にすることで、Amazon Lex のタイムアウト制限が従来の10秒から60秒に延長されます。これにより、複雑な社内ドキュメント検索(RAG)や長文の生成など、時間のかかるバックエンド処理をエラーを起こさずにチャットに組み込めるようになります。

さらに、このタイムアウト延長は**「Lex や Lambda のコールドスタートによるエラー」の解消**にも非常に有効です。

以前は、しばらく利用されていなかったチャットボットにユーザーが最初のメッセージを送信した際、裏側の処理(Lambdaなど)の立ち上がり(コールドスタート)に時間がかかり、Connect の10秒タイムアウト制限に引っかかってシステムエラーになってしまうという課題がありました。

今回のアップデートで待機時間が最大60秒に延びたことで、こうしたコールドスタート時のシビアなタイムアウトエラーを気にする必要がなくなり、より安定したチャットボットの運用が可能になる点も大きなメリットです。

利用するボットによる挙動の違い

ドキュメントによると、Amazon Connect に組み込むボットの種類によって、今回のアップデートで利用できる機能が異なります。

ポイントは、「タイムアウトの延長(60秒)」はどのボットでも適用されますが、「段階的なテキスト表示(ストリーミング)」などのUI面の向上は Amazon Connect AI エージェントを利用した場合のみという点です。

分かりやすく表にまとめると以下のようになります。

| 機能 | Amazon Connect AI エージェント | 通常の Amazon Lex ボット / サードパーティボット |

|---|---|---|

| タイムアウトの延長 (10秒→60秒) | 適用される | 適用される |

| 進行状況メッセージの表示 | 適用される(例:「アカウントを確認しています...」) | 適用されない |

| 段階的なテキスト表示 (ストリーミング) | 適用される(テキストがまとまりごとに段階的に表示される) | 適用されない(従来通り一括表示) |

通常の Lex ボットを利用している場合でも、タイムアウトエラー(コールドスタート問題など)を回避できるという大きなメリットは享受できますが、チャット画面でのストリーミング表示(プログレッシブテキスト)を行いたい場合は、Amazon Connect AI エージェントを利用する必要があります。

確認・設定方法について

この機能を利用するための設定手順をご紹介します。

2025年12月以降に作成された Amazon Connect インスタンスでは、この機能はデフォルトで有効になっています。それ以前に作成された既存のインスタンスを使用している場合は、以下の手順で手動で有効化する必要があります。

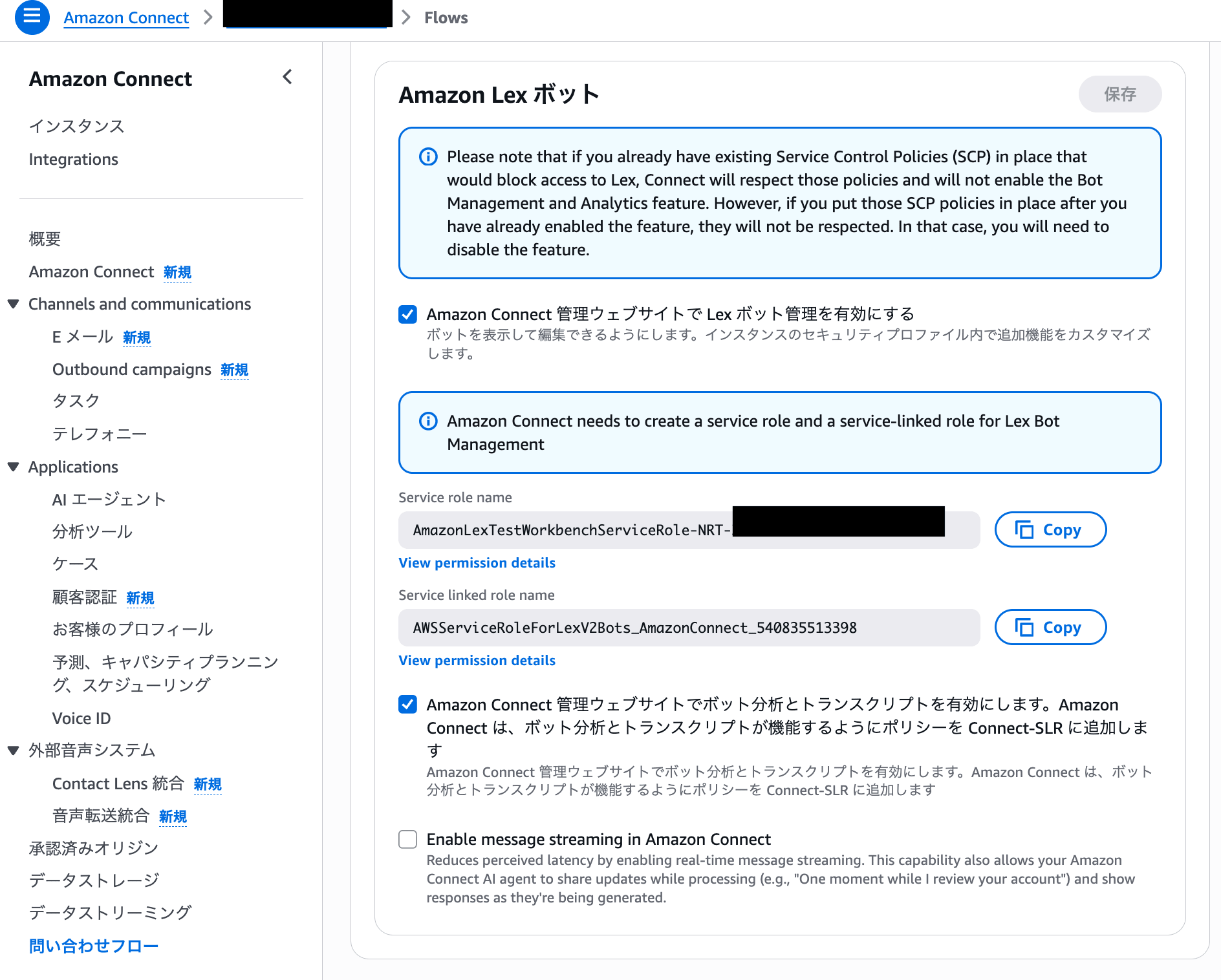

1. メッセージストリーミングの有効化

設定は AWS マネジメントコンソールから行うことを推奨します。コンソールから有効化することで、必要な権限が自動的に追加されるためです。

- AWSマネジメントコンソールから Amazon Connect を開き、対象のインスタンス名をクリックします。

- 左側のナビゲーションペインから [フロー] > [Amazon Lex ボット] を選択します。

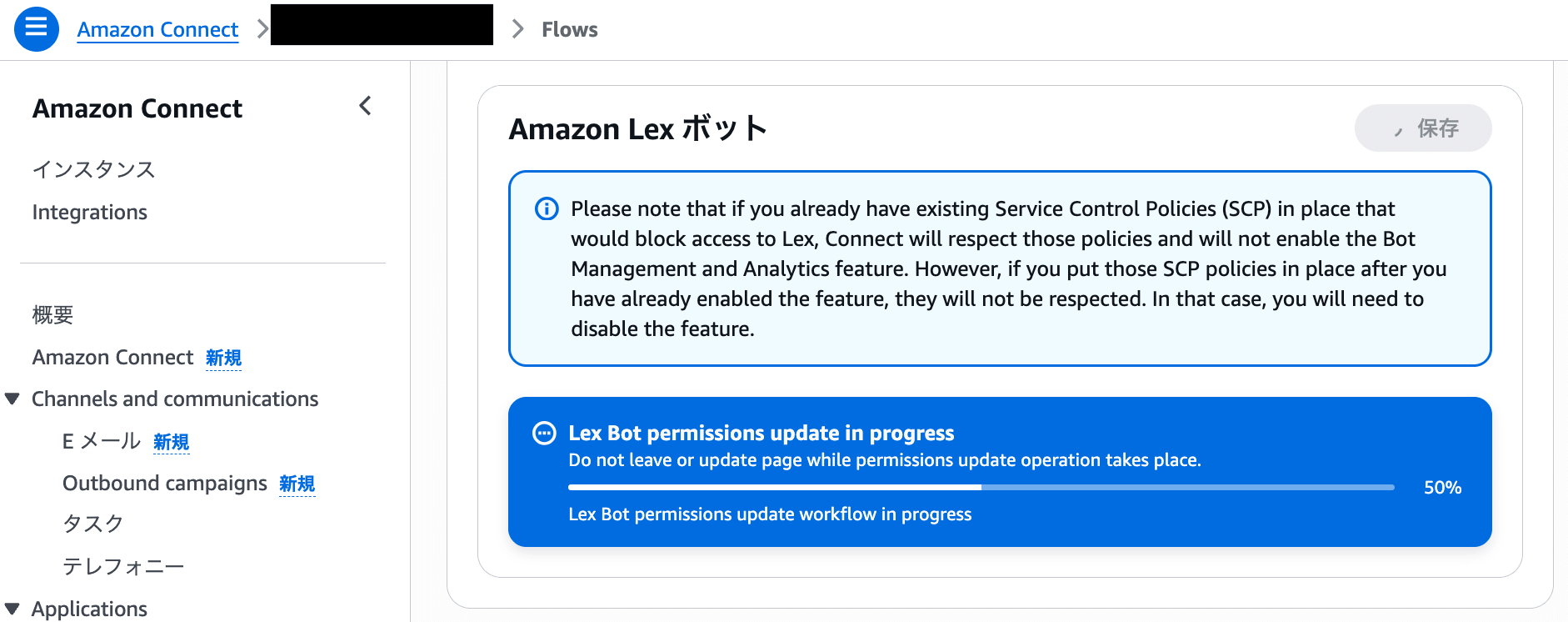

- [Enable message streaming in Amazon Connect(Amazon Connectでメッセージストリーミングを有効にする)] にチェックを入れて保存します。

- 1分弱で有効化されました。

※ コンソールから有効化した場合、Lexボットのリソースベースポリシーに以下のような権限が自動的に追加されます。Action の中に、ストリーミングに必須となる lex:RecognizeMessageAsync が含まれていることがわかります。AWS CLI等で有効化した場合は、手動でこのポリシーを追加・更新する必要があります。

{

"Version": "2012-10-17",

"Statement": [

{

"Sid": "connect-ap-northeast-1-3ff2093d-af96-43fd-b038-3c07cdd7609c",

"Effect": "Allow",

"Principal": {

"Service": "connect.amazonaws.com"

},

"Action": [

"lex:RecognizeMessageAsync",

"lex:RecognizeText",

"lex:StartConversation"

],

"Resource": "arn:aws:lex:ap-northeast-1:アカウントID:bot-alias/A3QN58KMQ7/GUX3E6DG1D",

"Condition": {

"StringEquals": {

"AWS:SourceAccount": "アカウントID"

},

"ArnEquals": {

"AWS:SourceArn": "arn:aws:connect:ap-northeast-1:アカウントID:instance/3ff2093d-af96-43fd-b038-3c07cdd7609c"

}

}

}

]

}

2. フローでの設定

機能が有効になったら、Amazon Connect のフローでAIエージェントを呼び出す設定を行います。

フロー内で 「顧客の入力を取得 (Get customer input)」 ブロックを使用し、呼び出したい Amazon Lex ボットを指定します。

フロー設計時の重要な注意点

ストリーミングを有効にした場合、現在の仕様では「同じ『顧客の入力を取得』ブロック」に処理を戻す(ループさせる)ことができません。

会話の中で再度 Lex を呼び出したい場合は、別のブロックを配置し、異なる Lex ボットエイリアスを指定するなどのフロー設計上の工夫が必要になります。

実際の動作確認

設定が完了したら、Amazon Connect のテストチャット画面から実際にメッセージを送信してみましょう。

以下のように、AIからの返答が生成されるにつれて、テキストがまとまりごとに段階的に表示されるストリーミング体験を確認できます。

ChatGPTなどのように1文字ずつ出力されるわけではなく、生成された文章のブロックごとに追記されていくのが特徴です。

また、実際の挙動を見ると、「こんにちは」といった即座に返せる挨拶などは通常通り一括で表示されます。質問に対する回答など、裏側で生成に時間がかかる処理に対してのみ、この段階的な表示(ストリーミング)が機能していることがわかります。

何も表示されないまま数秒待たされるよりも、はるかに自然で、待たされている感覚が少ないことがわかります。

まとめ

生成AIをコンタクトセンターのチャットボットに組み込むケースが増えていますが、「回答生成までの待ち時間(タイムアウト)」と「ユーザーの体感的な待ち時間」は大きな課題でした。

今回のアップデートにより、裏側で時間のかかる高度な生成AI処理(最大60秒)を行えるようになり、かつユーザーには待たせていると感じさせないスムーズなチャット体験を提供できるようになりました。

Amazon Connect AI エージェントを活用したチャットボットを構築している、あるいはこれから検討している方は、ユーザー体験を向上させるこのストリーミング機能をぜひ試してみてください。