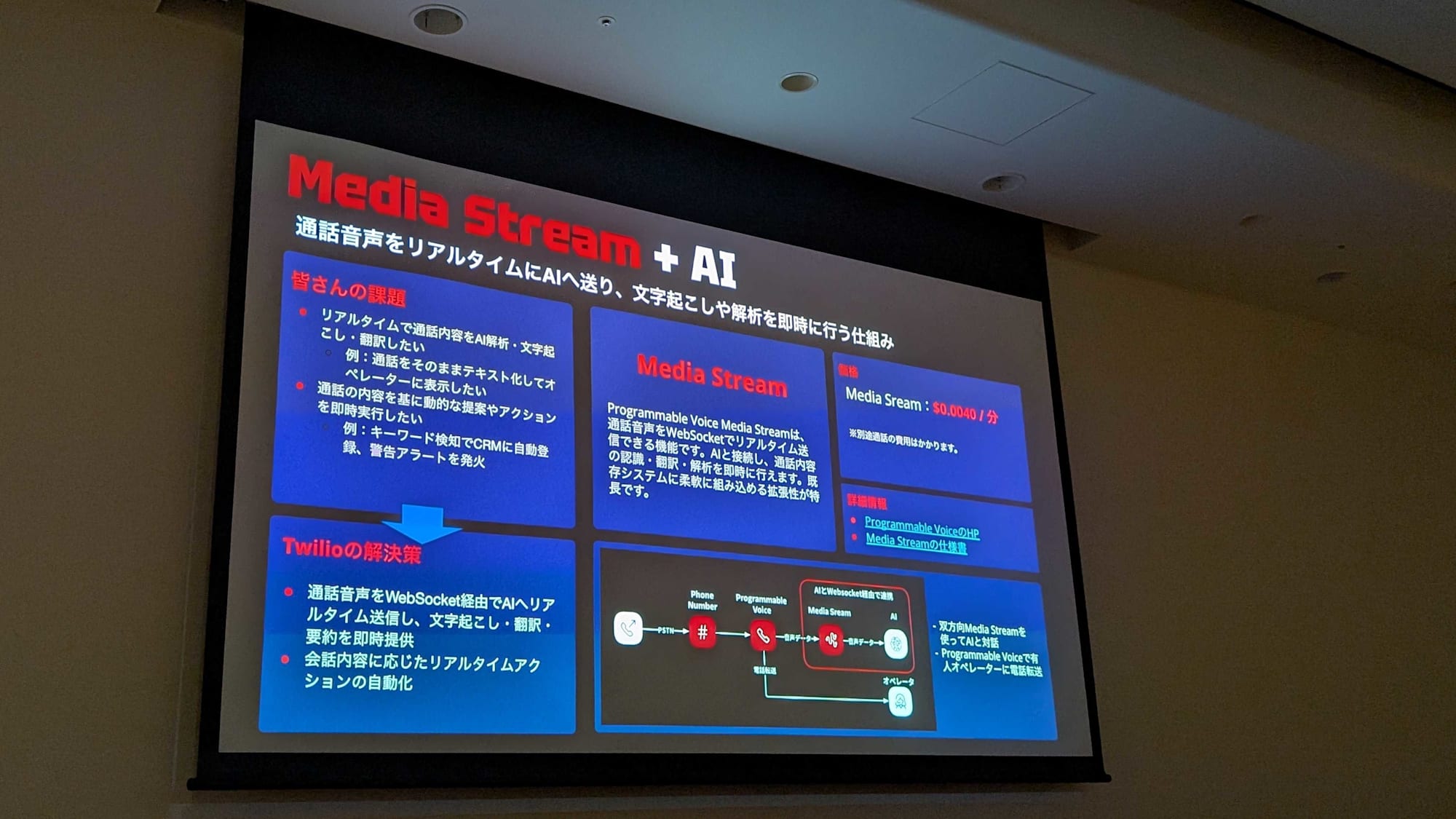

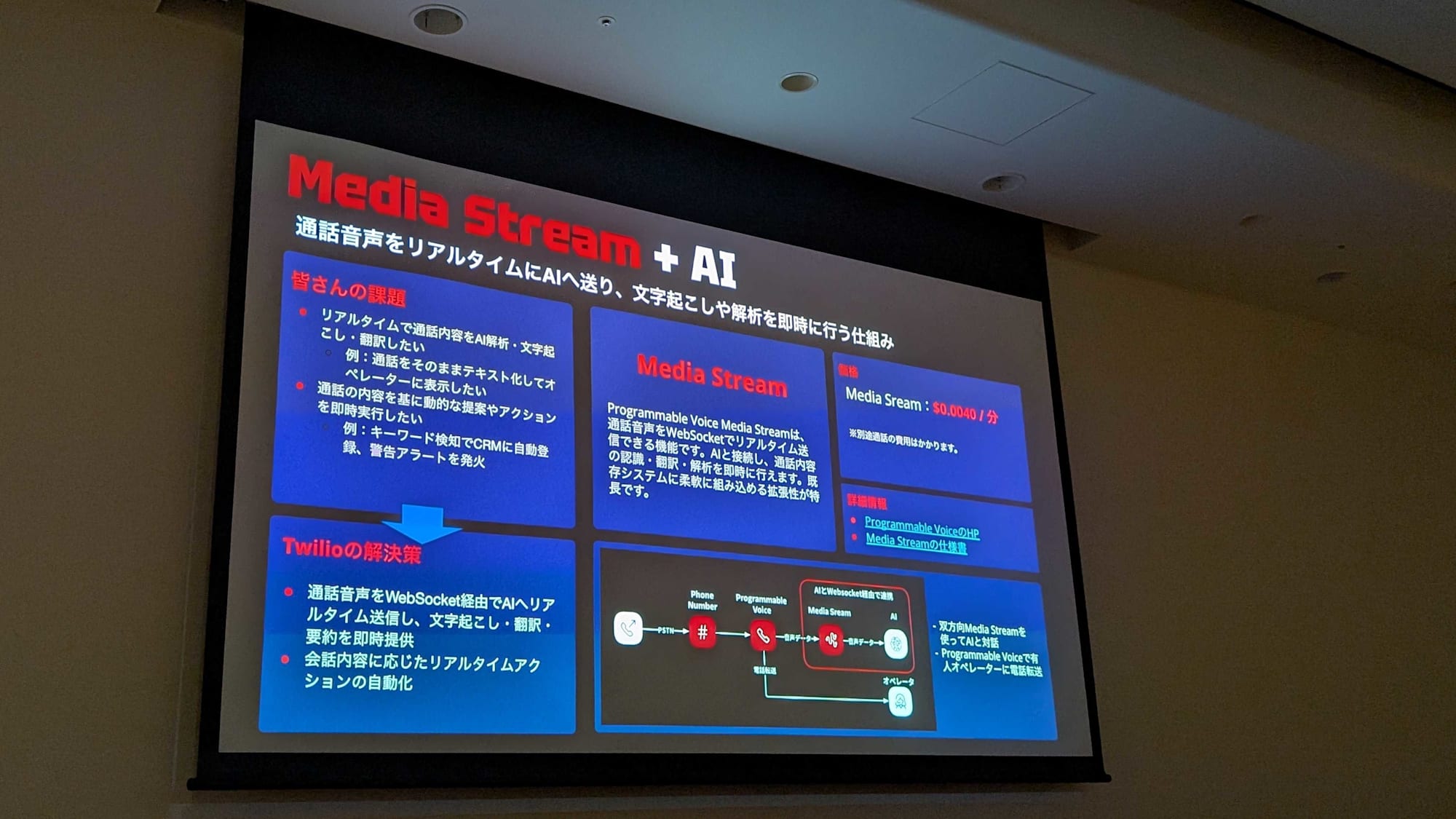

Twilio Media Streams による音声 AI 連携の構成例 - Twilio CX Innovation Night Part 2 レポート

はじめに

Twilio ConversaionRelay は、音声認識 (STT) とテキスト音声合成 (TTS) を組み合わせた仕組みで、テキストベース で AI との対話が可能です。一方、AI に直接音声データを入力し、文字起こしによって欠落する情報も含めたうえで AI と対話が行いたいというユースケースも存在します。

Twilio Media Streams は、この課題を解決するソリューションです。WebSocket を通じて生音声ストリームへのリアルタイムアクセスを提供し、AI との直接的な音声連携を可能にします。本記事では、Media Streams の技術的特徴と AI 連携の実装アプローチについて解説します。

対象読者

- AI との音声連携システムの構築を検討している開発者

- リアルタイム音声処理や WebSocket 通信の実装に関心のあるエンジニア

- コンタクトセンターや IVR システムの技術的改善を担当している方

参考

Media Streams の特徴

Media Streams は Programmable Voice 通話の生音声を WebSocket 経由でリアルタイム配信します。

ConversaionRelay の STT → AI → TTS パイプラインと比較し、以下の特徴があります。

- 低遅延処理: STT + TTS 処理を経由しないため高速

- 音声情報の保持: 文字起こしによって欠落する話者感情・トーン・話速などの非言語情報を維持

- 双方向通信: 返却された音声応答を直接通話に注入可能

実装例

イベント『Twilio CX Innovation Night Part 2』のなかで、 Media Streams を活用した構成例が図に示されました。こちらの図を基に、Media Streams と AI を連携させる実装パターンを解説します。

基本的な実装フロー

- 通話開始: 発信者が Twilio の電話番号に発信

- Media Stream 開始: Programmable Voice が WebSocket 接続を確立し、AI システムに音声ストリームを送信

- リアルタイム処理: AI が受信した音声データを即座に解析・処理

- 応答生成: AI が音声応答を生成し、WebSocket 経由で Twilio に返送

- 音声再生: 生成された音声が発信者に直接再生

TwiML による設定

<Response>

<Connect>

<Stream url="wss://your-ai-server.com/media-stream" />

</Connect>

</Response>

ユースケース例

図中の「皆さんの課題」には、たとえば以下のようなユースケースが想定されます。

- リアルタイム通話内容分析: 通話中の感情状態をリアルタイム監視し、顧客満足度を即座に判定

- 音声による本人確認: 声紋認証によるパスワードレス認証の実現

- 多言語対応の自動化: リアルタイム音声翻訳による言語判定と適切なオペレーター振り分け

まとめ

Twilio Media Streams は、ConversationRelay と異なり、直接的な音声 AI 連携を可能にします。WebSocket による低遅延処理・音声情報の完全保持・双方向通信が実現できます。特に感情分析、声紋認証、リアルタイム翻訳といった高度な音声処理において真価を発揮します。ConversationRelay との適切な使い分けにより、音声 AI システムの可能性が大幅に拡張されるでしょう。