Vercel AI GatewayがGAされました

こんにちは、豊島です。

VercelのAI Gatewayが一般提供(GA)されました。

AI Gatewayとは

AI Gatewayは、単一のエンドポイントから100以上のモデルにアクセスできる統合APIを提供するサービスです。

AI Gatewayは以下のようなユースケースに最適です。

- 複数のモデルを試しながら最適解を探したいとき

- 例えば「この文章生成はGPT系がいいけど、要約にはClaude系を使いたい」といったように、用途ごとにモデルを切り替えたい場合でも、AI Gatewayなら同じエンドポイントから簡単に切り替えることができます

- 高いリクエスト処理能力が必要なとき

- 1つのベンダーだけではレート制限(1秒あたりのリクエスト数)に限界があります。AI Gatewayを使えば複数ベンダーにまたがって処理できるため、大規模なトラフィックにも対応しやすくなります。

- 最新モデルをすぐ試したいとき

- 新しいモデルが公開されたときでも、接続設定を細かくいじらずにすぐ試せます。新しい技術をキャッチアップしやすい環境を整えることができます。

- 障害に強い仕組みが欲しいとき

- 特定のモデルやベンダーが一時的に落ちても、AI Gatewayが自動で別のモデルに切り替えることができます。

- コストや利用状況をまとめて把握したいとき

- 本来ならベンダーごとに別々のダッシュボードを見て管理する必要がありますが、AI Gatewayなら「どのモデルをどのくらい使ったか」「いくらかかったか」を一元的に確認できます。

参考 リリースブログ

https://vercel.com/blog/ai-gateway-is-now-generally-available

AI Gatewayのサンプルコード

AI Gatewayのデモコードも参考になりますが、GA版ではAI SDKが自動的にAI Gatewayを認識するため、ほとんど設定不要で利用できます。

プロキシサーバーを経由したい場合は、baseURLを明示的に設定することも可能です。

import { ModelMessage, streamText } from 'ai'

import dotenv from 'dotenv'

import * as readline from 'node:readline/promises'

/*

Vercelの管理画面から発行できるAI GatewayのAPI Keyを設定しておく

AI_GATEWAY_API_KEY=...

*/

dotenv.config({ path: '.env.local' })

// インタラクティブなチャットアプリ

async function runChatApp() {

const terminal = readline.createInterface({

input: process.stdin,

output: process.stdout,

});

const messages: ModelMessage[] = []

while (true) {

const userInput = await terminal.question('You: ')

messages.push({ role: 'user', content: userInput })

const result = streamText({

model: 'openai/gpt-4o', // モデルIDを変えるだけで他プロバイダー利用可能

messages,

})

let fullResponse = ''

process.stdout.write('\nAssistant: ')

for await (const delta of result.textStream) {

fullResponse += delta;

process.stdout.write(delta);

}

process.stdout.write('\n\n')

messages.push({ role: 'assistant', content: fullResponse })

}

}

runChatApp().catch(console.error)

従来はプロバイダーごとに異なるAPI仕様に対応するため、複数のAPIキーを管理し、実装を分ける必要がありました。

AI GatewayではAPIキーは1つだけで済み、モデルIDを指定するだけで利用できます。

さらにVercelにデプロイされている場合はAPIキー認証だけでなく、OIDC認証もサポートしています。

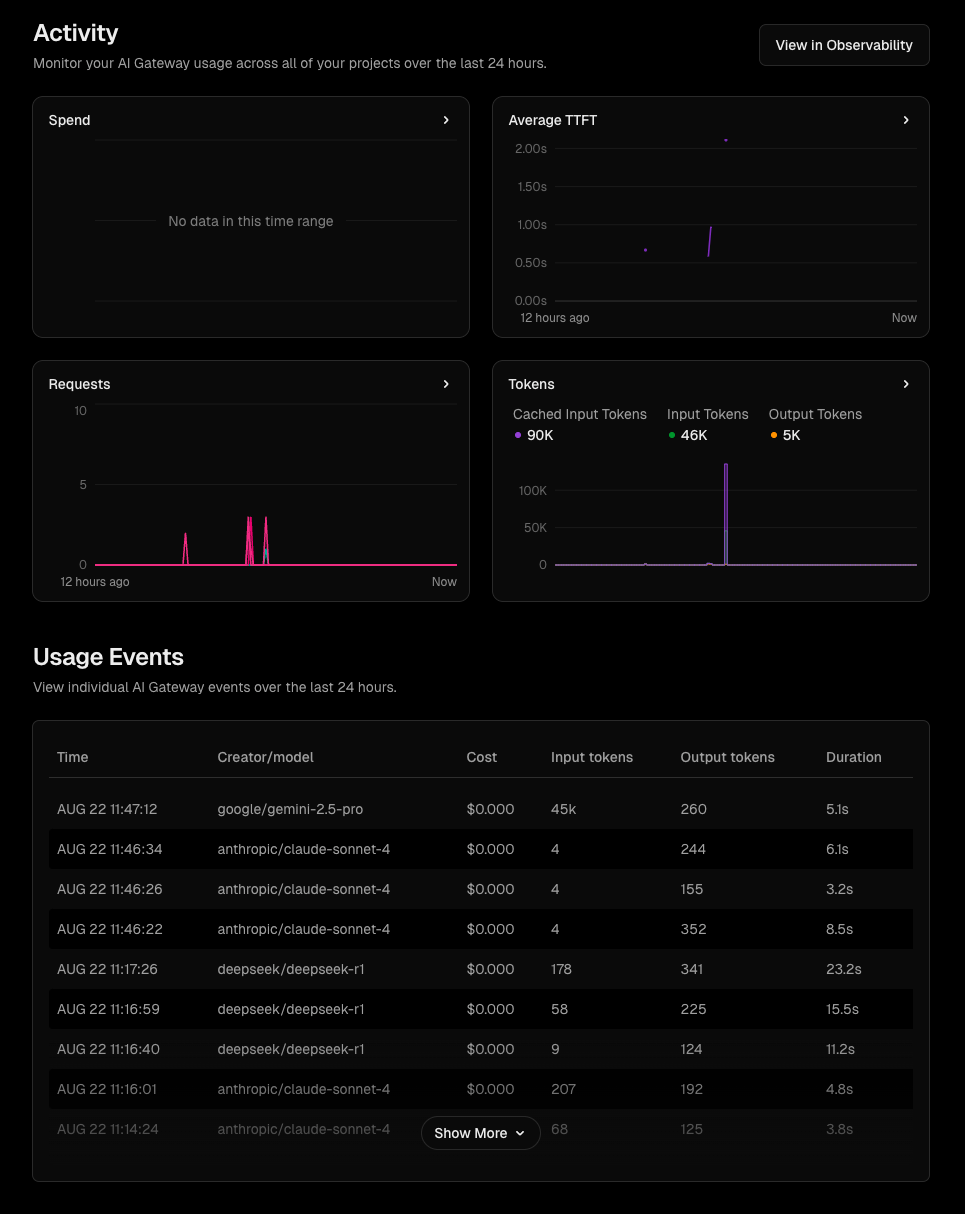

コストとパフォーマンスの可視化

複数のLLMを併用すると、コストの把握や利用状況の管理が煩雑になりがちです。

AI Gatewayのダッシュボードではどのモデルがどれだけ使われ、どの程度のコストが発生しているかを可視化できます。

これにより、コストパフォーマンスを考慮したモデル選定が可能になり、予期しないコスト超過を防止できます。

管理画面の例

詳細: https://vercel.com/docs/ai-gateway/observability

価格について

AI Gateway自体に利用料はかからず、AIプロバイダーの料金のみが課金されます。

- 利用前にAI Gatewayクレジットを購入し、そこから消費

- 毎月5ドル分の無料枠があり、気軽に試すことができる

- Vercelが提供するモデル以外でも、独自で発行したAPIキー(BYOK)を利用することも可能(料金はAIプロバイダー側に依存)

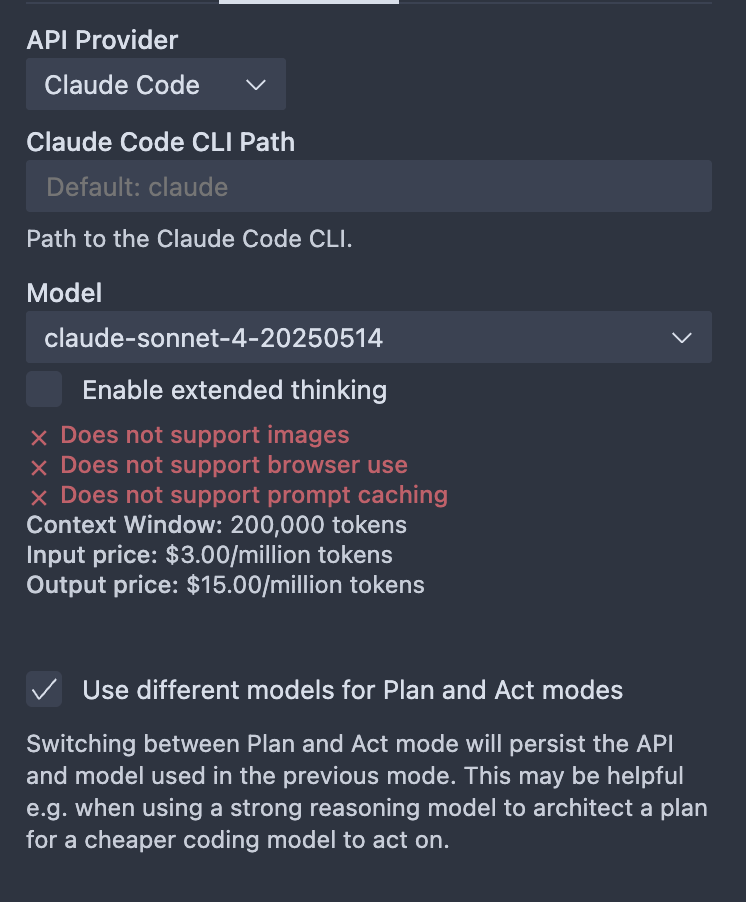

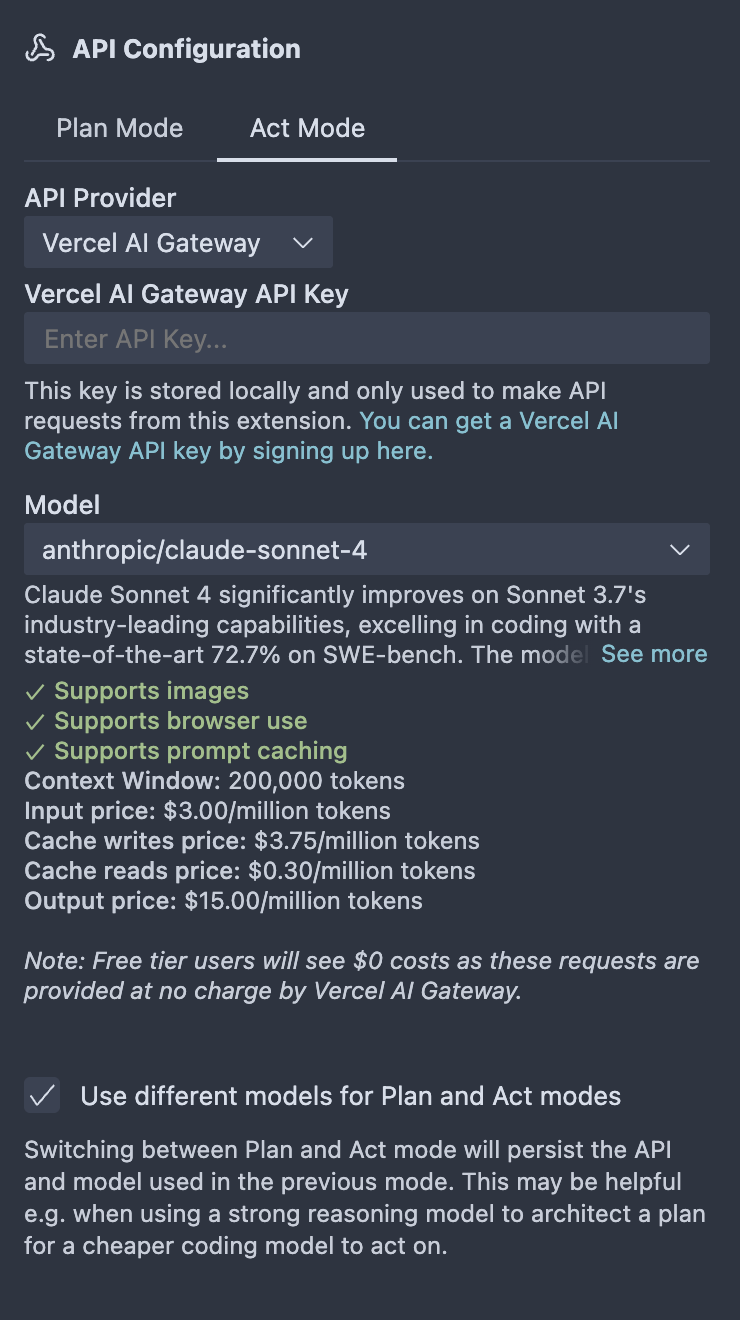

ClineからAI Gatewayが使えるように

AI Gateway GA発表と同時に、Clineからも対応のポストがありました

Cline + AI Gateway経由とCline単体でClaude Sonnet 4を比較してみたところ、

- Context Windowや料金は同じ

- ただしAI Gateway経由では画像入力やキャッシュが対応している(なぜでしょうか。。)

という違いが見られました

特に、AI Gatewayには$5の無料枠があるため、Clineから気軽にいろんなモデルを比較できるのは良いなと感じました。

※UIを見る限り、ClineからBYOKは利用できないようです。

まとめ

Vercel AI Gatewayは、LLMを活用したアプリケーション開発、運用体験を大きく改善する仕組みです。

- モデル切り替えの容易さ

- プロバイダー依存を排除

- コストと利用状況の一元監視

- 無料枠(5ドル分)で気軽に試せる

これらの特徴は今後のAI開発における標準的な選択肢になるポテンシャルがあると感じました。

この記事がAI開発やAI Gatewayに興味のある方の参考になれば幸いです。