![[セッションレポート] What's new Cloud Run の発表内容まとめ #GoogleCloudNext](https://images.ctfassets.net/ct0aopd36mqt/4VZteia2tZFWoXPzZmZcuT/32265bac33524fc15a9254504b80ef85/260401_eyechatch_googlecloudnext26_w1200h630.png?w=3840&fm=webp)

[セッションレポート] What's new Cloud Run の発表内容まとめ #GoogleCloudNext

はじめに

こんにちは。すらぼです。

Google Cloud Next Las Vegas' 26 のセッション "What's new Cloud Run" に参加してきました。

セッションの速報レポートになります。

今回の発表内容

本セッションと公式ブログから発表された、各機能のアップデート状況は以下の通りです。

- フルスタックアプリの Google AI Studio 連携 (GA)

- Cloud Run リモート MCP サーバー (GA)

- NVIDIA RTX PRO 6000 Blackwell GPU サポート (GA)

- Ephemeral disk (Public Preview)

- Gemini Enterprise Agent Platform との統合 (Private Preview)

- Cloud Run Instances (Private Preview)

- SSH support for Cloud Run (Private Preview)

- Cloud Run Sandboxes (Coming Soon / Private Preview)

- Service Bindings / Pipelines (Coming Soon)

- Billing caps (Coming Soon)

- 事例紹介(Replit, Anthropic)

発表内容の詳細

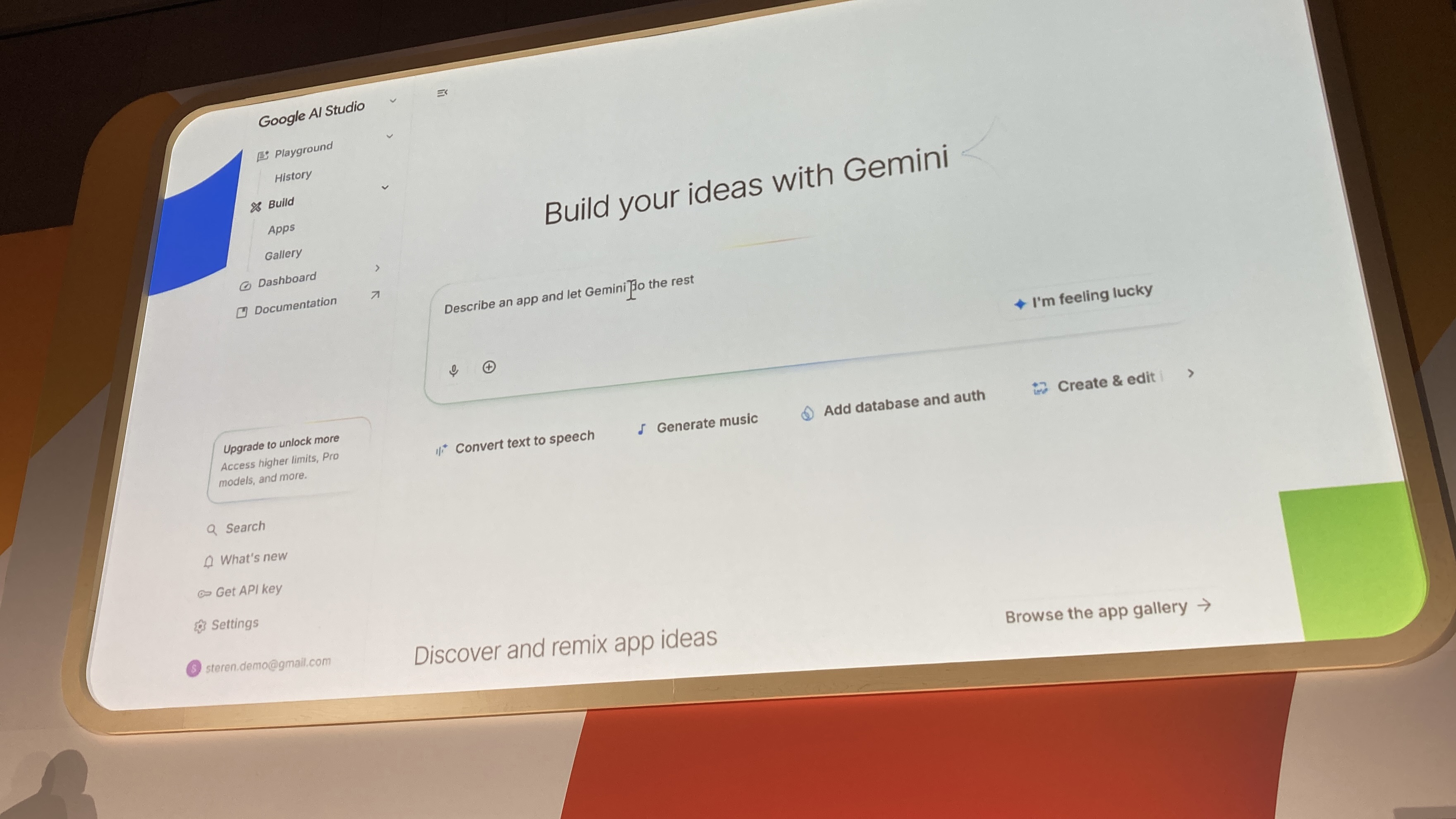

フルスタックアプリの Google AI Studio 連携 (GA)

フルスタックアプリケーションを、 AI Studio で作成してそのまま Cloud Run にデプロイできるようになりました。

これによって、Vibe Coding で作成されたアプリケーションをシームレスに Cloud Run にデプロイできるようになったため、非エンジニアがアプリケーションを公開するハードルがまた更に下がりました。

セッションではデモも実施していて、「マルチプレイヤーの3Dレーシングゲーム」を作らせて、そのURLに視聴者がアクセスしてマルチプレイができることもリアルタイムで紹介されていました。「バックエンドまで全てデプロイできる」というのが、強烈に印象に残っています。

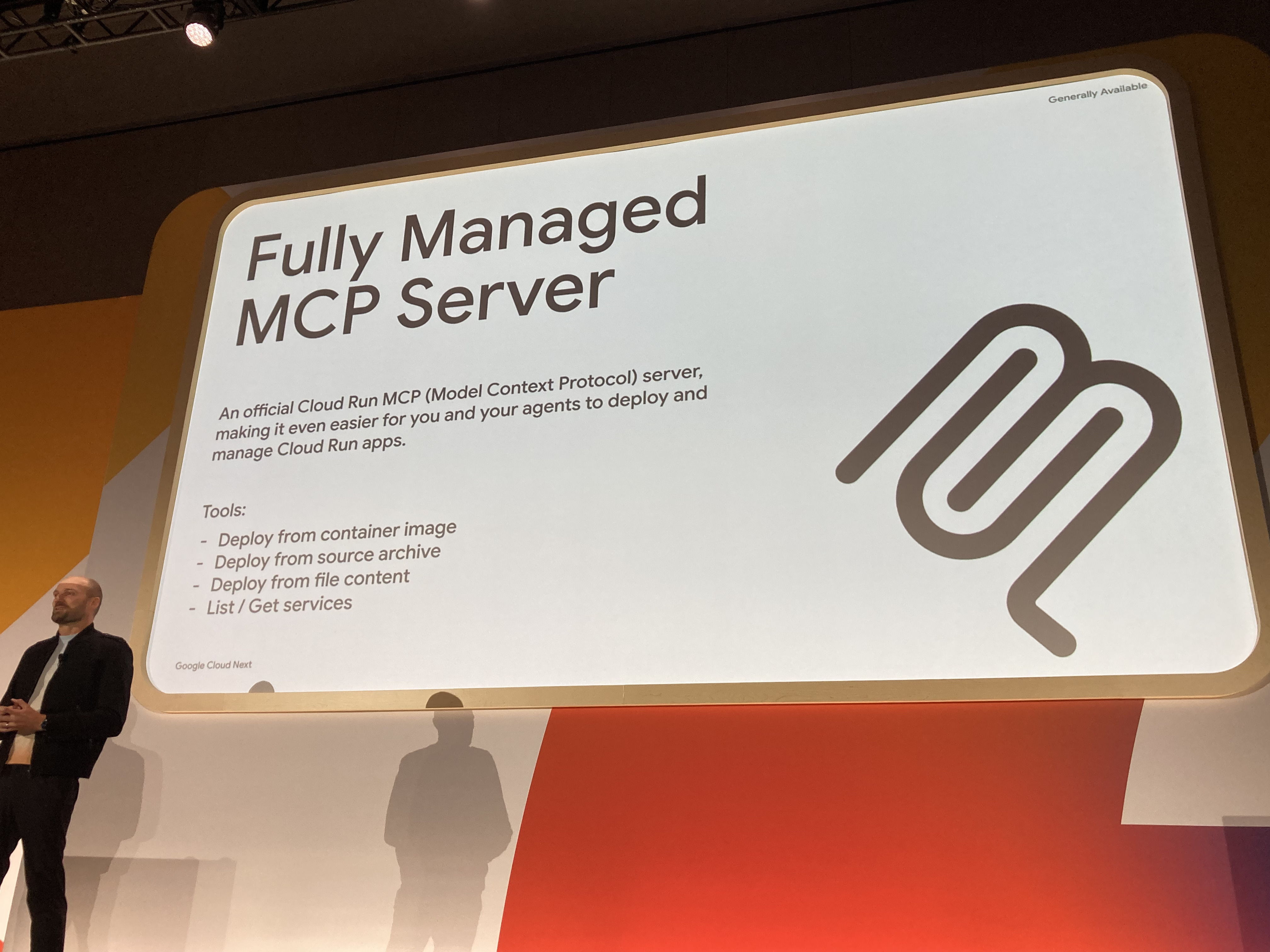

Cloud Run リモート MCP サーバー (GA)

フルマネージドの Cloud Run MCP サーバーが利用できるようになりました。

これによって、AI がより簡単に Cloud Run に対するデプロイや調査などを行えるようになります。

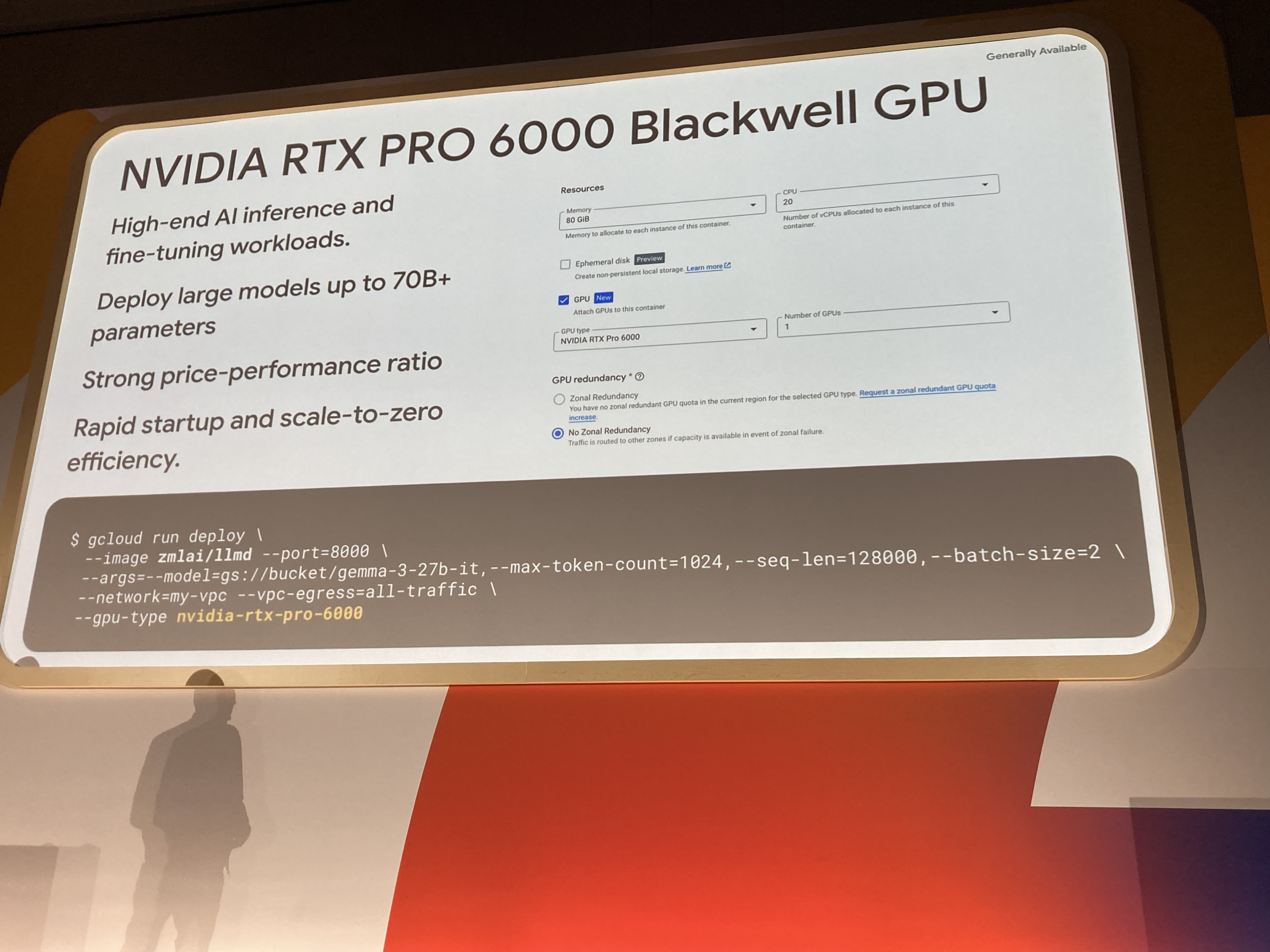

NVIDIA RTX PRO 6000 Blackwell GPU サポート (GA)

最大70B(700億)以上のパラメータモデルを、高速スタート & scale-to-zero を強みとする Cloud Run と組み合わせることで費用を最適化しつつトレーニングを行えるようになりました。

より高度なトレーニングを Cloud Run でできるようになったことがポイントですね。

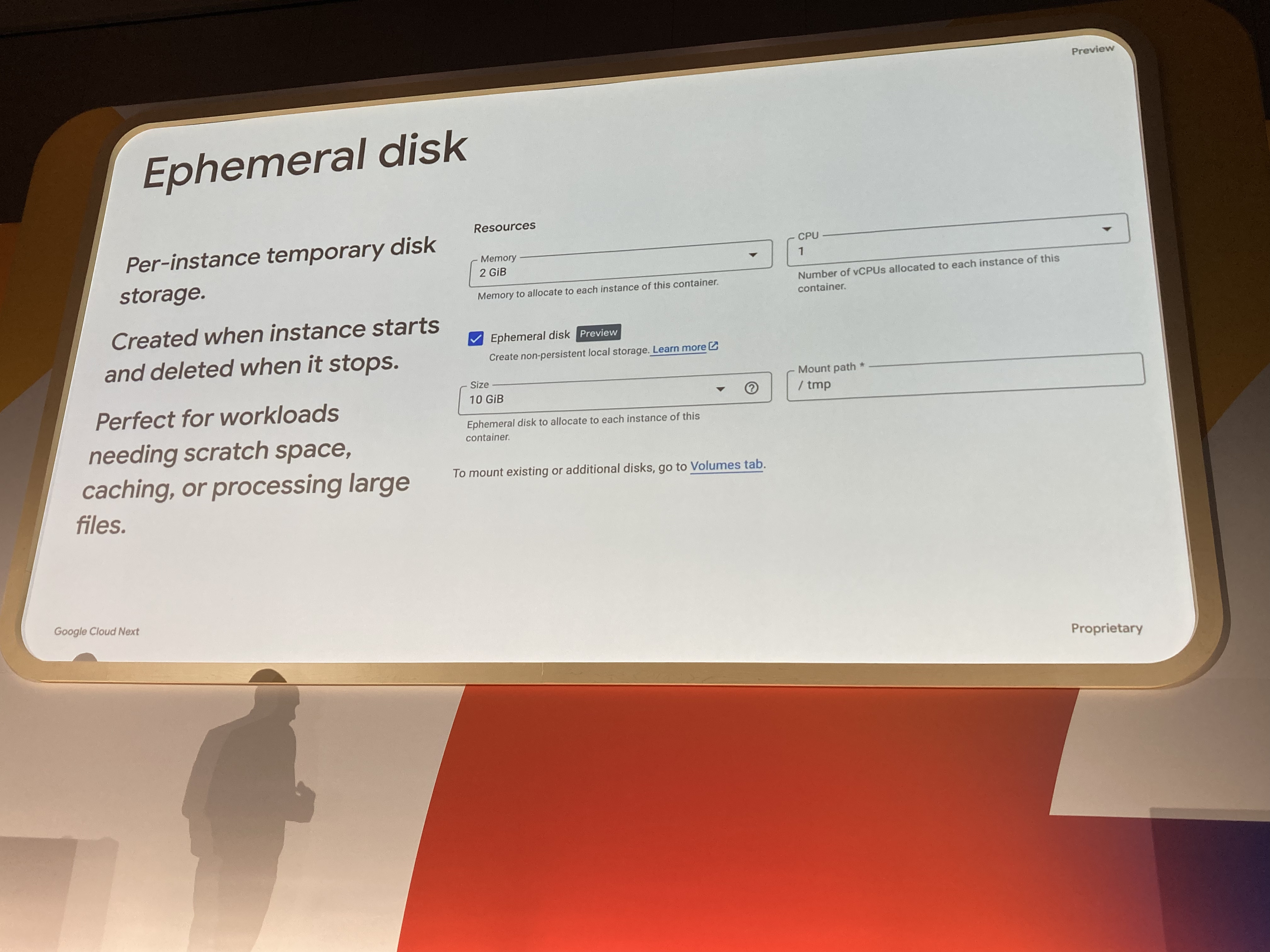

Ephemeral disk (Public Preview)

エフェメラルディスクが登場。モデルの処理などで一時的にローカルにファイルを置く必要がある時でも、従来は永続ディスクをアタッチする必要がありました。

この課題が、エフェメラルディスクによって解消され、トレーニングなどのコストを更に削減できそうです。

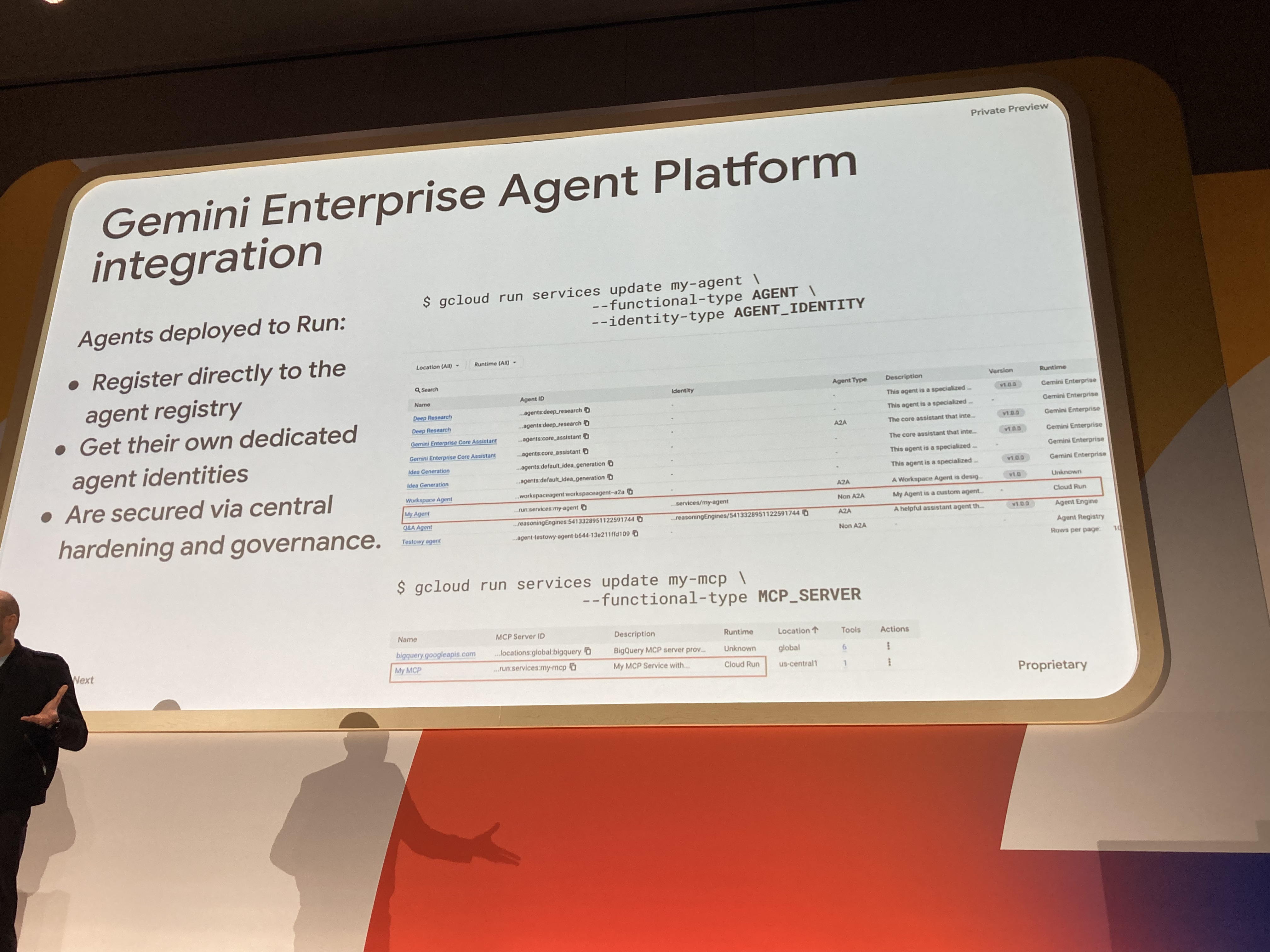

Gemini Enterprise Agent Platform との統合 (Private Preview)

Gemini Enterprise の Agent Platform と、Cloud Run が統合できる機能が登場。

従来は手動でやっていた作業が、このアップデートによってCloud Run にデプロイしたものがそのまま Gemini Enterprise で使えるようになるので、管理・運用のコストが大きく減らせそうです。

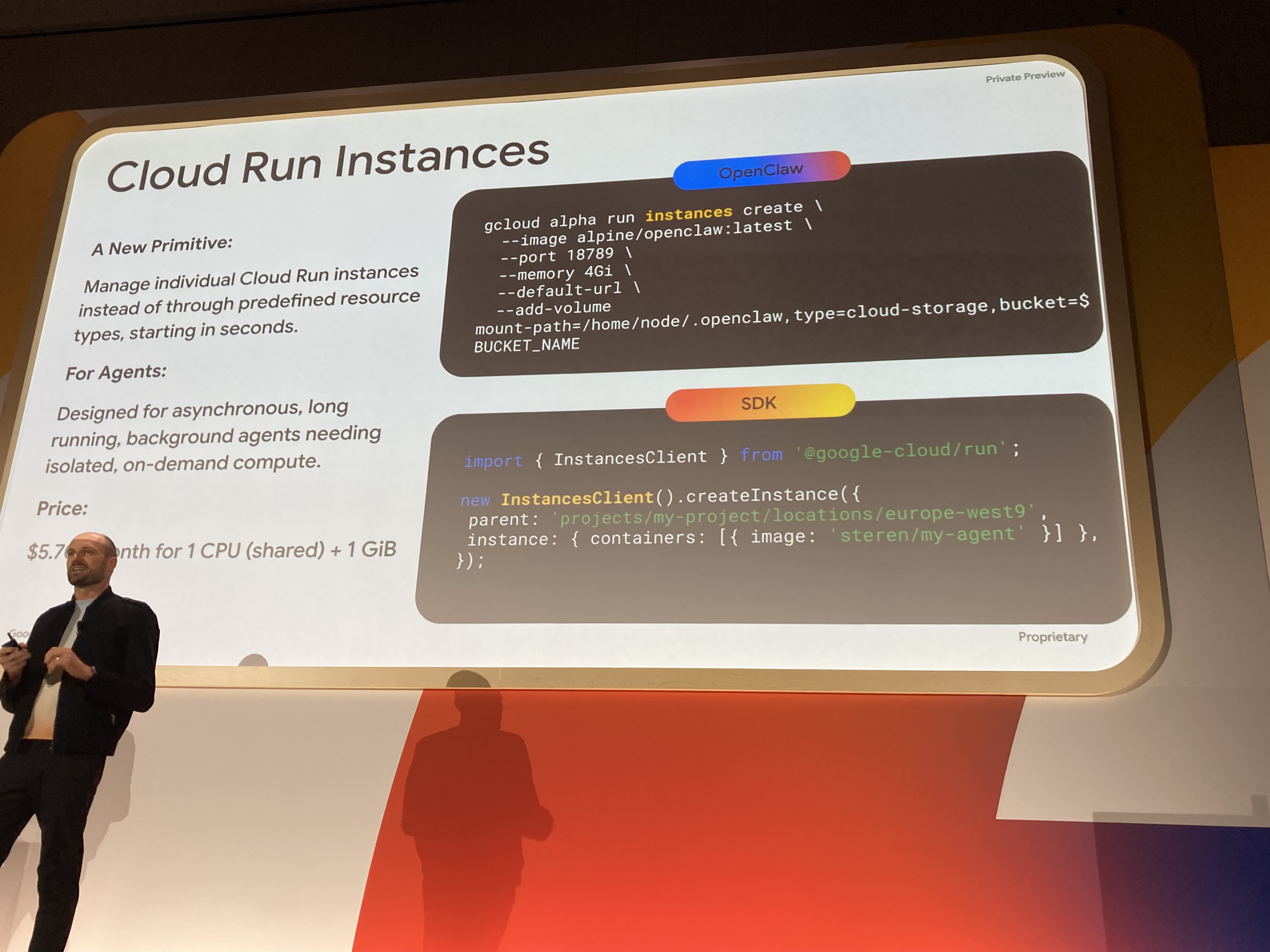

Cloud Run Instances (Private Preview)

長時間のタスクやジョブなどに適した Cloud Run Instances 機能が発表。

「サービス」「ジョブ」といった事前定義のリソースではなく、直接インスタンスタイプを指定して起動できるのがポイントです。

主に「非同期で長時間実行されるエージェント」向けの機能です。

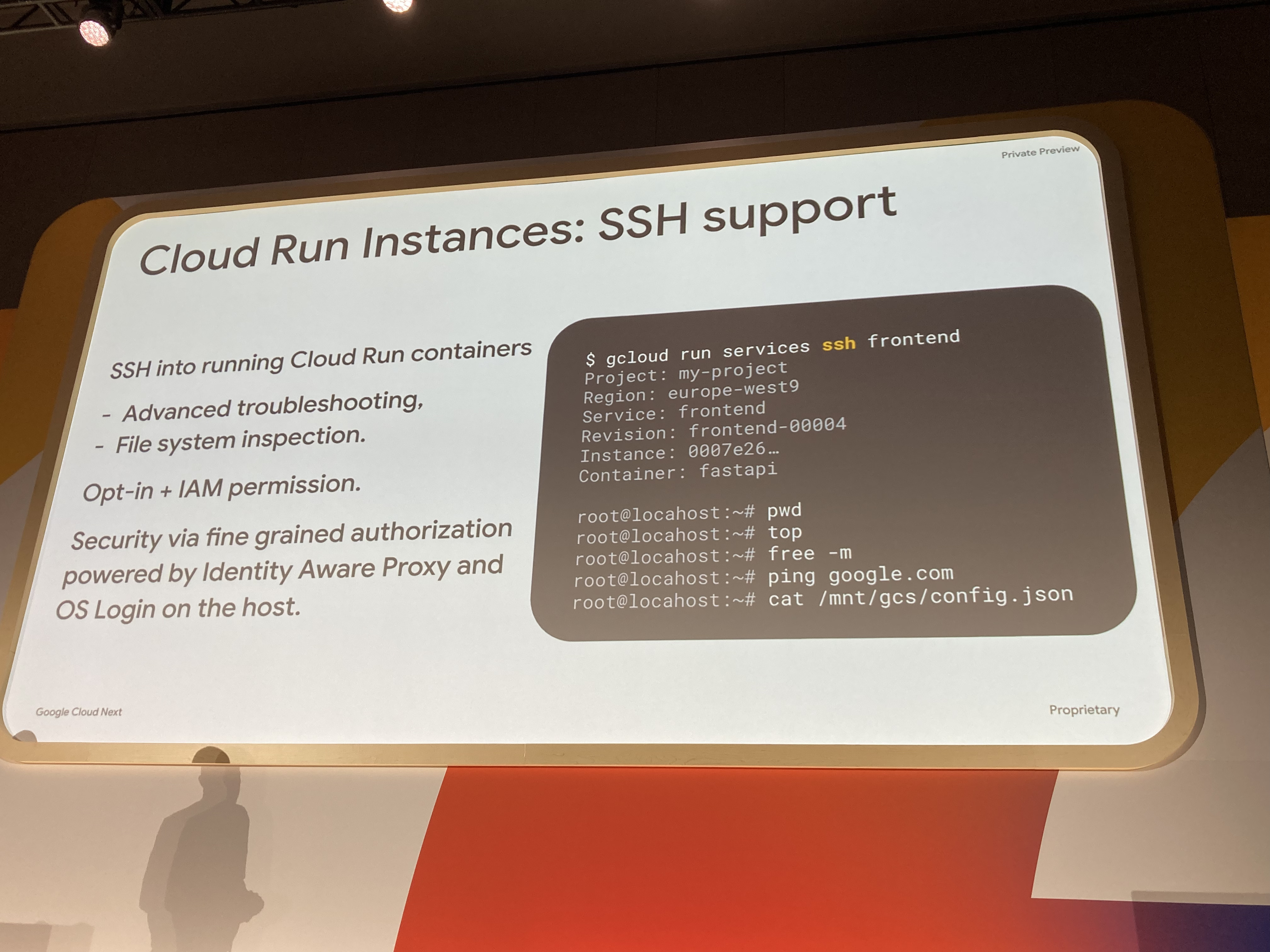

SSH support for Cloud Run (Private Preview)

Cloud Run コンテナに対する ssh 機能が発表。インスタンス内で更に高度な調査が行えるようになります。

MCP サーバーと組み合わせることで、AIエージェントによる調査の高度化も期待できそうです。

Cloud Run Sandboxes (Coming Soon / Private Preview)

Cloud Run のサンドボックス機能が発表。

サンプルのコードでは、 Express アプリケーションの中で sandbox do といったプレフィックスをつけて Python スクリプトを実行しています。

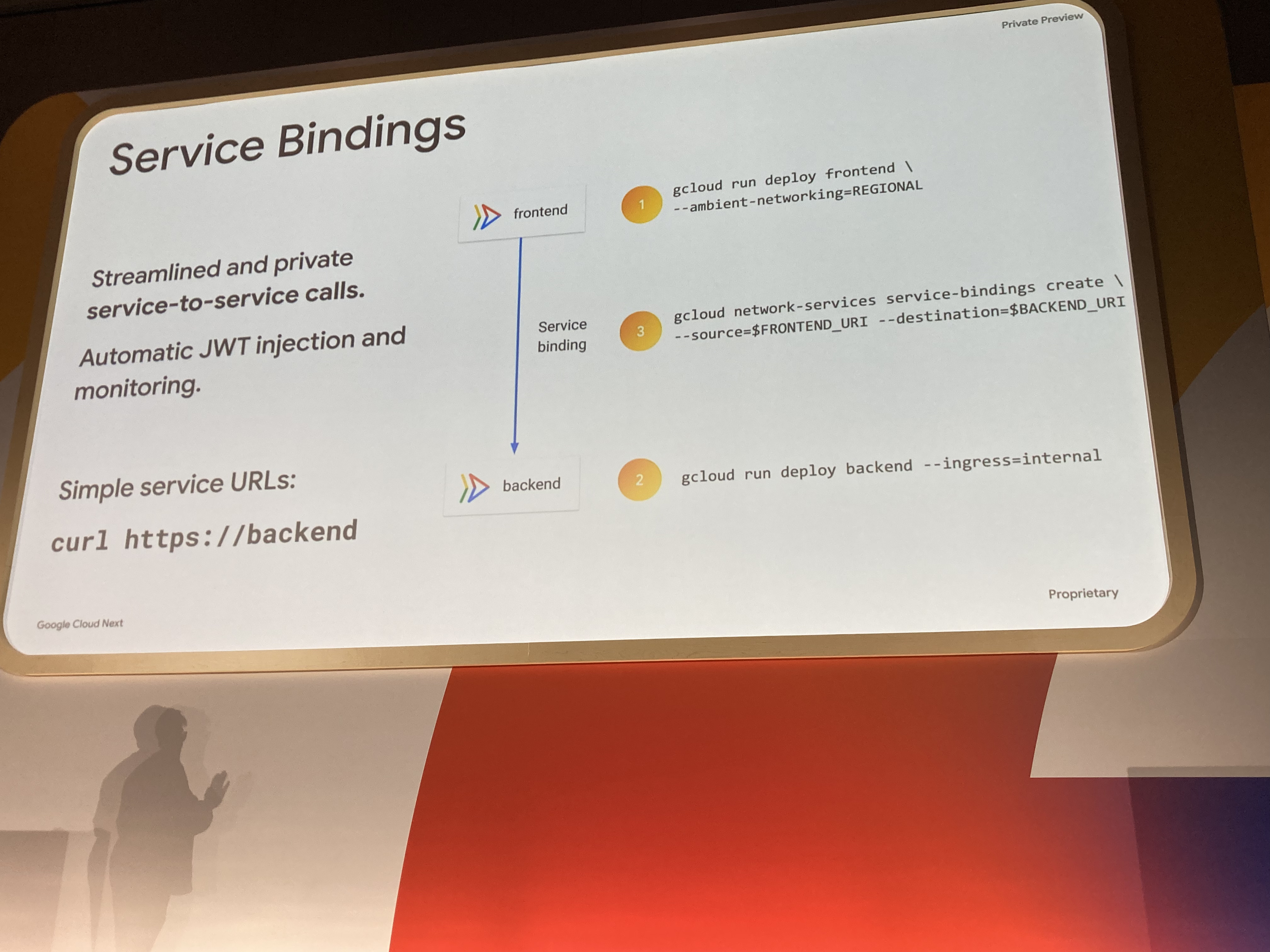

Service Bindings / Pipelines (Coming Soon)

サービスごとの依存関係を簡単に定義できる、 Service Bindings が予告。

Cloud Run 同士を Service Bindings で接続することで、呼び出しが簡単に行えるだけでなく、JWTの自動注入やモニタリングなども全て行ってくれるようになります。

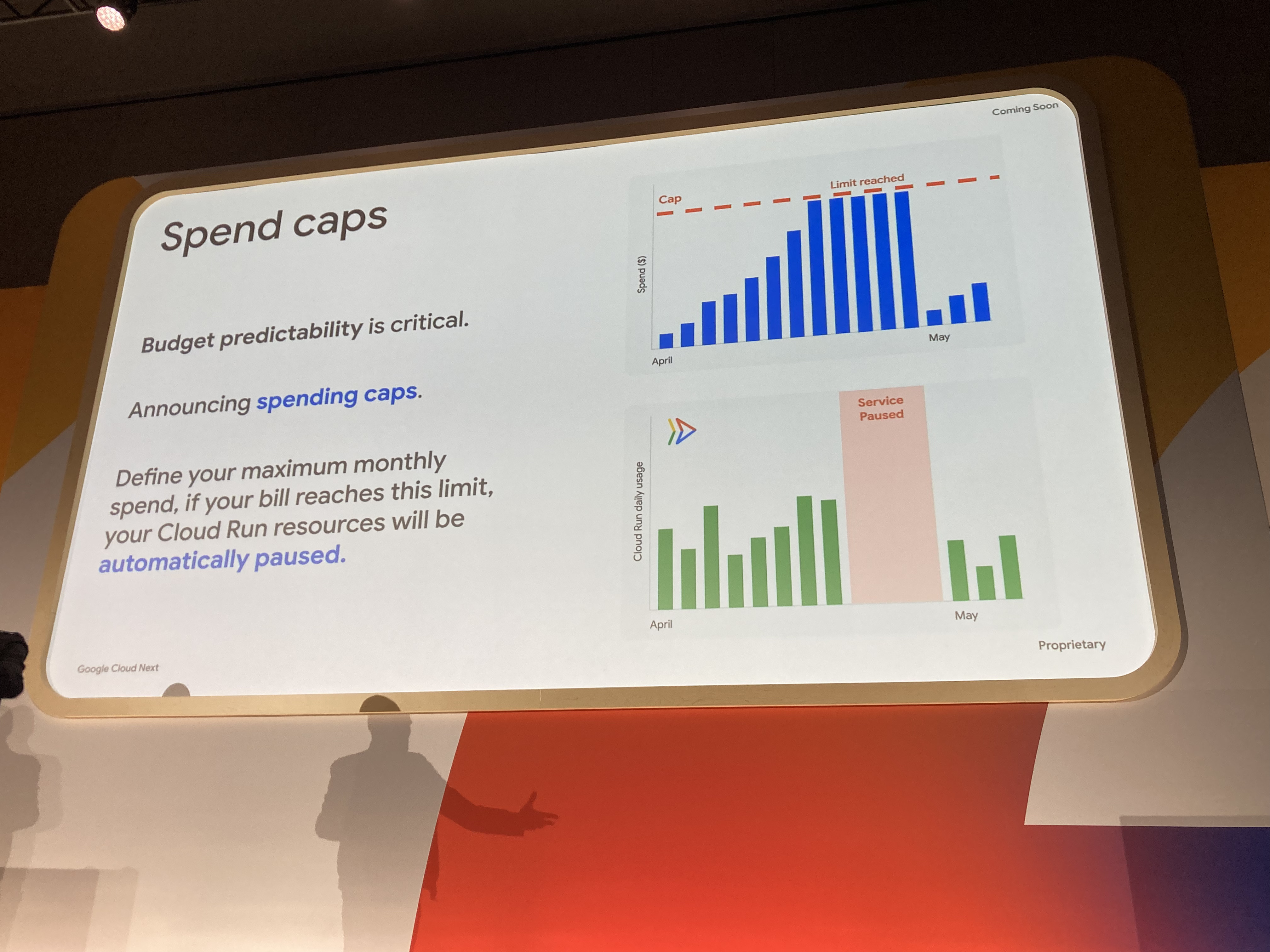

Billing caps (Coming Soon)

請求の上限設定の機能が予告されました。これにより、月間などの指定期間で利用する上限を設定できます。

Webアプリケーションのようなワークロードよりも、AI のモデルのような費用が高いワークロードで大きな効果を発揮してくれそうです。

事例紹介

セッションの中では、 Cloud Run で稼働するワークロードの事例として Replit 社や Anthropic 社も紹介されていました。

Replit は、ブラウザ上でWebアプリケーションのプログラミング〜デプロイまで行えるサービスです。

デプロイされるサービスは既に100万を超えており、その状況でも「コスト最適」「パフォーマンス」「可用性」の3軸で Cloud Run が選ばれているようです。

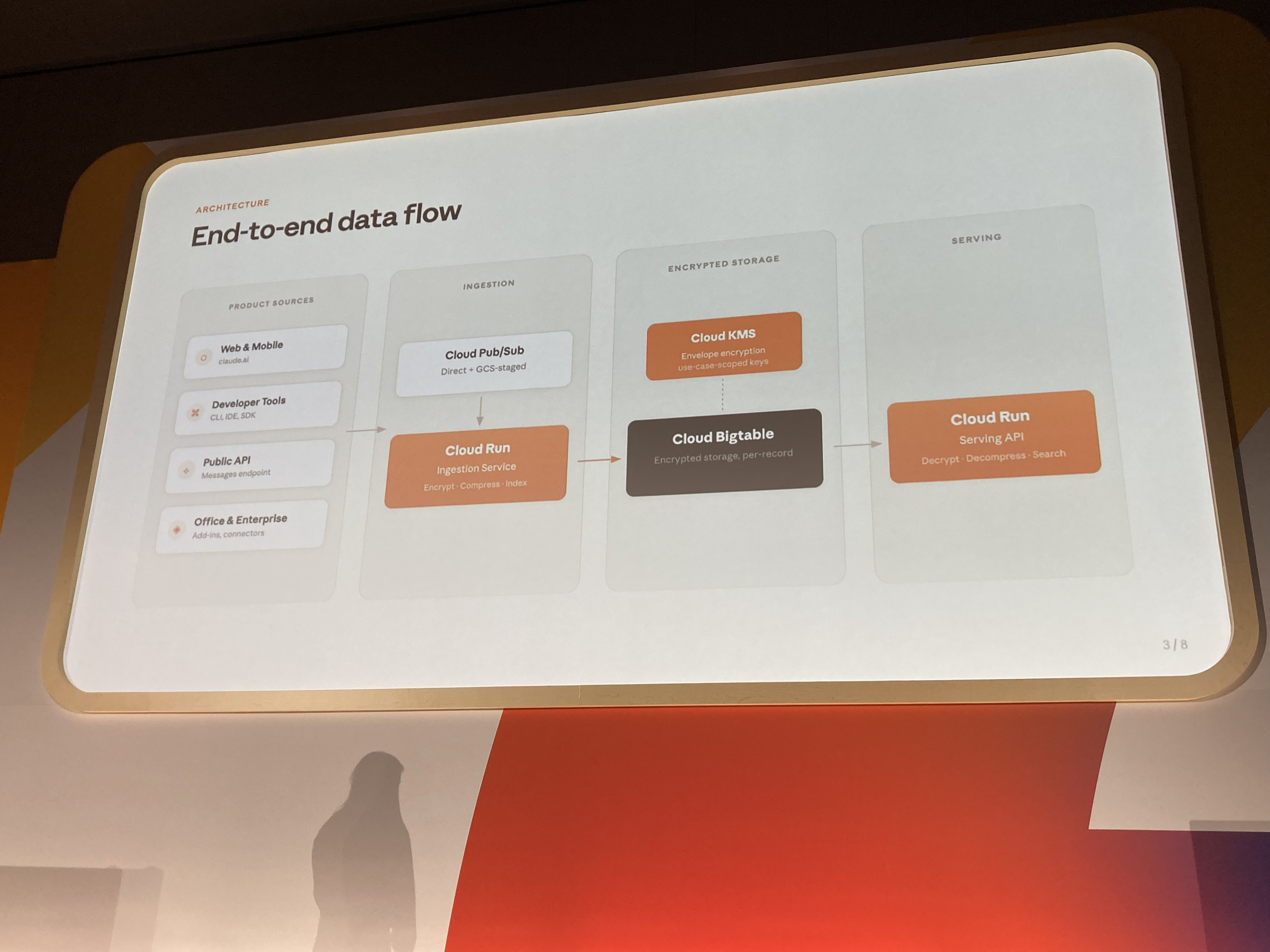

Anthropic は「数十億の会話を処理する『レコード単位で暗号化されたデータプラットフォーム』をどのように構築したか」という背景で、Cloud Run や他のサービスとの組み合わせを紹介していました。

具体的な構成は以下のようになっており、Cloud Run が 暗号化/復号や、圧縮処理といった重要な部分を担っていることがわかります。

そして、実際に稼働しているインスタンスは、SERVING 部分が 10K〜20Kインスタンス、INGESTION 部分も 4K〜7Kインスタンスと、非常に大規模なスケーリングを行っています。

まとめ

セッションでの新機能の発表レポートでした。

今回の発表では「痒い所に手が届く」アップデートが多く、開発者視点での快適さが大きく上がるように感じました。

特に、SSH と Billing Cap の機能は会場でも歓声が上がっており、多くのユーザーの期待に応える機能になりそうです。

また本題とは逸れますが、デモで行った AI Studio のデプロイがなかなか終わらず、登壇者が場を持たせる話題が尽きかけたところが個人的ハイライトでした。

この記事がお役に立てば幸いです。以上、すらぼでした!